MetaQuestでハンドトラッキングを有効化する方法についてです。 ]]>

メジャー機能の基本的な使い方は以下の記事を参照ください。

bluebirdofoz.hatenablog.com

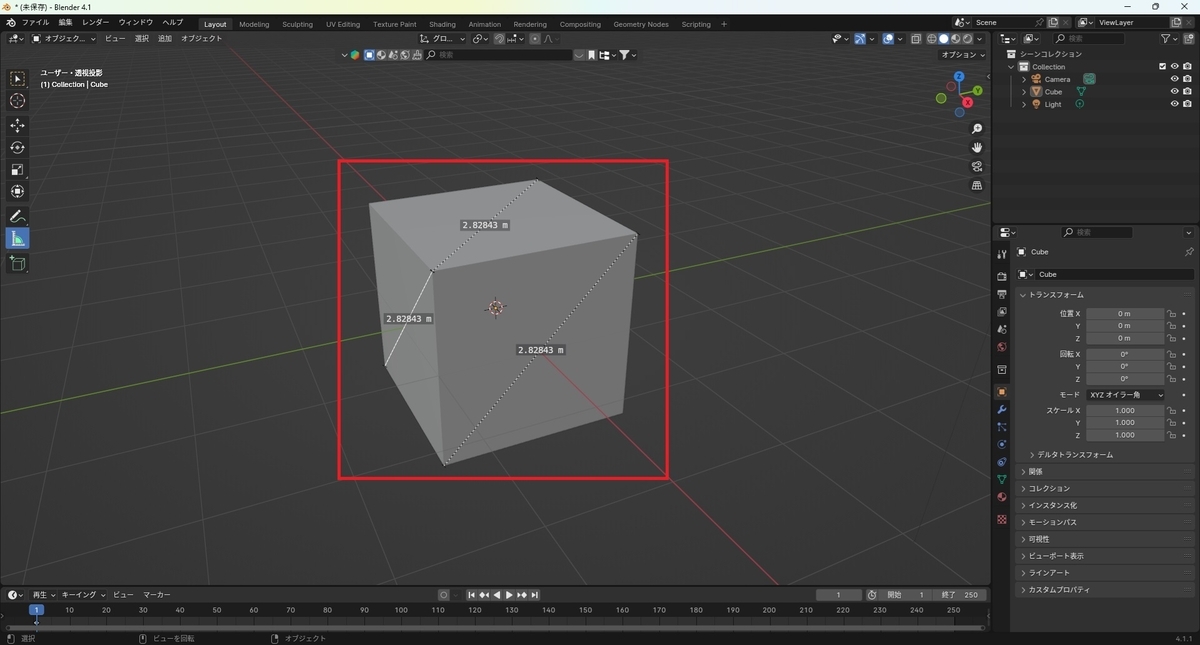

一例として以下の通り、Cubeオブジェクトの3面にメジャーの計測を行いました。

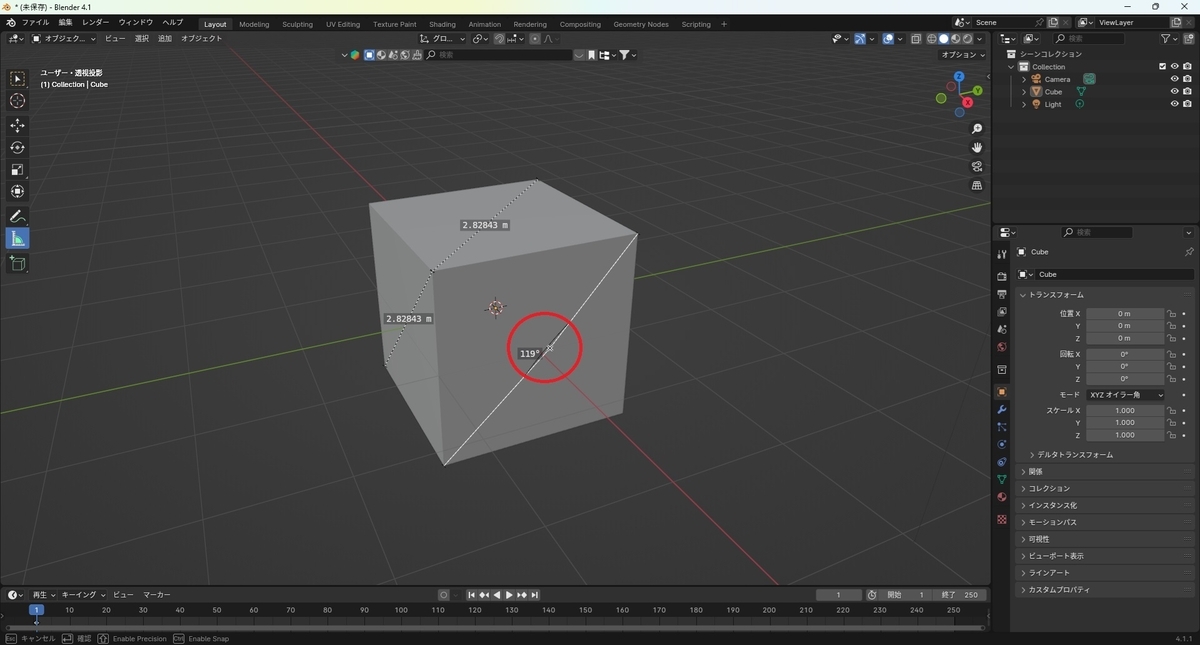

個別に削除を行いたい場合は任意のオブジェクトを左クリックで選択状態にします。

この状態で[X]キーまたは[Delete]キーでの削除を実行します。

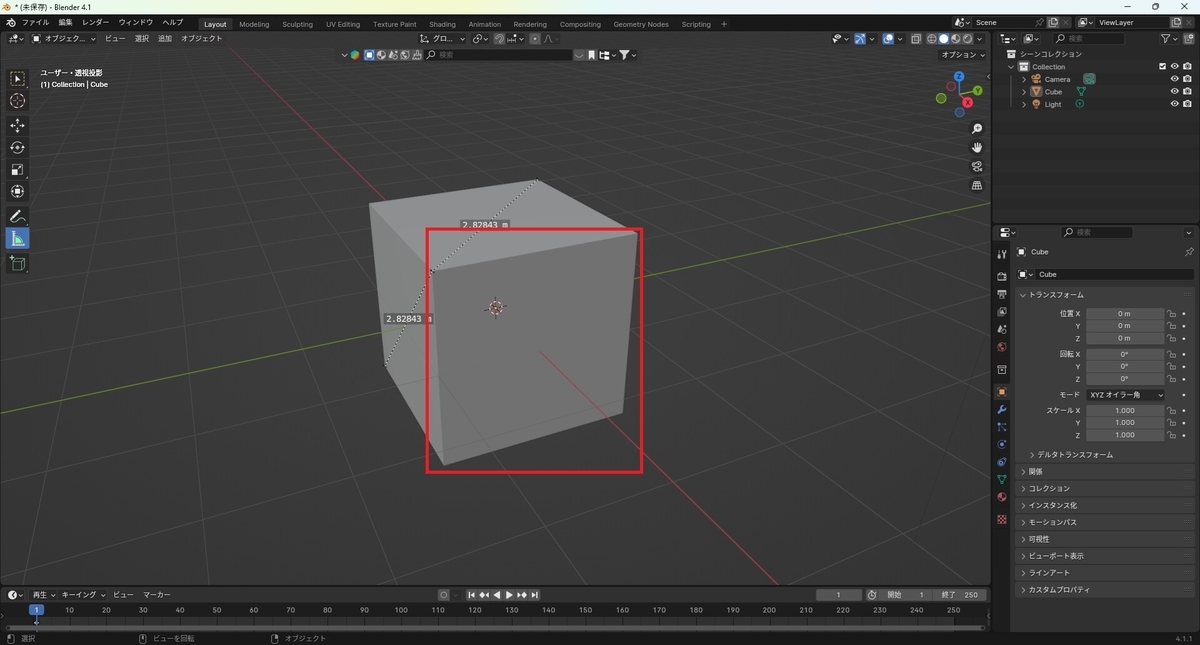

これでメジャーを個別に削除できます。

メジャーの公式マニュアルは以下になります。

メジャーをUIから個別削除する方法はないようです。

docs.blender.org

MonoBehaviourからオブジェクトやコンポーネントのアクティブ状態をチェックするには以下のいくつかのプロパティが利用できます。

| プロパティ名 | 説明 |

|---|---|

| activeInHierarchy | ヒエラルキーにおける自身のオブジェクトの有効無効状態を取得する |

| activeSelf | 自身のオブジェクト自体の有効無効の切り替え状態を取得する |

| isActiveAndEnabled | コンポーネントの動作の有効無効状態を取得する |

| enabled | コンポーネント自体の有効無効の切り替え状態を取得する |

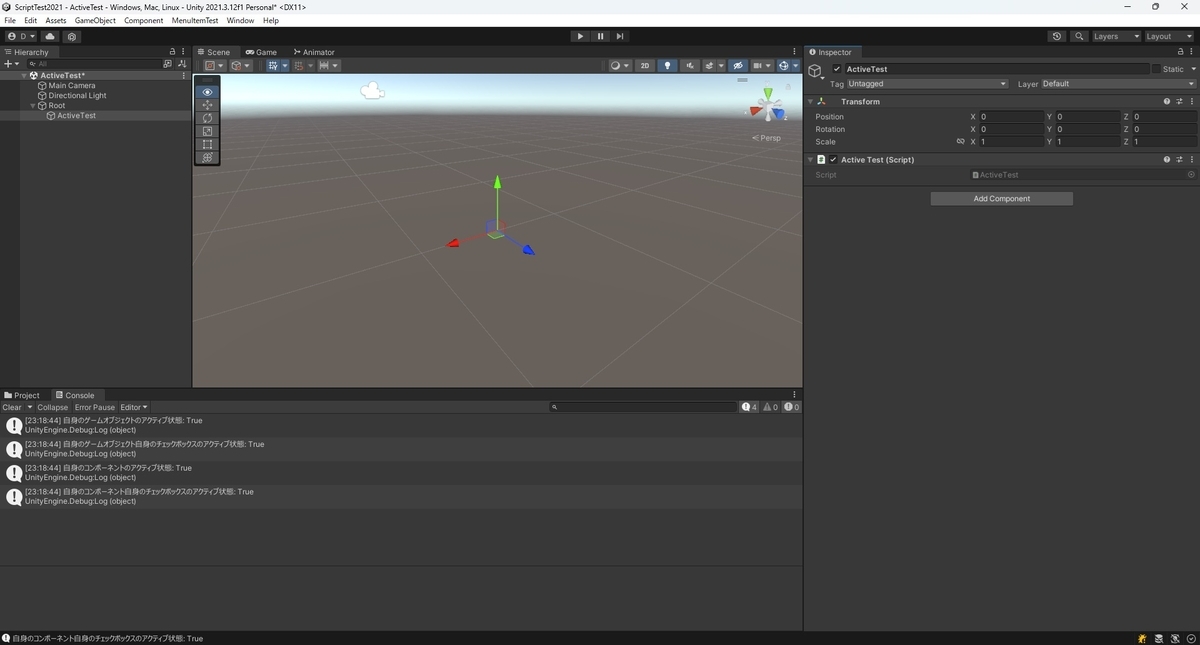

以下のサンプルスクリプトを使って状況ごとの戻り値を確認してみます。

・ActiveTest.cs

using UnityEngine; public class ActiveTest : MonoBehaviour { private void Update() { // コンポーネントのチェックボックスを表示するためUpdate関数を記述 } [ContextMenu("ActiveCheck")] public void ActiveCheck() { // 様々なパターンのアクティブ状態を確認する // 1. 自身のゲームオブジェクトのアクティブ状態を確認する Debug.Log("自身のゲームオブジェクトのアクティブ状態: " + gameObject.activeInHierarchy); // 2. 自身のゲームオブジェクト自身のチェックボックスのアクティブ状態を確認する Debug.Log("自身のゲームオブジェクト自身のチェックボックスのアクティブ状態: " + gameObject.activeSelf); // 3. 自身のコンポーネントのアクティブ状態を確認する Debug.Log("自身のコンポーネントのアクティブ状態: " + this.isActiveAndEnabled); // 4. 自身のコンポーネント自身のチェックボックスのアクティブ状態を確認する Debug.Log("自身のコンポーネント自身のチェックボックスのアクティブ状態: " + this.enabled); } }

オブジェクトとコンポーネント全てが有効な場合は全てTrueが返ります。

| プロパティ名 | 結果 |

|---|---|

| activeInHierarchy | True |

| activeSelf | True |

| isActiveAndEnabled | True |

| enabled | True |

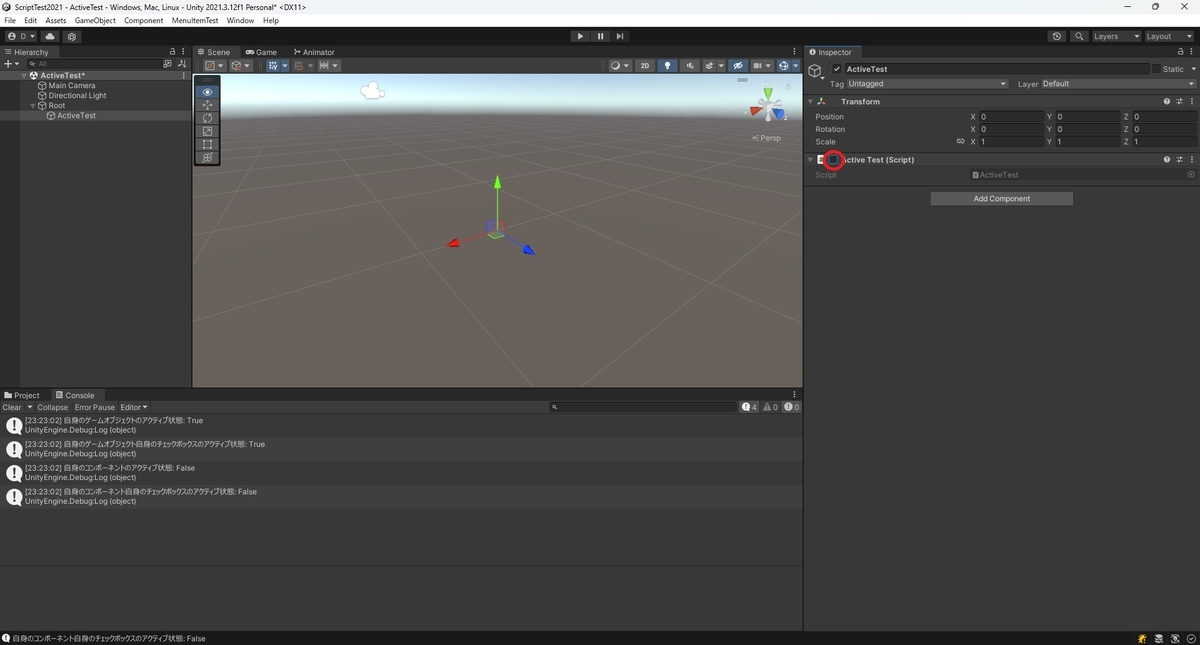

コンポーネントのみチェックを外した場合、コンポーネントの関連のisActiveAndEnabled,enabled両方でFalseが返ります。

| プロパティ名 | 結果 |

|---|---|

| activeInHierarchy | True |

| activeSelf | True |

| isActiveAndEnabled | False |

| enabled | False |

Invokeの基本的な仕様は以下の前回記事を参照ください。

bluebirdofoz.hatenablog.com

MonoBehaviourのInvokeRepeatingは指定のメソッドを指定秒後に呼び出し、その後一定秒ごとに繰り返します。

docs.unity3d.com

void Start() { // 2秒後から5秒間隔でDebugLogメソッドを呼び出す InvokeRepeating("DebugLog", 2.0f, 5.0f); } void DebugLog() { Debug.Log("Hello, World!"); }

InvokeRepeatingの繰り返しを停止したい場合はMonoBehaviour.CancelInvokeを実行します。

また処理が実行中か否かはMonoBehaviour.IsInvokingでチェックできます。

以下の様々なInvokeの呼び出しを試すサンプルスクリプトを作成しました。

・InvokeRepeatingTest.cs

using UnityEngine; public class InvokeRepeatingTest : MonoBehaviour { void Start() { // 2秒後から5秒間隔でDebugLogメソッドを呼び出す InvokeRepeating("VoidDebugLog", 2.0f, 5.0f); } void VoidDebugLog() { // アプリの起動時からの経過時間を取得する float elapsedTime = Time.time; Debug.Log($"Called VoidDebugLog() : {elapsedTime}"); } [ContextMenu("StopInvokeRepeating")] public void StopInvokeRepeating() { // 現在Invokeによる実行が保留中かチェックする if (!IsInvoking("VoidDebugLog")) { Debug.Log("Invokeによる実行が保留中ではありません"); return; } // InvokeRepeatingを停止する CancelInvoke("VoidDebugLog"); Debug.Log("InvokeRepeatingを停止しました"); } }

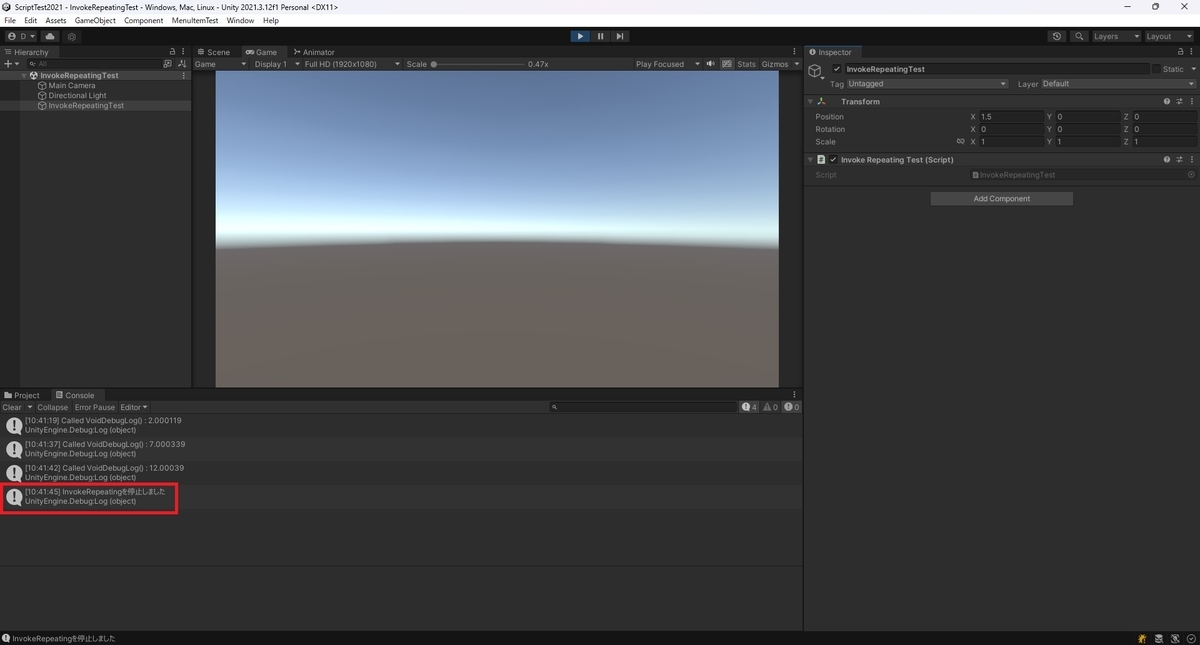

シーンを再生すると以下の通り指定時間後に処理が繰り返して実行されます。

繰り返し処理を停止するにはコンテキストメニューからStopInvokeRepeating関数を呼び出します。

繰り返し処理が実行中の場合は呼び出しが停止されます。

停止後、再度StopInvokeRepeating関数を呼び出すとMonoBehaviour.IsInvokingでfalseが返っているのが確認できます。

MonoBehaviourのInvokeは指定のメソッドを指定秒後に呼び出します。

docs.unity3d.com

void Start() { // 2秒後にDebugLogメソッドを呼び出す Invoke("DebugLog", 2.0f); } void DebugLog() { Debug.Log("Hello, World!"); }

Invokeで呼び出すメソッドは引数を指定することはできません。

MonoBehaviour.StartCoroutineと異なり、戻りがIEnumeratorではない通常のメソッドでも呼び出し対象に指定できます。

以下の様々なInvokeの呼び出しを試すサンプルスクリプトを作成しました。

・InvokeTest.cs

using UnityEngine; public class InvokeTest : MonoBehaviour { void Start() { // 秒数指定が0の場合は直後(Update前)に実行される Invoke("VoidDebugLog", 0.0f); // 2秒後にメソッドを実行する Invoke("VoidDebugLog", 2.0f); // 負数の場合は指定なしまたは0秒と同様に即座に実行される Invoke("VoidDebugLog", -1.0f); // 戻り値があるメソッドもInvokeで呼び出せる Invoke("BoolDebugLog", 3.0f); // 引数があるメソッドはInvokeで呼び出せない Invoke("ArgumentDebugLog", 4.0f); } void VoidDebugLog() { Debug.Log("Called VoidDebugLog()"); } bool BoolDebugLog() { Debug.Log("Called BoolDebugLog()"); return true; } void ArgumentDebugLog(string message) { Debug.Log("Called ArgumentDebugLog() : " + message); } }

以下の通り指定時間後に処理が実行されました。

引数があるメソッドは以下のエラーが発生して実行できません。

Trying to Invoke method: InvokeTest.ArgumentDebugLog couldn't be called.

MonoBehaviour.destroyCancellationTokenはMonoBehaviour が破棄されたときに発生するキャンセルトークンです。

Unity2022.2以降または2023.1以降で利用できます。

docs.unity3d.com

System.Threading.CancellationToken cancelToken = this.destroyCancellationToken; await System.Threading.Tasks.Task.Delay(TimeSpan.FromSeconds(10), cancelToken);

destroyCancellationTokenを参照して待機タスクのキャンセルを行う以下のサンプルスクリプトを作成しました。

using System; using UnityEngine; public class CancelTokenTest : MonoBehaviour { /// <summary> /// 本オブジェクトまたはコンポーネントの破棄を監視するためのCancellationToken /// </summary> private System.Threading.CancellationToken cancelToken => this.destroyCancellationToken; [ContextMenu("WaitFrame")] public async void WaitFrame() { try { // 再生モード時のみ実行する if (!Application.isPlaying) return; // 10秒待機する Debug.Log("待機タスクを開始します"); await System.Threading.Tasks.Task.Delay(TimeSpan.FromSeconds(10), cancelToken); // 待機タスクが完了したらログを出力する Debug.Log("10秒待機を完了しました"); } catch (OperationCanceledException) { // 待機タスクがキャンセルされた場合の処理 Debug.Log("タスクをキャンセルしました"); } } }

コンテキストメニューから関数を実行します。

オブジェクトが破棄されない場合はタスクが正常に完了します。

次に待機中にゲームオブジェクトを削除してみます。

以下の通りオブジェクトの破棄がキャンセルトークンで即座に検知されてタスクがキャンセルされます。

MonoBehaviour.destroyCancellationTokenが実装されていない以前のUnityの場合、以下のUniTaskのGetCancellationTokenOnDestroy関数を使ってオブジェクト破棄を検知するキャンセルトークンを取得できます。

bluebirdofoz.hatenablog.com

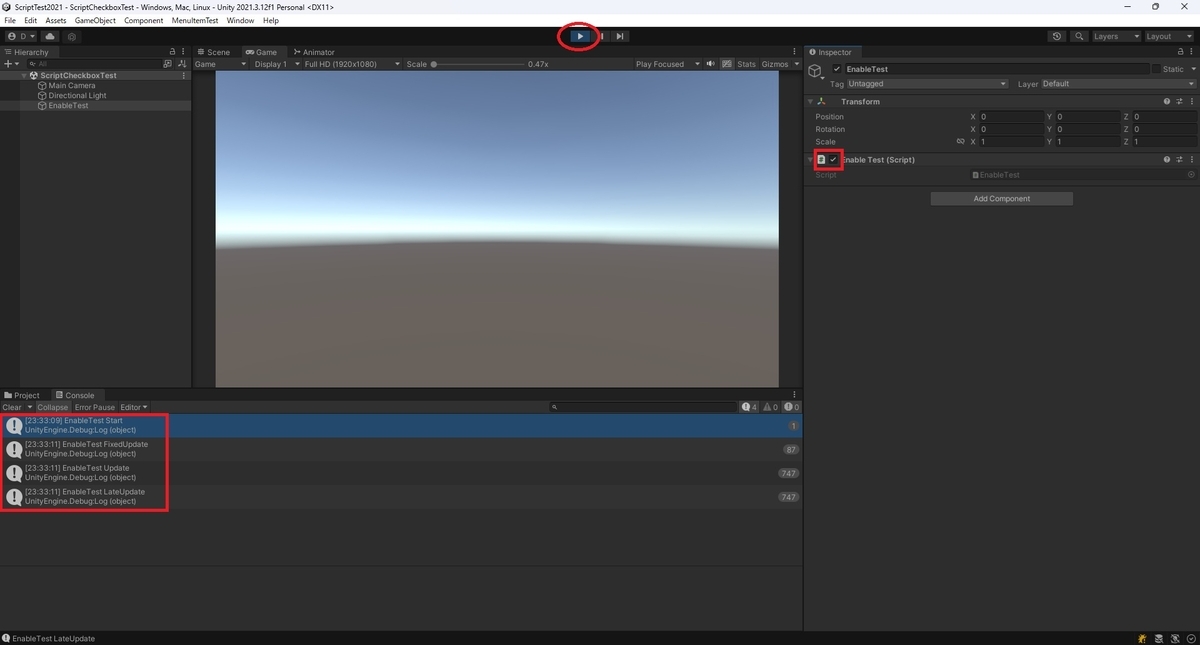

Inspector上に表示されるコンポーネントのチェックボックスは以下のライフサイクル関数の実行有無を切り替えることができます。

・Start()

・Update()

・FixedUpdate()

・LateUpdate()

・OnGUI()

・OnDisable()

・OnEnable()

docs.unity3d.com

以下のスクリプトをチェックボックスをONにした状態とOFFにした状態でシーンを再生してみます。

・EnableTest.cs

using UnityEngine; public class EnableTest : MonoBehaviour { void Start() { Debug.Log("EnableTest Start"); } void Update() { Debug.Log("EnableTest Update"); } void FixedUpdate() { Debug.Log("EnableTest FixedUpdate"); } void LateUpdate() { Debug.Log("EnableTest LateUpdate"); } }

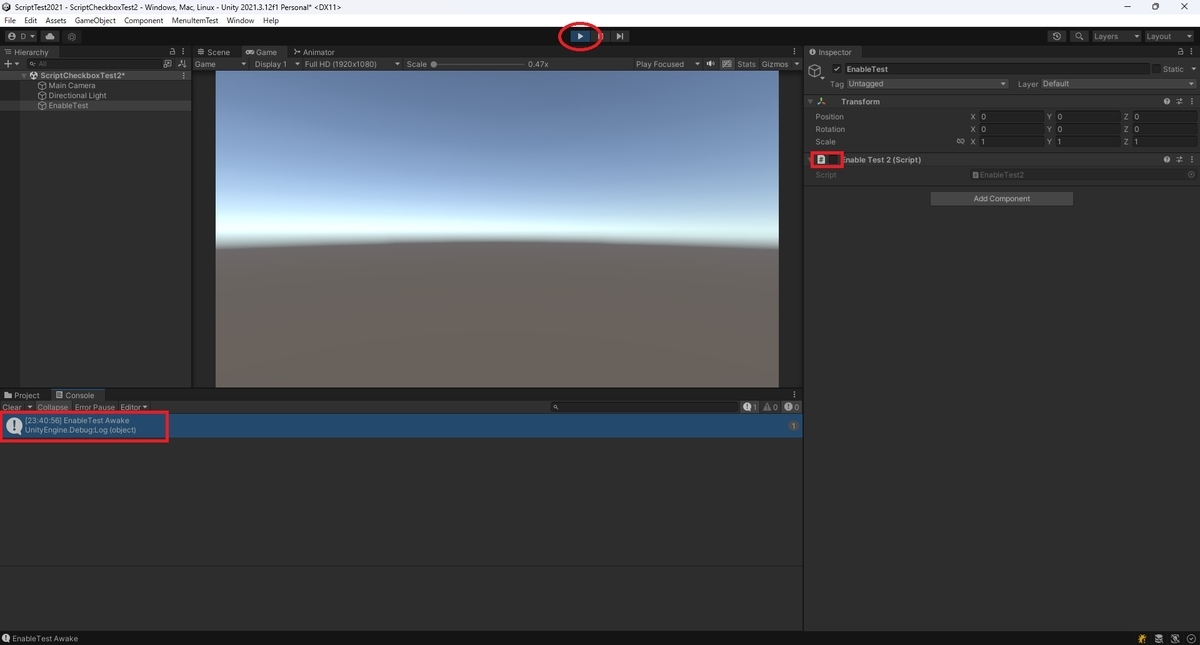

以下の通りチェックボックスをONにした場合のみ各種メソッドが実行されました。

Awake関数はチェックボックスをOFFにしている場合も呼び出される点に注意してください。

以下のスクリプトをチェックボックスをOFFにした状態でシーンを再生してみます。

・EnableTest2.cs

using UnityEngine; public class EnableTest2 : MonoBehaviour { void Awake() { Debug.Log("EnableTest Awake"); } void Start() { Debug.Log("EnableTest Start"); } }

以下の通りチェックボックスをOFFにしていてもAwake関数が実行されました。

以下の前回記事の続きです。

bluebirdofoz.hatenablog.com

アノテートはレイヤーごとにグループ化して色や線の太さの変更を行うことができます。

[アノテーション]のプルダウンを開いて現在のレイヤーを確認できます。

[+]ボタンをクリックして新しいレイヤーを追加できます。

レイヤーの追加を行わない場合、新しいアノテートを描き込んでも全て同じレイヤーとして扱われます。

追加したレイヤーを選択した状態でアノテートを描き込みます。

すると以下のようにレイヤーごとにアノテートの色分けなどを行うことができます。

以下のようにレイヤーごとに色や線の太さなどを変更することができます。

レイヤー名右側の目玉アイコンをクリックしてレイヤーの表示/非表示を切り替えることができます。

0(透明)~1(不透明)の間で透明度を変更することができます。

1~10の間で線の太さを変更することができます。

アノテートは通常、現在表示中のフレームに描き込まれます。

以下の場合アノテートはフレーム1に描き込まれています。

フレームのロックを有効にした場合、どのフレームにいるときも[フレームx(ロック)]と記載されたフレームにアノテートが描き込まれます。

以下の画面ではフレーム20に移動してアノテートに追加の描き込みを行っていますが、追加の描き込みはフレーム1に行われています。

以下はフレームのロックを行っていないレイヤーで描き込みを行った場合です。

フレーム20で追加の描き込みを行ったため、フレーム20に新たにアノテートが追加されてそこに追加の描き込みが行われます。

このため、フレーム20ではフレーム1で描き込んだアノテートが見えなくなっています。

Blenderのアノテート機能は様々なウィンドウ上で利用できる書き込み機能です。

docs.blender.org

3Dビューポートやノードエディタ―など様々なウィンドウ上で[アノテート]ボタンから利用できます。

アノテートには以下の4つのサブツールが存在します。

フリーハンドのラインを描画します。

ペンのように自由にラインを描きこむことができます。

クリックとドラッグで直線のラインを描画します。

オプションでラインの開始と終了の矢印スタイルを選択できます。

クリック毎にラインを直線に繋ぐ点を打ちこみラインを描画します。

Escを押して終了します。

クリックとドラッグで線を削除します。

アノテートは自由に消すことができ、アノテートラインはラインごとにアノテートポリゴンは点ごとに消すことができます。

やりたかったやつ、ついに出来た。

広域3D Gaussian Splatting!

京都清水寺の参道600mを約2万枚の画像から3D復元。

せっかくだから体験可能な形でも用意したいな。#GaussianSplatting pic.twitter.com/WTlMgX9bm1— 龍 lilea (@lileaLab) May 7, 2024

2024/10/17に正式リリースされた「Unity6」のVFX Graphの新機能を早速使ってみた。

VFX GraphがWebビルドしたものでも再生できるというもの。

SplatVFXを使って3D Gaussian Splattingを表示しました。

『京都産寧坂3DGS』

https://works.lilea.net/3d-digital-archive/kyoto-sanneizaka/

参道全域、約600m程の道程を体験できるバージョン。

こちらの実行ファイルの一般公開はまだしてませんでして、オフラインイベントでの展示にて体験いただいてます。

諸々の最適化等が完了したら一般公開も予定。

そんな大規模 広域な3D Gaussian Splattingをどうやって処理したのか。

建築情報学会ミートアップにてライトニングトークしました。

本日 (10/21) 情報解禁!

『CGWORLD 2024 クリエイティブカンファレンス』に登壇させていただく事になりました。

こちらで広域な3D Gaussian SplattingのワークフローとTIPSについてお話させていただきます。

『地上撮影による広域大規模3D Gaussian Splattingの生成ワークフロー&TIPS』

]]>

ショートカットキーの移動量入力に数式を利用するアドバンストモードについては以下の前回記事を参照ください。

bluebirdofoz.hatenablog.com

デフォルトで数式を利用したい場合はメニューから[編集 -> プリファレンス]を開きます。

プリファレンスダイアログが開くので[入力]タブを開きます。

[デフォルトを詳細な数値入力に]のチェックを入れます。

これでデフォルトでアドバンストモードとなり、数値入力で数式を利用できるようになります。

試しに数値入力を行ってみます。

[G -> X -> 2 -> * -> 2]キーを連続で入力すると以下の通り、[2*2]の数式が計算されて4mオブジェクトが移動しました。

通常時、数値入力は数字のみを受け付けるシンプルモードで動作します。

数値入力で数式を利用するには入力モードをアドバンストモードに切り替える必要があります。

docs.blender.org

アドバンストモードでは[+],[*],[/]などPythonの基本演算が利用できるようになります。

切り替えには[=]または[NumpadAsterisk]キーを入力します。

試しにシンプルモードのままショートカットキーで数値入力を行ってみます。

X軸方向の移動を行うため、[G -> X]キーを入力します。

この状態で次に[2 -> * -> 2]キーを入力します。

シンプルモードで数字のみ受け付けるため、[*]キーは無視されて22mオブジェクトが移動しました。

次にアドバンストモードを試します。[G -> X]キーを入力した後、[=]キーを入力します。

すると以下のように入力式の表示が切り替わります。

この状態で次に[2 -> * -> 2]キーを入力します。

アドバンストモードに切り替わっているため、[2*2]の数式が計算されて4mオブジェクトが移動しました。

ちなみにプロパティウィンドウなどのUI入力ではそのまま数式が利用できます。

以下の通り、[2 * 2]を入力すると4mオブジェクトが移動しました。

以下のような複数のオブジェクトはまとめて回転/拡縮する場合と個別に回転/拡縮する場合では基準点が変わるため結果が異なります。

全てのオブジェクトをまとめて移動/回転/拡縮する場合は3Dビューポートの[選択 -> すべて]を実行します。

これで全てのオブジェクトが選択状態になります。

移動を行う場合は左側の移動ボタンをクリックして移動ツール状態に移行します。

矢印をドラッグすることでオブジェクトを移動できます。

このとき選択中の全てのオブジェクトが移動に追従します。

操作ウィンドウが表示されるので本ウィンドウから詳細な数値を入力して操作することもできます。

全選択中であってもプロパティウィンドウのトランスフォームを変更した場合は対象オブジェクトのみが移動するので注意が必要です。

回転/移動は同様に全選択状態で回転/移動ボタンをクリックして各種ツール状態に移行して行うことができます。

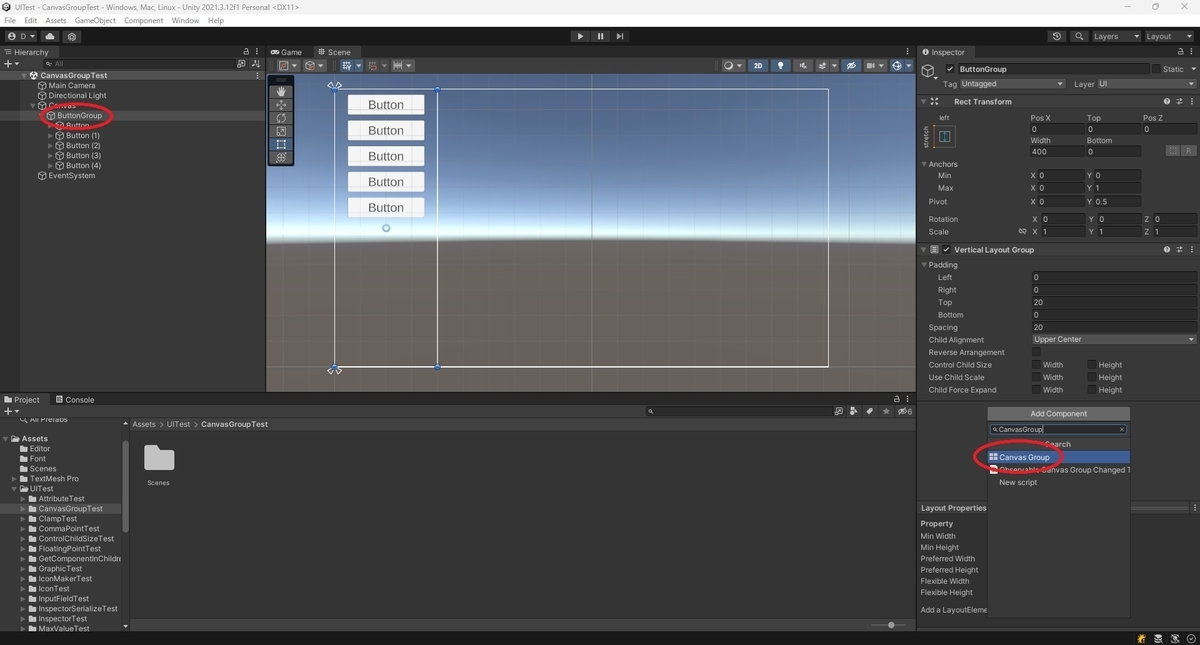

CanvasGroupはUI要素のグループ全体に対する特定の機能を与えます。

CanvasGroupのプロパティはそのコンポーネントがアタッチされているゲームオブジェクトと全ての子要素に影響を与えます。

docs.unity3d.com

以下のように子要素に全てのボタンオブジェクトを配置したサンプルシーンを用意しました。

CanvasGroupを使ってUIをグループ単位で管理するにはUIの親オブジェクトに[CanvasGroup]コンポーネントを追加します。

シーンを再生して動作を確認します。

CanvasGroupコンポーネントの[Interactable]のチェックを外すと、全ての子要素が入力を受け付けなくなります。

この状態はButtonコンポーネントであればButtonコンポーネントの[Interactable]のチェックを外した状態と同様です。

InteractableとBlockRaycastsはどちらもチェックを外すと入力を受け付けなくなりますが、BlockRaycastsはチェックを外すとレイキャスト自体を素通りさせるようになります。

以下の2つのボタングループを重ね合わせたサンプルシーンで動作を確認してみます。

[Interactable]のチェックを外した場合ボタンは入力を受け付けませんが、レイキャストは遮蔽するため背後のボタンを押すことはできません。

[BlockRaycasts]のチェックを外した場合ボタンは入力を受け付けず、さらにレイキャスト自体が素通りするため背後のボタンが押下されます。

CanvasGroupはUI要素のグループ全体に対する特定の機能を与えます。

CanvasGroupのプロパティはそのコンポーネントがアタッチされているゲームオブジェクトと全ての子要素に影響を与えます。

docs.unity3d.com

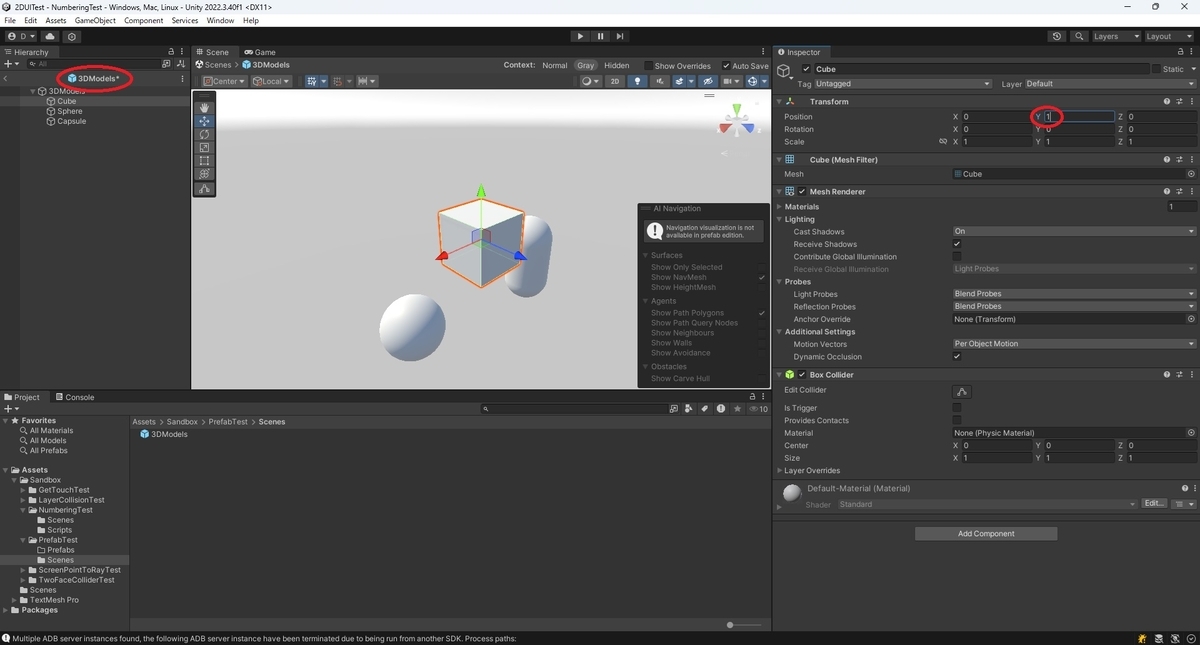

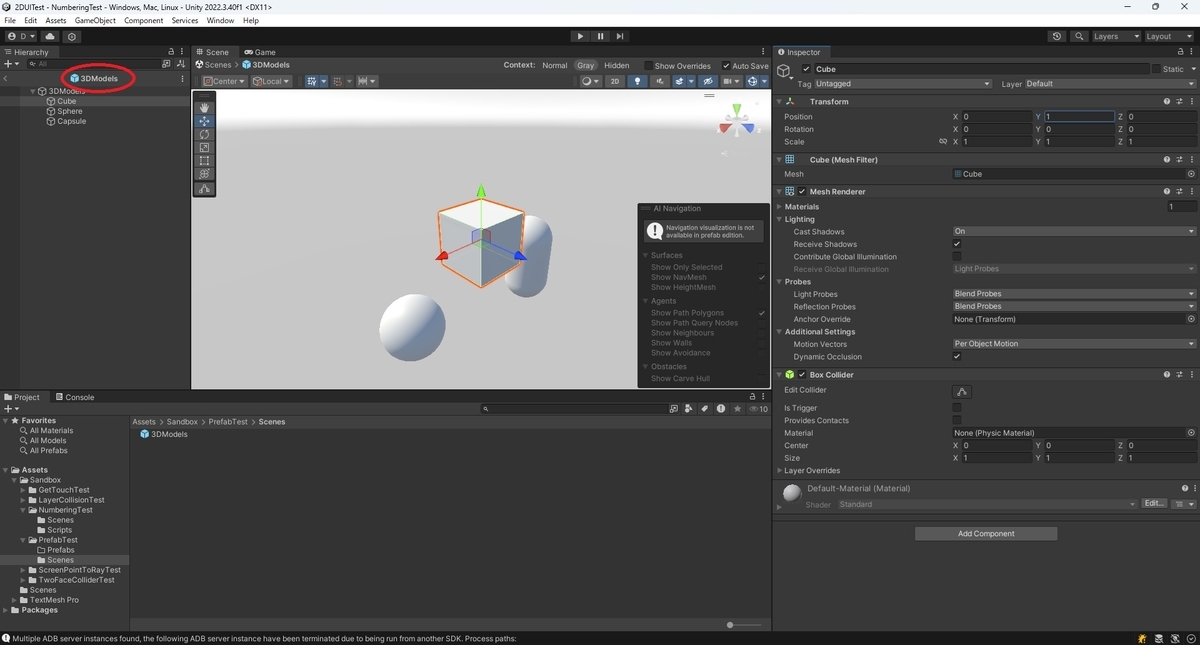

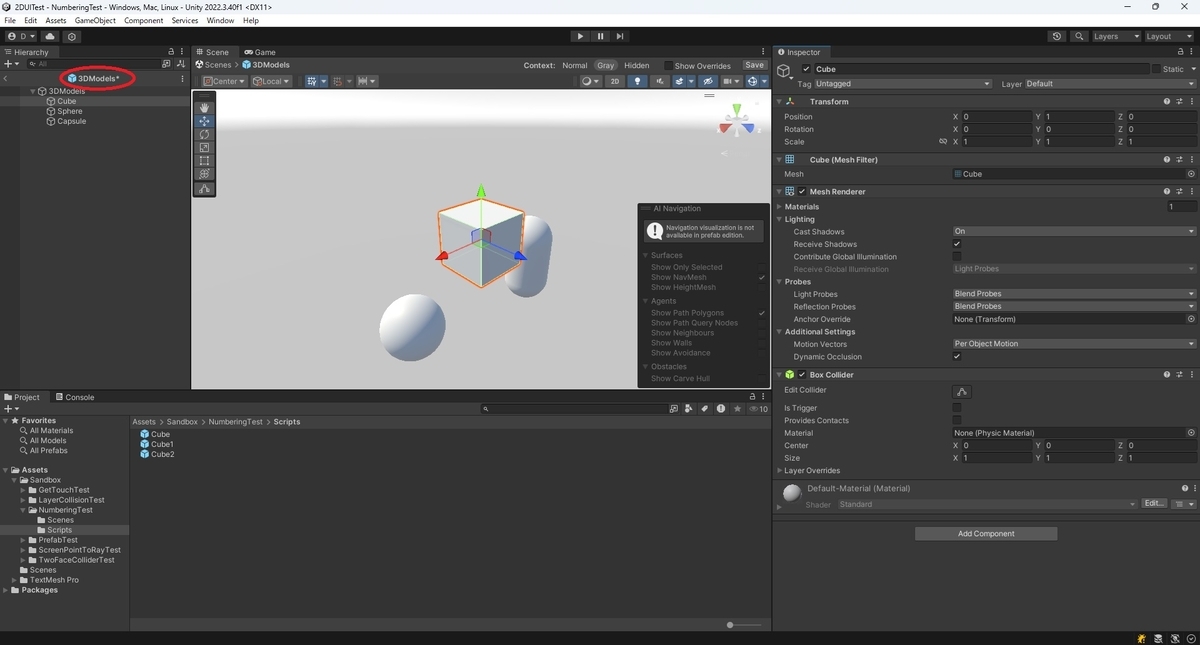

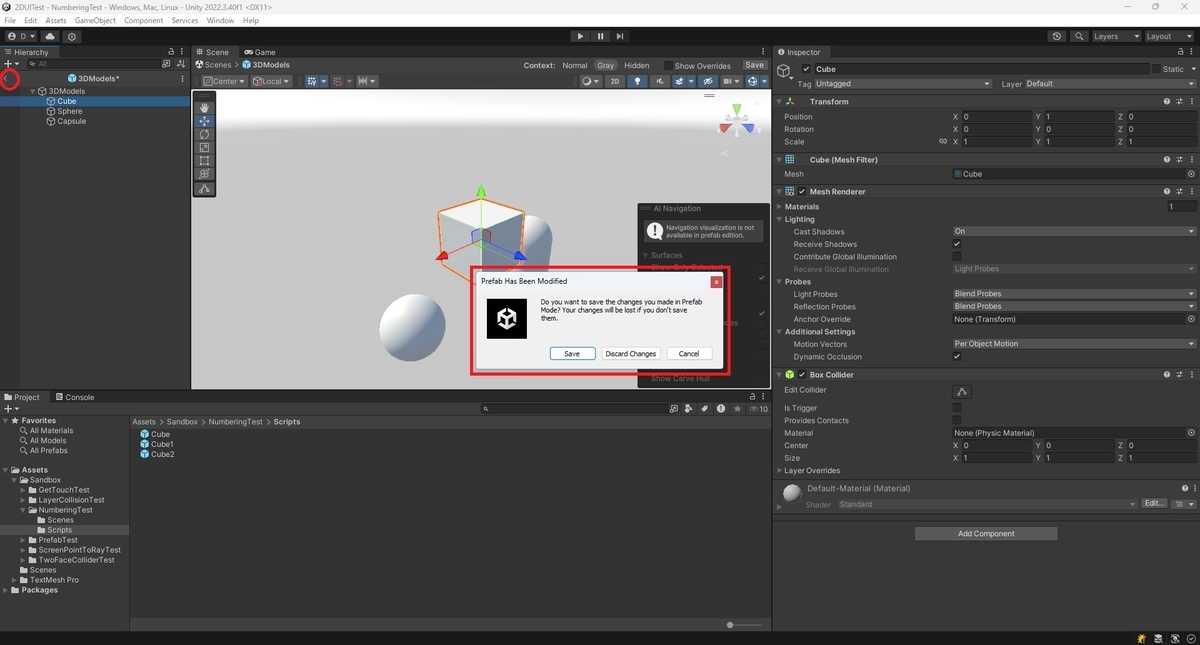

エディターのデフォルト設定ではプレハブの編集の自動保存が有効になっています。

以下のようにプレハブの内容を編集した場合、編集項目からフォーカスが外れるタイミングで編集内容が自動保存されます。

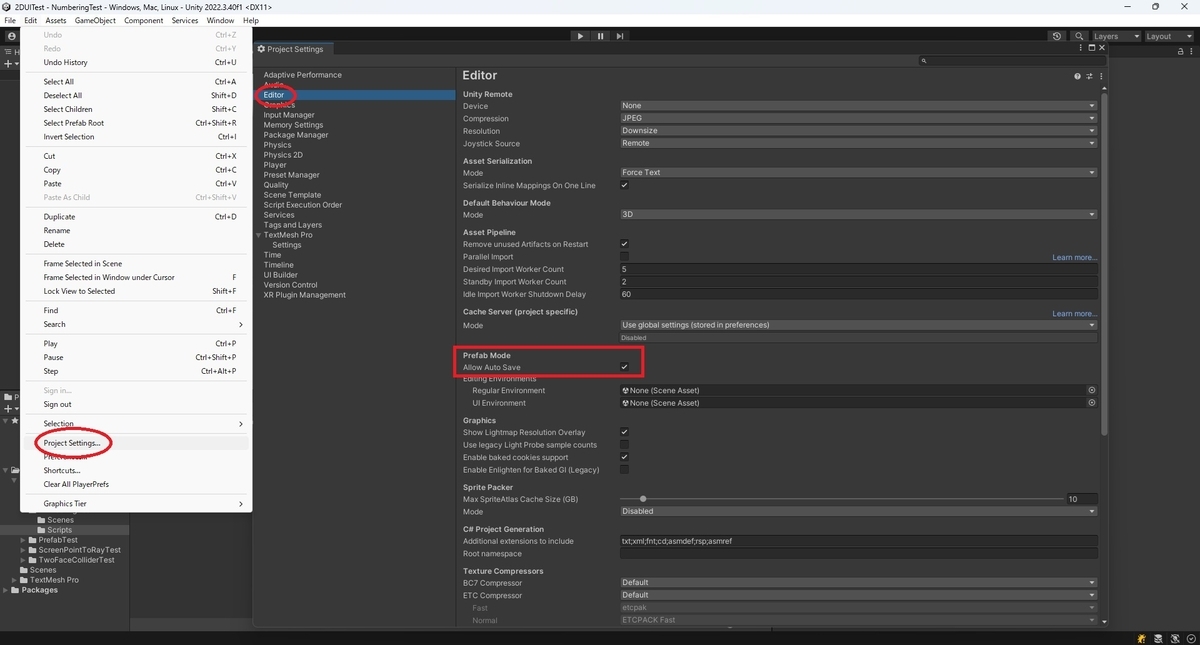

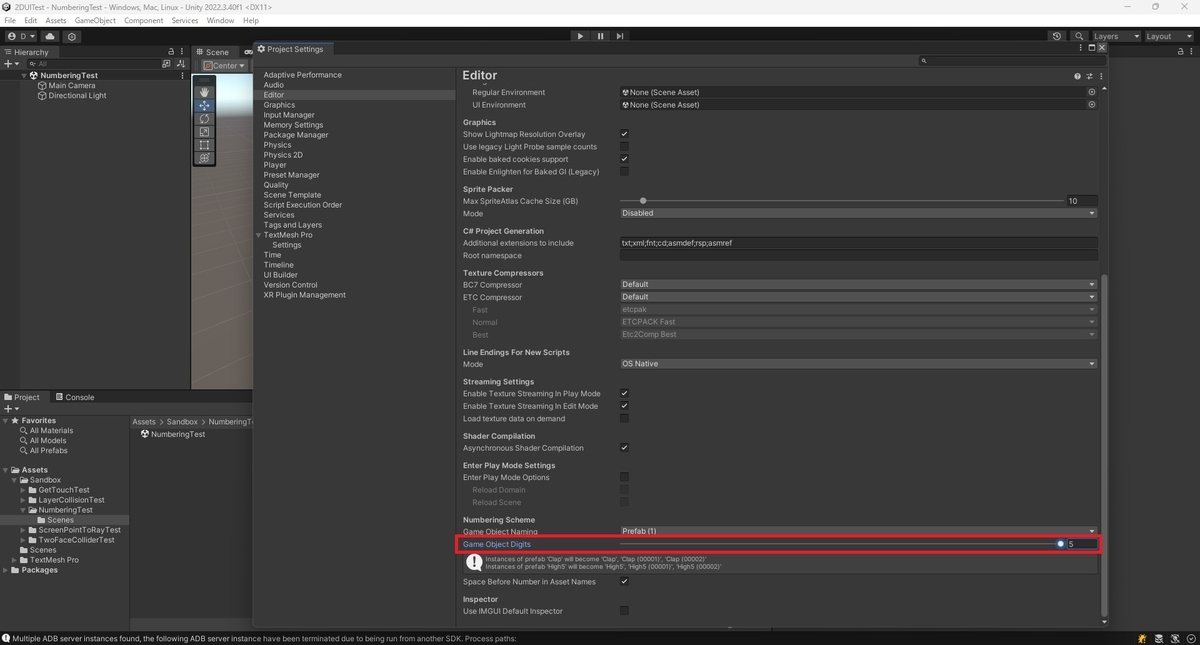

メニューから[Edit -> Project Settings..]を開き、[Editor]タブを開きます。

[Prefab Mode]項目の[Allow Auto Save]で自動保存の有効/無効を切り替えることができます。

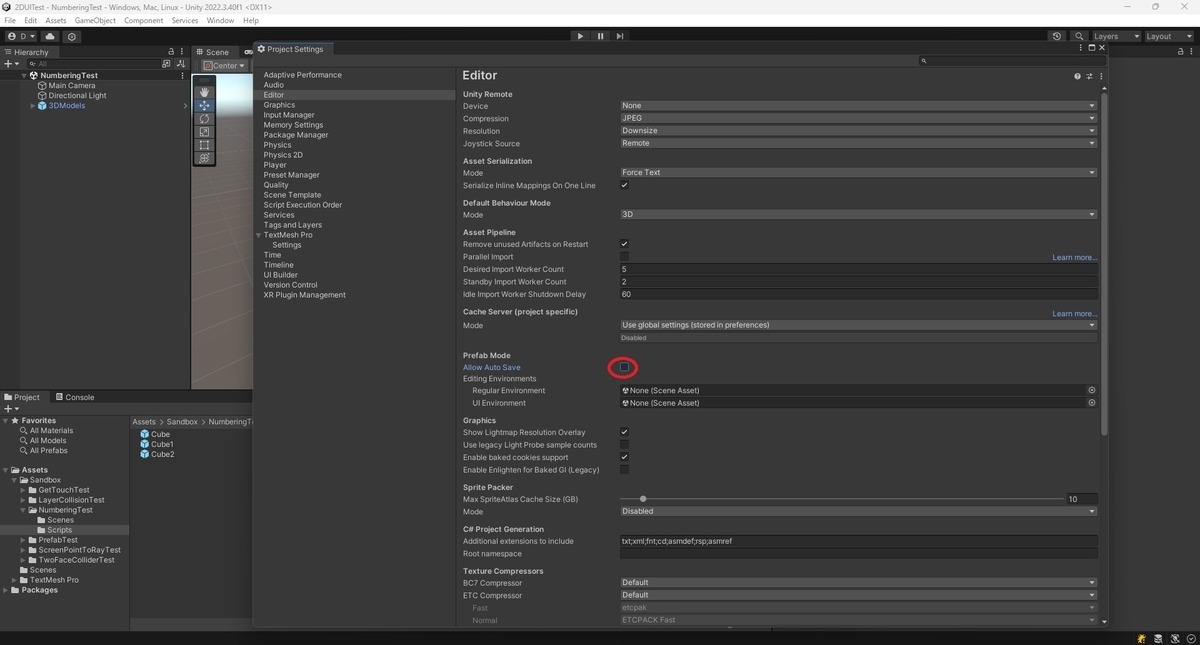

以下のようにチェックを外すとプレハブの編集で自動保存が無効になります。

無効時はプレハブの編集から抜ける際に、未保存の変更があった場合は確認ダイアログが表示されます。

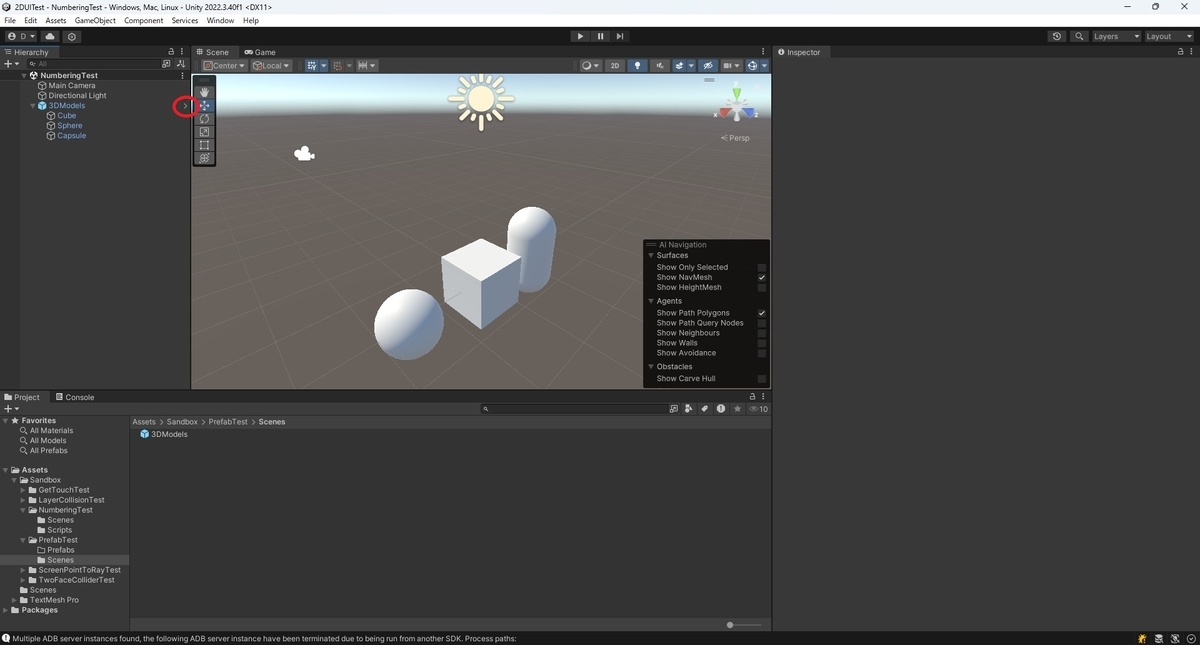

メニューから[Edit -> Project Settings..]を開き、[Editor]タブを開きます。

[Numbering Scheme]項目で名前が重複した場合の命名規則を変更できます。

[Game Object Numbering]は命名規則の接尾辞を変更します。

Hierarchy上でオブジェクト名が重複した場合の命名規則は以下の3種類からの選択となります。

・Prefab (1)

・Prefab.1

・Prefab_1

命名規則を変更すると以下の通りHierarchy上でオブジェクトを複製したときの命名規則が変わります。

あくまで生成時の命名規則を変更する設定のため、すでに生成済みのオブジェクト名は変更されません。

[Game Object Digits]は命名規則の連番の桁数を1~5桁の範囲で変更します。

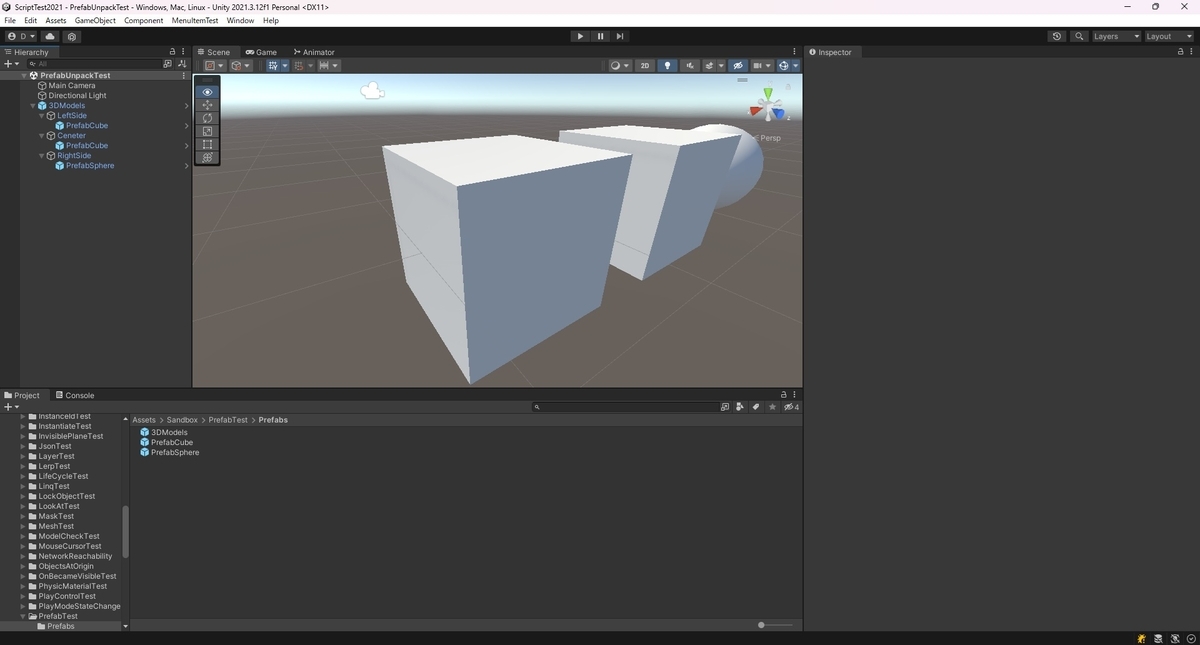

プレハブのUnpackを行うとプレハブインスタンスが展開されて通常のゲームオブジェクトに戻ります。

これによりプレハブの参照を切ることができ、アセット内のプレハブを変更しても影響を受けなくなります。

docs.unity3d.com

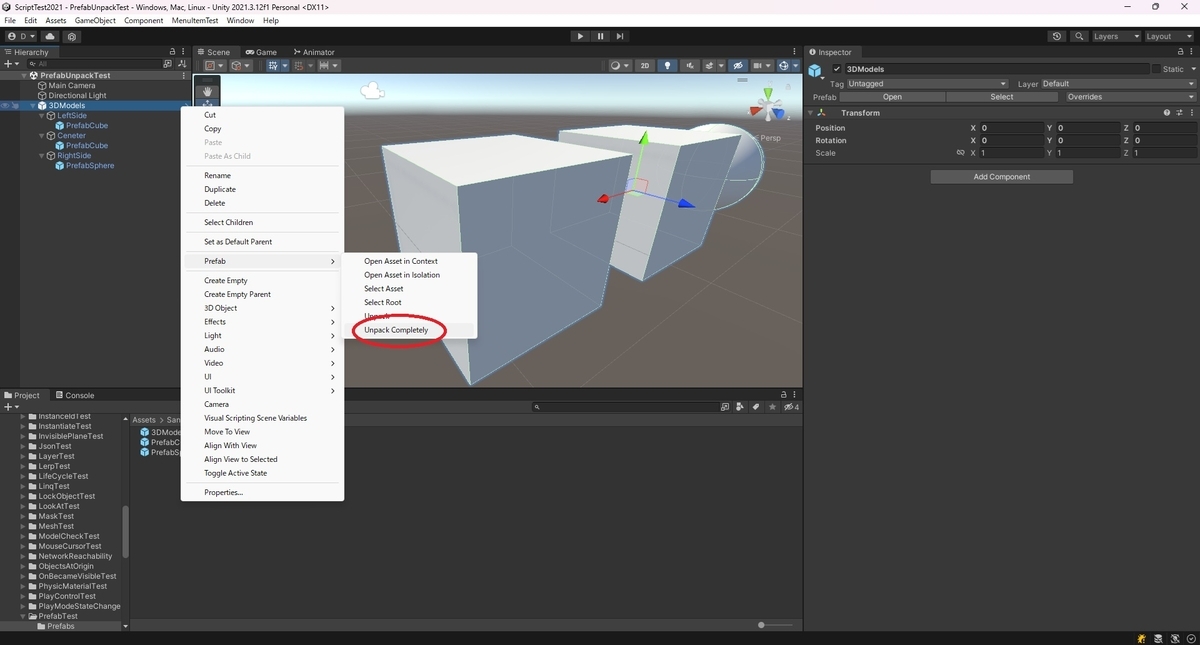

Hierarchyのプレハブインスタンス上で右クリックから[Prefab -> Unpack]を実行します。

これでプレハブインスタンスが展開されます。

Unpackでは選択したプレハブのみが展開され、その配下のプレハブは展開されません。

配下を含めて全てのプレハブインスタンスを展開する場合は[Prefab -> Unpack Completely]を実行します。

以下の通りUnpack Completelyでは配下も含めて全てのプレハブは展開されます。

プレハブバリアントにUnpackを実行した場合、プレハブバリアントへの参照のみが展開されます。

このため、以下のように展開後のプレハブインスタンスが残ります。

プレハブバリアントで設定していたオーバーライドはシーンのオーバーライド設定として残ります。

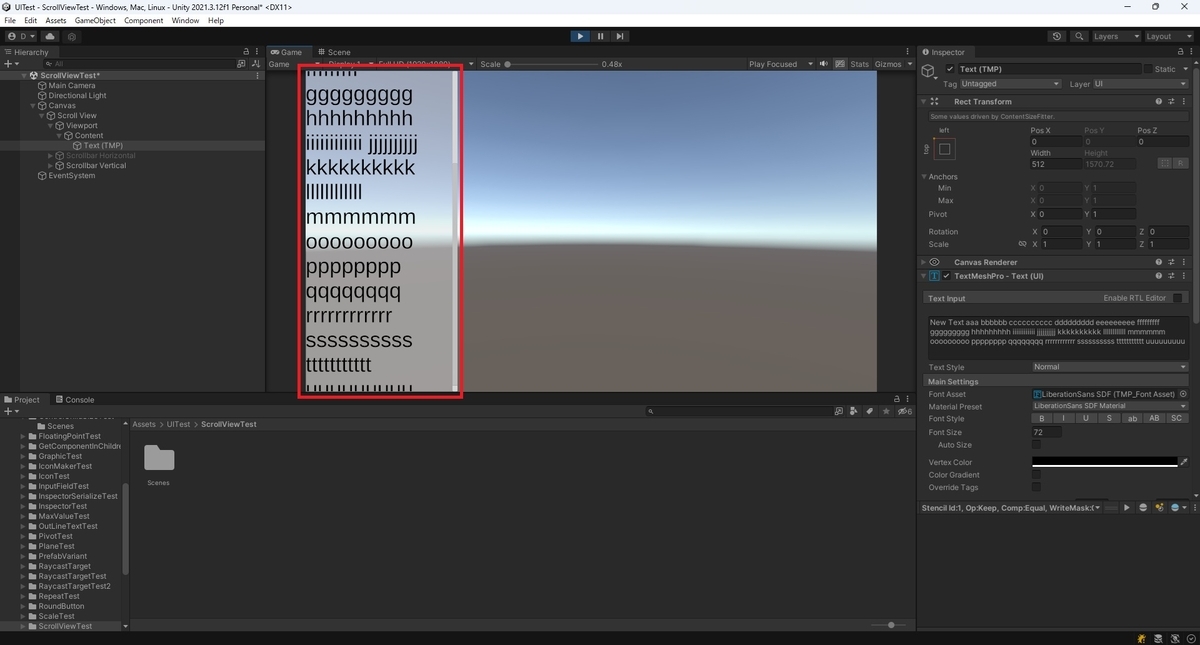

ContentSizeFilterを利用するとTextオブジェクトの改行に合わせて高さのサイズを自動調整できます。

docs.unity3d.com

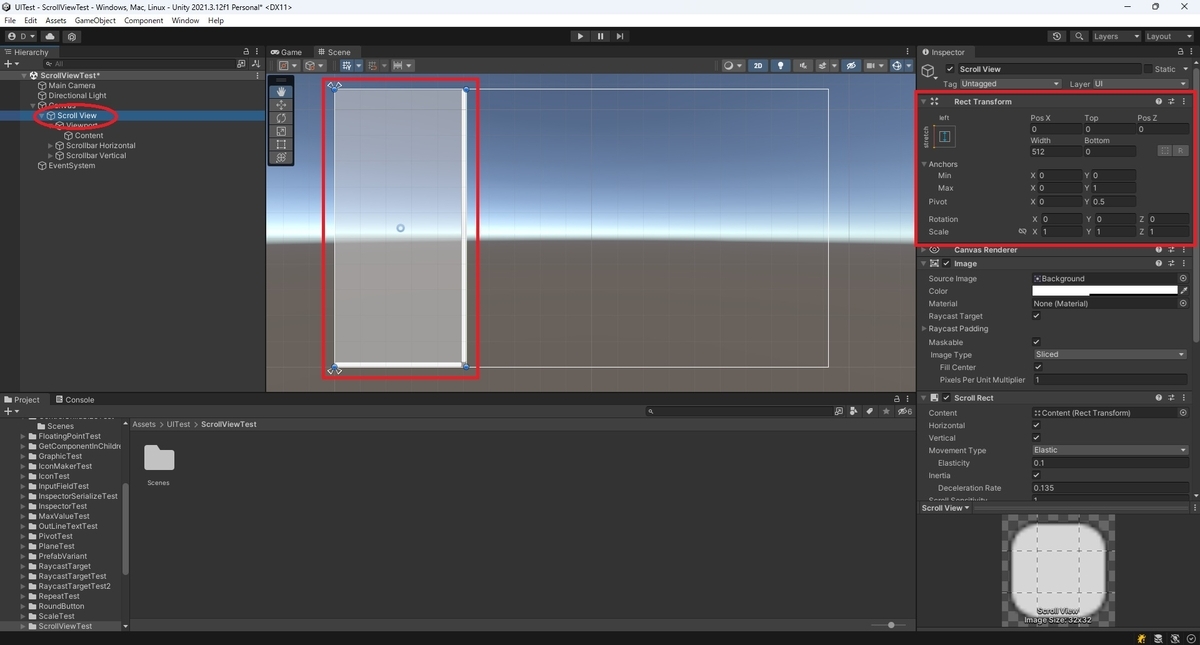

Hierarchyで右クリックから[UI -> ScrollView]でScrollViewオブジェクトを追加します。

今回は文字列を立てスクロールするViewを作成します。

ScrollViewは縦方向をStretchで詰めたレイアウトで設定しました。

ScrollViewオブジェクトのInspectorビューを開き、ScrollRectコンポーネントの[Horizontal]のチェックボックスを外します。

これで横方向のスクロールが無効となります。

Contentオブジェクト配下に右クリックから[UI -> Text]でTextオブジェクトを追加します。

こちらもピボットの設定を変更し、上方向に詰めたレイアウトで配置します。

Textコンポーネントの[Overflow]を[Scroll Rect]に変更します。

これで文字数が横幅以上になった場合は自動で改行するようになります。

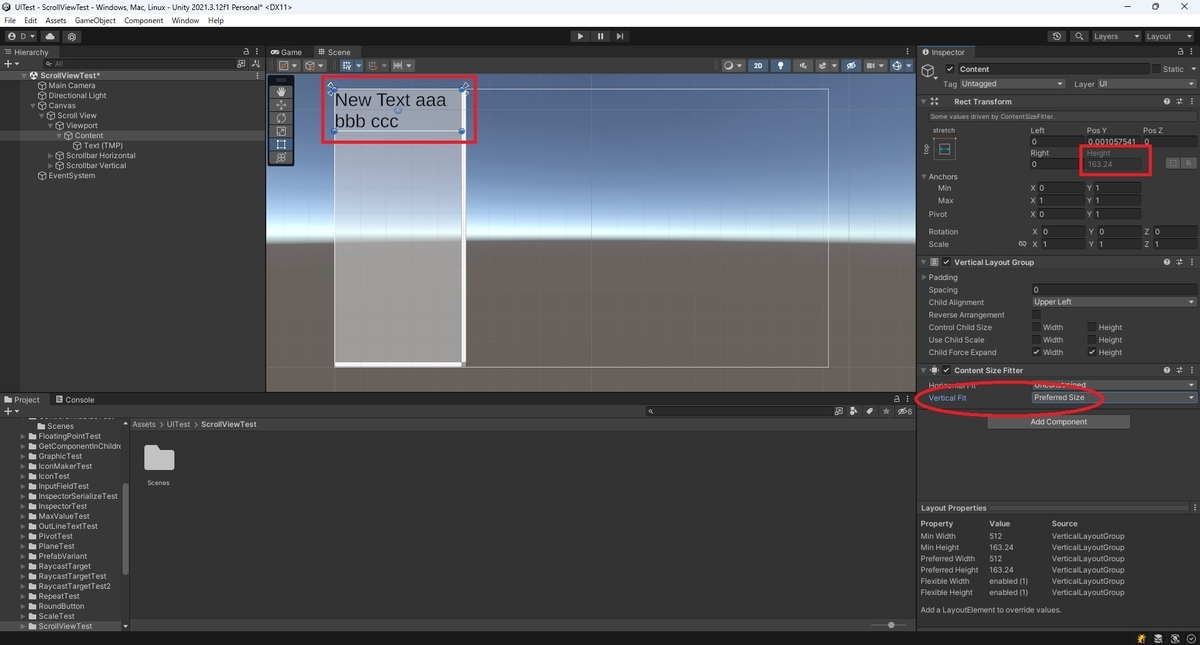

Content Size Fitterコンポーネントを追加し、文字数に応じてオブジェクトサイズが自動調整されるようにします。

[Vertical Fit]を[Preferred Size]に設定すると文字の改行に合わせて縦方向のサイズが自動調整されるようになります。

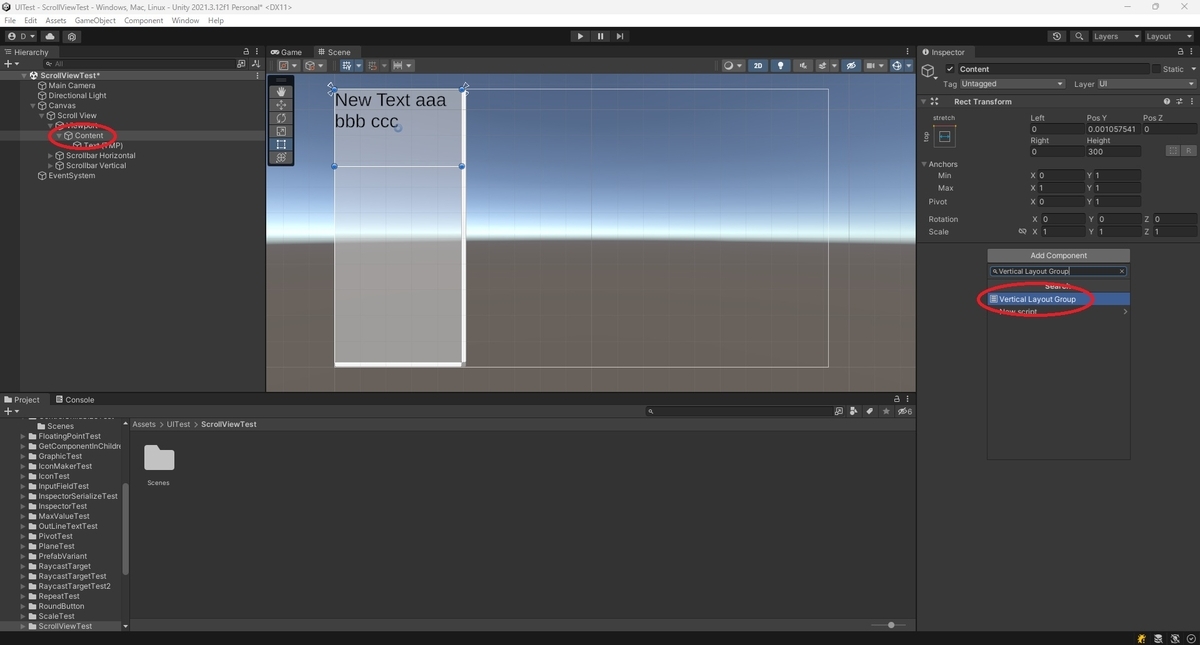

最後にContentオブジェクトが配下のTextコンポーネントに合わせてサイズが自動調整されるようにします。

こちらはVertical Layout GroupコンポーネントとContent Size Fitterコンポーネントを追加します。

こちらも[Vertical Fit]を[Preferred Size]に設定します。

これで配下のTextオブジェクトに合わせて縦方向のサイズが自動調整されるようになります。

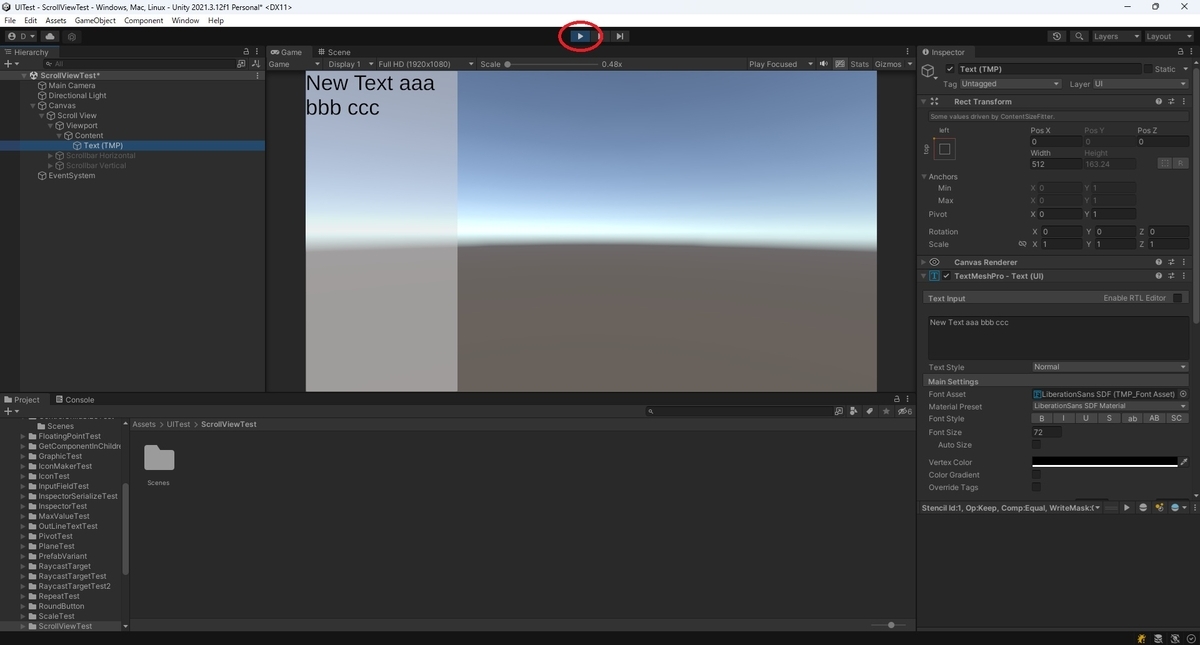

シーンを再生して動作を確認します。

Textコンポーネントに収まりきらない文字数の文字を入力すると、Contentオブジェクトの縦サイズが自動で大きくなり、縦スクロールが有効になります。

Unityで文字数に合わせてスクロールできるScrollViewを作成できました。

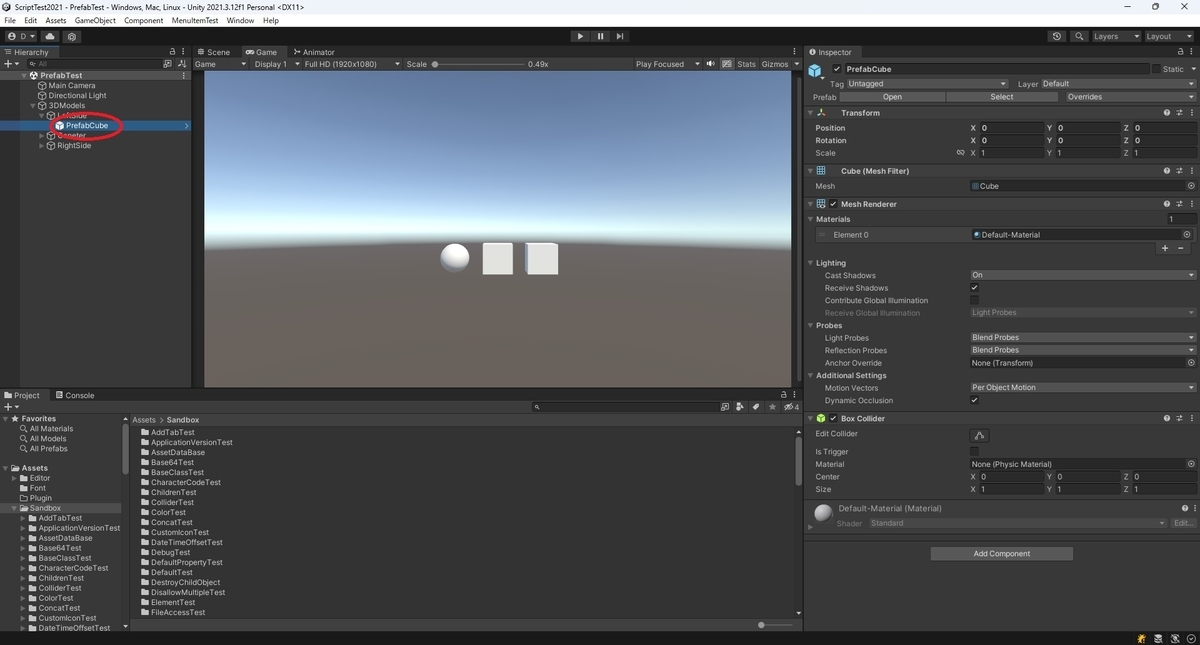

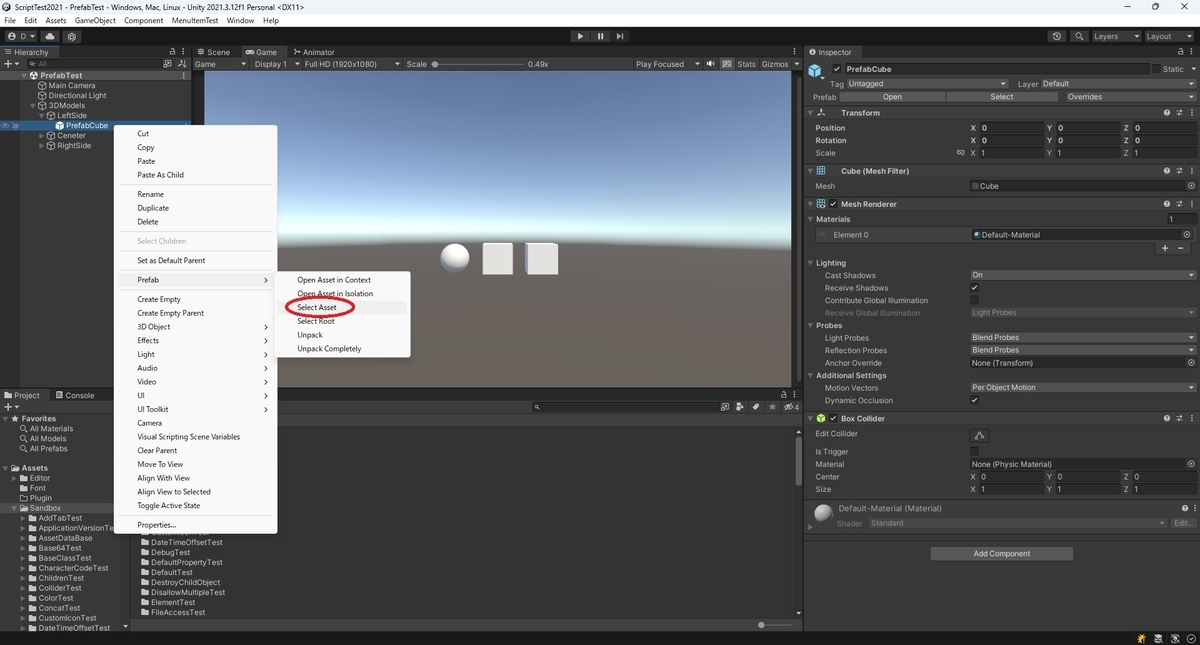

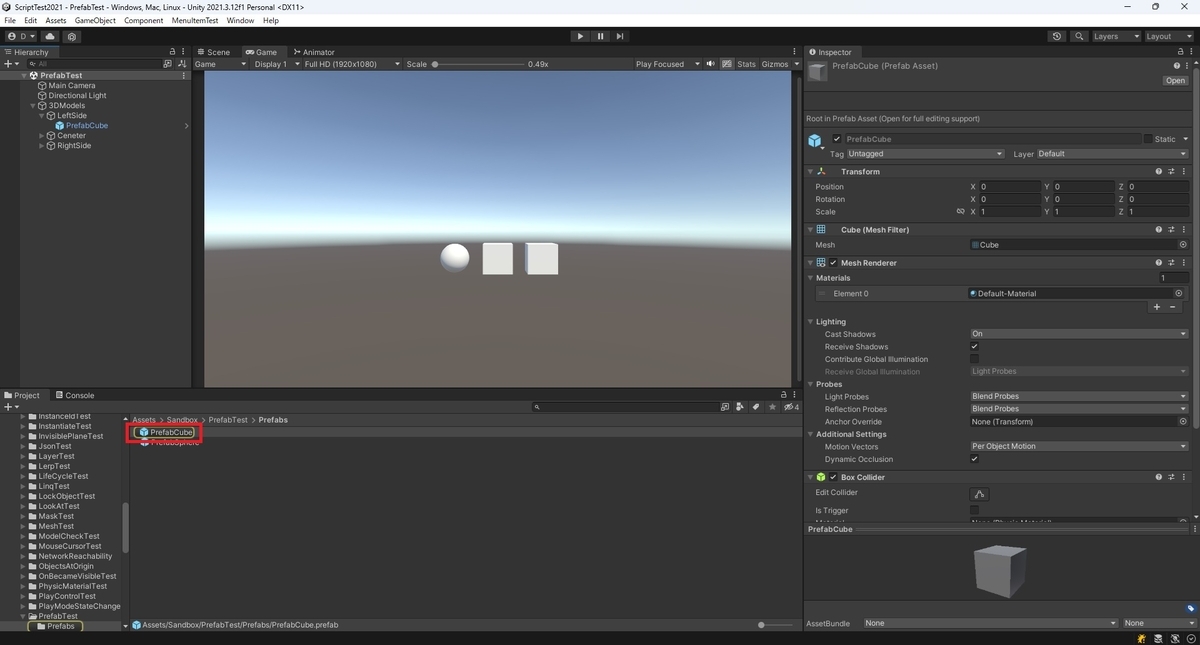

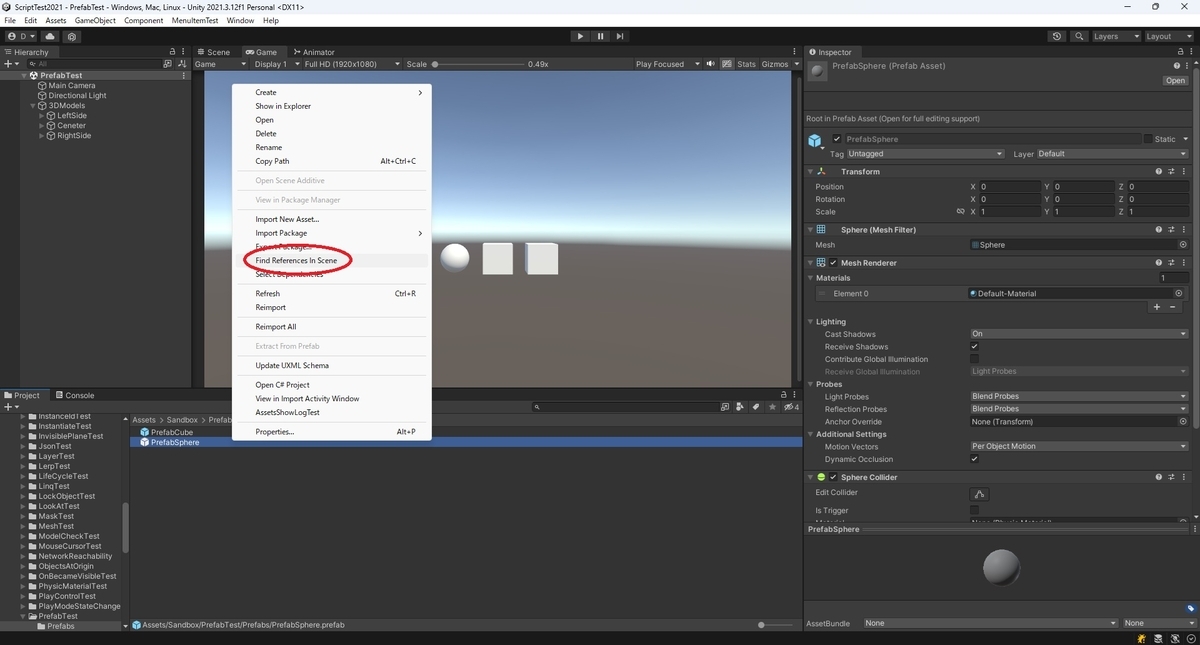

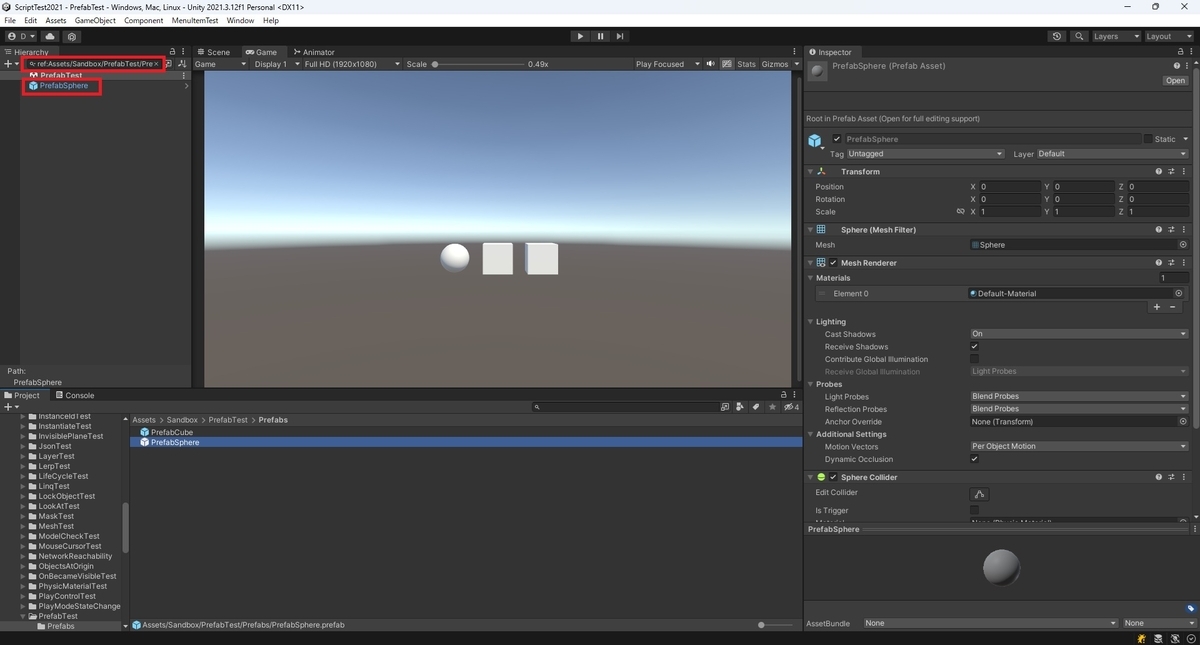

以下のようなシーン内に配置されているプレハブオブジェクトの参照元を調べます。

対象のプレハブを選択した状態で右クリックから[Prefab -> Select Asset]を実行します。

これでProjectウィンドウが遷移して参照元のアセットファイルが表示されます。

逆にアセットからシーン内の利用先を検索するにはアセットファイルを選択した状態で右クリックから[Find References In Scene]を実行します。

これでHierarchyウィンドウに検索ワードが入力されます。

現在開いているシーン内でプレハブが利用されている場合はオブジェクトを見つけることができます。

Vertical Layout Groupコンポーネントを利用すると子のレイアウト要素を垂直方向に調整して配置します。

本コンポーネントの設定を利用することで子要素を比率でサイズ調整できます。

docs.unity3d.com

以下の2つのScrollViewをVerticalLayoutGroupコンポーネントを使って1:2のサイズで調整してみます。

1つ上の親オブジェクトにVerticalLayoutGroupコンポーネントを追加します。

VerticalLayoutGroupコンポーネントの以下の3つの高さ調整項目すべてにチェックを入れます。

| 項目名 | 説明 |

|---|---|

| Control Child Size | レイアウトグループが子レイアウト要素の幅と高さを制御するかどうか |

| Use Child Scale | レイアウトグループが要素のサイズ調整やレイアウトを行う際に、その子レイアウト要素のスケールを考慮するかどうか |

| Child Force Expand | 付加的な使用可能なスペースを埋めるために、子レイアウト要素を強制的に拡大するかどうか |

[Use Child Scale]にチェックを入れていると子オブジェクトのサイズ調整にスケールが考慮されます。

片方のScrollViewの高さのスケールを 1 から 2 に変更してみます。

以下の通り、2つのScrollViewが1:2のサイズに自動で調整されました。

下記のイベント・展示会への出展を予定しています。

皆様のご参加・来場をお待ちしております!

下記のイベント・展示会への出展を予定しています。

皆様のご参加・来場をお待ちしております!

イベントURL/来場登録 はこちら↓ www.nikkanseibu-eve.com

小間ブース位置:B館S-33

【展示内容】

詳細については下記よりお問い合わせください。

]]>UniRxの環境構築手順は以下の記事を参照ください。

bluebirdofoz.hatenablog.com

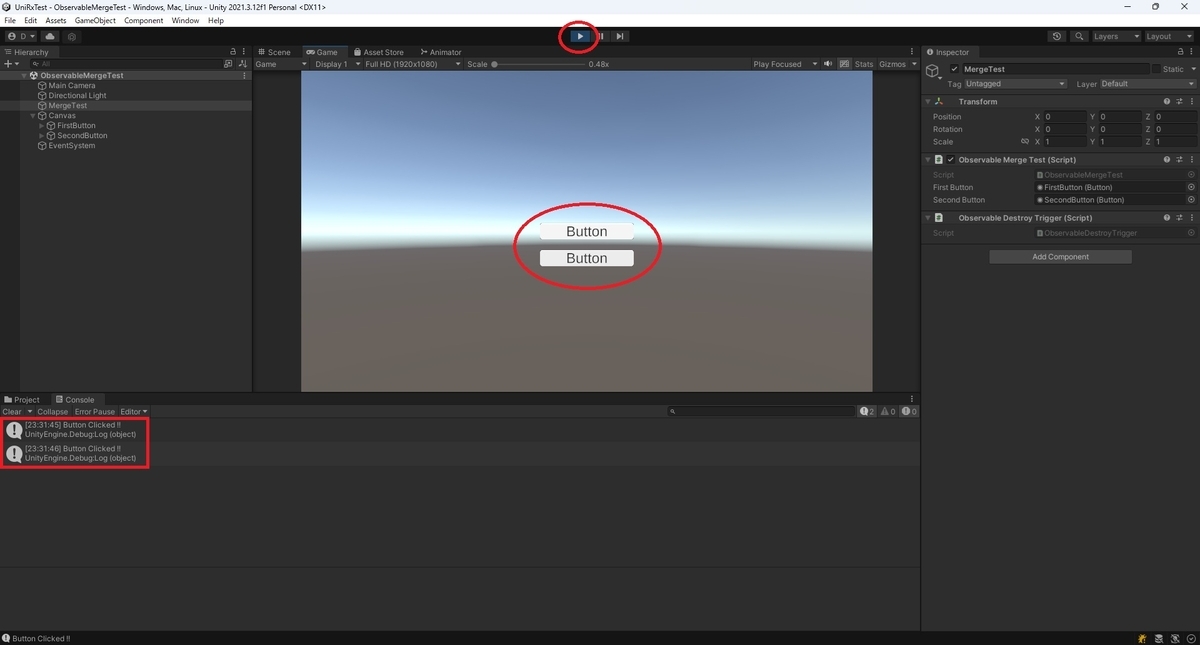

UniRxのMergeオペレータを使うことで複数のObservableを1つのストリームにまとめることができます。

IObservable<Unit> firstButtonObservable = firstButton.OnClickAsObservable(); IObservable<Unit> secondButtonObservable = secondButton.OnClickAsObservable(); Observable.Merge( firstButtonObservable, secondButtonObservable ).Subscribe(_ => Debug.Log($"Button Clicked !!"))

2つのボタンのクリックイベントに対して同様のログ出力の処理を行う以下のサンプルスクリプトを作成しました。

・ObservableMergeTest.cs

using System; using System.Collections.Generic; using UniRx; using UnityEngine; using UnityEngine.UI; public class ObservableMergeTest : MonoBehaviour { [SerializeField] private Button firstButton; [SerializeField] private Button secondButton; void Start() { List<Button> buttons = new List<Button>() { firstButton, secondButton, }; IObservable<Unit> firstButtonObservable = firstButton.OnClickAsObservable(); IObservable<Unit> secondButtonObservable = secondButton.OnClickAsObservable(); Observable.Merge( firstButtonObservable, secondButtonObservable ).Subscribe(_ => Debug.Log($"Button Clicked !!")) .AddTo(this); } }

2つのButtonコンポーネントを設定したサンプルシーンを用意して動作を確認します。

どちらのボタンを押下しても同じ処理が呼び出されることが確認できます。

以下のようにObservableから直接Mergeオペレータを記述することもできます。

IObservable<Unit> firstButtonObservable = firstButton.OnClickAsObservable(); IObservable<Unit> secondButtonObservable = secondButton.OnClickAsObservable(); firstButtonObservable.Merge( secondButtonObservable ).Subscribe(_ => Debug.Log($"Button Clicked !!")) .AddTo(this);

HelpURL属性はスクリプトに独自のドキュメントURLを指定します。

docs.unity3d.com

指定したURLはコンポーネント右上の[?]マークのアイコンから開くことができます。

HelpURL属性を指定した以下の自作スクリプトを作成しました。

using UnityEngine; // ヘルプページのURLを指定 [HelpURL("https://bluebirdofoz.hatenablog.com/")] public class PresetTest : MonoBehaviour { [SerializeField] private int presetInt = 0; [SerializeField] private string presetString = "preset"; [SerializeField] private bool presetBool = false; }

任意のオブジェクトにコンポーネントを設定し、[?]マークのアイコンをクリックします。

ブラウザが立ち上がり、指定したURLが開きます。

自作スクリプトのヘルプページがある場合はURLを設定しておくと便利です。

Inspectorビューの任意のコンポーネントの右上に[?]マークのアイコンがあります。

本アイコンをクリックすると対象のコンポーネントの公式ドキュメントページが開きます。

使用方法が不明なコンポーネントはこれで簡単にヘルプを参照することができます。

なおヘルプページは使用しているエディターバージョンのページが開きます。

異なるバージョンのドキュメントを確認したい場合は左上のプルダウンから切り替えます。

自作スプリプトはデフォルトではヘルプアイコンをクリックしても存在しないURLが開きます。

以下のHelpURL属性をスクリプトに記述することで任意のページを開くように設定することができます。

bluebirdofoz.hatenablog.com

以下の前回記事の続きです。

bluebirdofoz.hatenablog.com

プリセットをデフォルト設定として利用するにはアセットを選択し、Inspectorビューから設定を行います。

[Add to (対象コンポーネント名) default]のボタンをクリックします。

これでプリセットが対象コンポーネントのデフォルト設定として利用されるようになります。

試しにBoxColliderコンポーネントをAdd Componentから追加するとプリセットの設定で作成されました。

本設定はCubeオブジェクトなど予め用意されたオブジェクトでも有効です。

以下の通り、Cubeオブジェクトを生成した場合でもプリセットの設定が反映されたBoxColliderが適用されています。

デフォルト設定を解除したい場合は再びInspectorビューを開き、[Remove from (対象コンポーネント名) default]をクリックします。

プロジェクト全体に設定されているプリセットのデフォルト設定を確認したい場合は[Edit -> Project Settings]から[Preset Manager]タブを開きます。

プロジェクトで設定している全てのプリセットのデフォルト設定が一覧で表示されます。

本ウィンドウから登録/解除もできます。

docs.unity3d.com

Gameウィンドウはデフォルトでは[Play Focused]の設定が選択されています。

[Play Focused]はシーン再生時に自動でGameウィンドウが開きます。

本項目はプルダウンから以下の3つの設定を切り替えることができます。

| 設定名 | 説明 |

|---|---|

| Play Focused | シーン再生時に自動でGameウィンドウを開く |

| Play Maximized | シーン再生時に自動でGameウィンドウを最大サイズで開く |

| Play Unfocused | シーン再生時にGameウィンドウを開かない |

Gameウィンドウで[Play Unfocused]を選択します。

これでシーン再生時に自動でGameウィンドウが開かないようになります。

[Play Maximized]を選択している場合はシーン再生時に自動でGameウィンドウが最大サイズで開きます。

Save Selection/Load SelectionはHierarchyの選択状態を保存する機能です。

最大10パターンの選択状態を保存しておくことができます。選択状態の読み込みは同じシーンでのみ有効です。

Hierarchy上のオブジェクトを1つ以上選択した状態で[Edit -> Selection]から任意の番号の[Save Selection]を実行します。

同じシーンで保存した番号と同じ[Load Selection]を実行すると選択状態が読み込まれて反映されます。

Save Selection/Load Selectionは以下のショートカットキーで利用可能です。

ショートカットキーで本機能を利用すると任意の選択状態にすぐ戻ることができるため、作業効率が上がります。

| 機能 | ショートカットキー |

|---|---|

| Save Selection | Ctrl + Alt + (0~9の任意の番号キー) |

| Load Selection | Ctrl + Shift + (0~9の任意の番号キー) |

Save Selection/Load Selectionは対象のシーンを開いている間のみ保持されます。

プロジェクト設定としては保存されていないため、エディターを再起動すると全てのSelectionがクリアされます。

また別シーンに移動すると元シーンに戻っても異なるシーンと見なされるのかLoad Selectionによる反映ができなくなります。

以下の前回記事の続きです。

bluebirdofoz.hatenablog.com

プリセットの内容を編集する場合はアセットを選択し、Inspectorビューから編集を行います。

この場合、プリセットを適用すると変更を行っていない項目を含めて全ての項目の設定が反映されます。

反映したくない項目がある場合はInspectorビューの項目を右クリックして[Exclude Property]を実行します。

[Exclude Property]を実行した項目には除外項目を示す赤い線が表示されます。

プリセットを適用すると除外項目は反映されず、それ以外の項目のみ設定が反映されます。

本機能を利用することでコンポーネントの一部の設定のみ保存/適用するプリセットが作成できます。

プリセットは任意のプロパティ設定を保存/適用するための機能です。

docs.unity3d.com

ホロラボはこの夏にいくつもの子供向けイベントへ技術提供/出展をしてきました。

その中でも、私たちもとても楽しむことのできた取り組みの事例を紹介します。

2024年8月12日(祝・月)に開催された小学生向けイベント「Minecraftで未来の丸の内をデザインしよう!」にて、ホロラボが開発したXR技術を用いたデジタルツインプラットフォームtorinome(トライノーム)(*1) を活用し、子供たちがマインクラフトで建築した建物を、現実の丸の内ストリートにARで具現化しました。

「Minecraftで未来の丸の内をデザインしよう!」イベントは、Minecraftカップ運営委員会と大手町・丸の内・有楽町 エコキッズ探検隊と株式会社ホロラボでの共同で開催され、会場はMinecraftカップ運営委員会のシルバーパートナーの三菱地所様のスペースにて実施されました。

現実への具現化の流れは大まかに次の通りになっていました。

当イベントを実施した際のプレスリリース記事はこちら prtimes.jp

現実の丸の内にARで具現化された自分の建物に興奮した子供たちは、我先にとiPadの取り合いになりましたし、iPadを手にした瞬間に全力で自分の建てた建物の位置まで走る(300~400mくらいの広範囲に建設したので)など、それについていく大人たちも汗だくになって大変でした笑

お子さんと一緒に参加していたお父さんお母さんからもとても関心を得られ、質問攻めにあいながらも子供たちも追いかけないといけないという、まさに嬉しい悲鳴を上げた1日となりました。

2024年8月7日(水)、8日(木)の二日間に開催された「こども霞が関見学デー」(*3)にて、子供たちが現実のレゴで作った建物をデジタルツイン上の霞が関に建てるという試みを実施しました。

ホロラボは国土交通省にて、PLATEAUプロジェクトの紹介コーナーの一部として、このレゴで建物を作るデジタルツイン体験ブースを提供していました。

企画の背景として、国土交通省が推進するPLATEAUプロジェクトにおいて、霞が関周辺だけPLATEAUの建物データが存在しない状態になっています。

このぽっかりと開いた霞が関の空間に、子供たちで好きな建物や省庁を建ててみよう!というのが、この企画の発端です。

レゴのデジタルデータ化にはScaniverseという無料の3Dスキャンアプリを活用しました。

出来上がったレゴをスタッフでスキャンして3Dデータ化して、それをデジタルツインプラットフォームtorinome Web上に設置。

自分の建物がtorinome Web上の霞が関付近の好きな場所に置かれている様子を、モニター背景に一緒に写真を撮ったりなどして楽しんでいただきました。

当日は実施しませんでしたが、これらのtorinome Web上に設置されたデータは、現実のその場所(つまり霞が関)に行って専用のiPadアプリで覗くだけで、実物大のARで具現化することが容易にできます。

torinome Web上でサイズを自由に変えることができるので、レゴで作った建物を人が入れる大きさにすることも自由にできますし、ARで実際にその建物の中に入ってみることもできちゃいます。

子供たちの中には霞が関を無視して、皇居にお花のお家を建てる子や、海の上に家を建てた子もいました笑

鉄道好きの子は、かつて存在していた鉄道省を東京駅前の広場に建ててみたりと、大人でもびっくりな発想や知識に驚かされ続ける1日となりました。

torinomeは、3Dデータさえあればそれをtorinome Web上の地図の上に置くだけで簡単にその場所にARで具現化することができるデジタルツインプラットフォームですが、そもそもその3Dデータを持っていなかったり、作ることができない人が多いというのが利用者の一つの課題でした。

しかし今回の事例のように、誰でも簡単に作ることができるのであればその問題は一気に解消されます。

マインクラフトは現時点では歴史上世界で最も多く売れたゲームでもあり、最近の子供たちは誰もが遊んだことがあり簡単に扱うことができます。 レゴに関しては大人でも直感的に好きな形を作り上げることができる、世界中で愛されているブロック玩具です。

誰もが扱うことのできる道具で創造したものが、現実の世界へと具現化される。 とても単純なようでとても新しい体験を可能としたデジタルツインプラットフォームtorinomeの、新しい価値を発見したかのような体験の日々でした。

株式会社ホロラボは、XR技術を駆使したプロジェクトやプロダクトの創出に力を入れています。当イベントには未来のエンターテインメントを牽引する才能ある子供たちが集結し、新たなXR体験を生み出す場となるよう技術支援をいたしました。 今後も株式会社ホロラボはXRテクノロジーの進化を推進していきます。

*1: torinome(トライノーム)とは

torinomeは、XR技術を用いたデジタルツインマルチプラットフォームです。

Webアプリケーションとしてブラウザで動作するtorinome Webは、Web3Dの新しいGISです。国土交通省が推進するProject PLATEAUで整備、提供される3D都市モデルを始めとして、その他にも多様な形式のGIS、画像、動画、3Dモデルを3Dの地球儀上に重畳表示が可能です。

そしてtorinome AR(iPadアプリ)は、torinome Webの地図上に設置された3Dデータを、現実世界のその場所へ実物大サイズでARによる具現化が可能です。torinome Webの地図と現実の位置が自動でリンクするデジタルツインを実現しているため、現実世界での手動での位置合わせは不要です。

*2: PLATEAU(プラトー)とは

PLATEAUは、国土交通省が推進しているプロジェクトで、日本全国の都市を3Dモデル化し、オープンデータとして公開する取り組みです。この3D都市モデルは、都市計画や防災シミュレーション、映像制作など、さまざまな分野で活用されています。これらのデータは無償で公開されており、誰でも利用することができます。

*3: こども霞が関見学デーとは

夏休み期間中に子供たちが霞が関の各府省庁を見学し、政府の仕事や社会の仕組みを学ぶイベントです。

親子で参加でき、さまざまな体験プログラムや展示が用意されています。

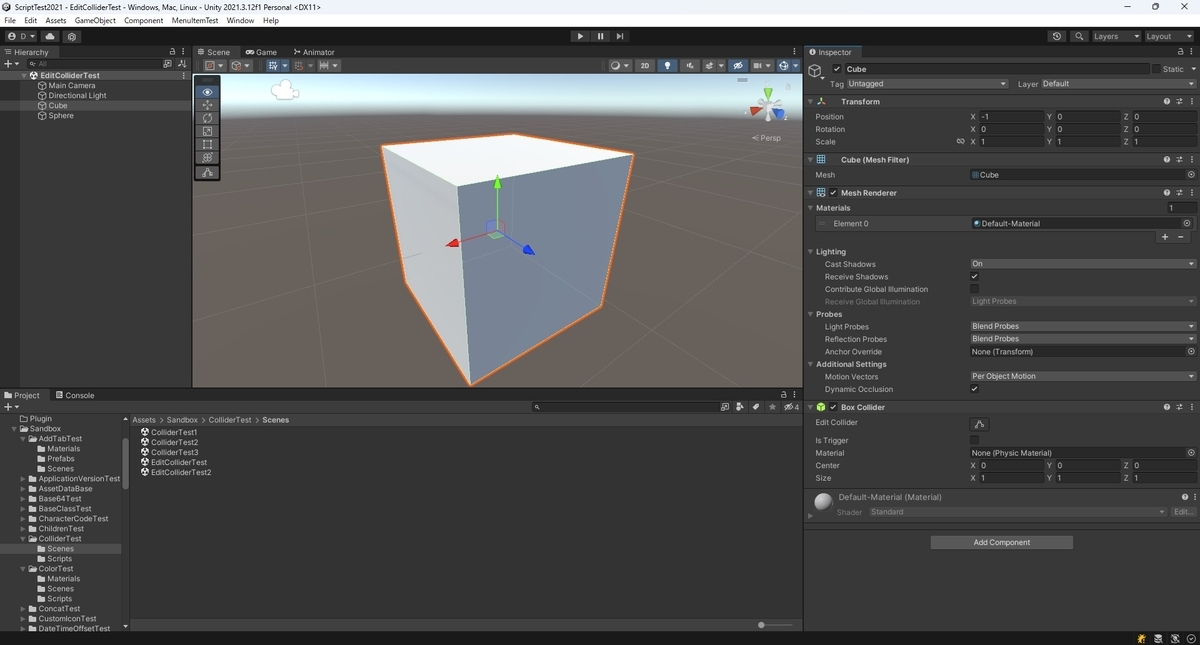

以下のColliderコンポーネントはInspector上の[Edit Collider]から当たり判定の形状を調整できます。

・BoxCollider

・CapsuleCollider

・SphereCollider

MeshColliderは[Mesh]変数のメッシュ形状を参照するため、[Edit Collider]での編集はできません。

[Edit Collider]を有効にすると、Colliderにハンドルが表示されます。

ハンドルを掴んで移動することでColliderの形状を編集できます。

ただし変形の自由度はあまり高くありません。

Sphereなどは半径が調整されるだけなどその他の編集項目で調整可能な範囲に限られます。

MRTKのビジュアルプロファイラーはアプリケーション内で表示可能なパフォーマンスの診断ツールです。

ProfileでDiagnosticsを有効にしておくとアプリケーション内で常に表示され、リアルタイムにパフォーマンスの確認を行えます。

learn.microsoft.com

スクリプトからビジュアルプロファイラーにアクセスするにはCoreServices.DiagnosticsSystemを参照します。

以下のコードでビジュアルプロファイラーの表示状態を切り替えることができます。

bool onOff = true; if (CoreServices.DiagnosticsSystem != null) CoreServices.DiagnosticsSystem.ShowProfiler = onOff;

ビジュアルプロファイラーの表示をスクリプトから切り替える以下のサンプルスクリプトを作成しました。

・DiagnosticsSwitchTest.cs

using Microsoft.MixedReality.Toolkit; using UnityEngine; public class DiagnosticsSwitchTest : MonoBehaviour { public void SwitchDiagnostic(bool onOff) { if (CoreServices.DiagnosticsSystem != null) { // ビジュアルプロファイラーの表示を切り替える CoreServices.DiagnosticsSystem.ShowProfiler = onOff; } } }

シーンにトグルボタンを追加し、トグルのON/OFFに合わせてサンプルスクリプトを呼び出すようにします。

以下の通り、シーン中にビジュアルプロファイラーの表示を切り替えることができました。

なおスクリプトから切り替える場合は新規プロファイルを作成する必要はありません。

下記のイベント・展示会への出展を予定しています。

皆様のご参加・来場をお待ちしております!

下記のイベント・展示会への出展を予定しています。

皆様のご参加・来場をお待ちしております!

※併催「CEATEC2024」の来場登録でも本イベントに入場いただけます

【展示内容】

詳細については下記よりお問い合わせください。

]]>

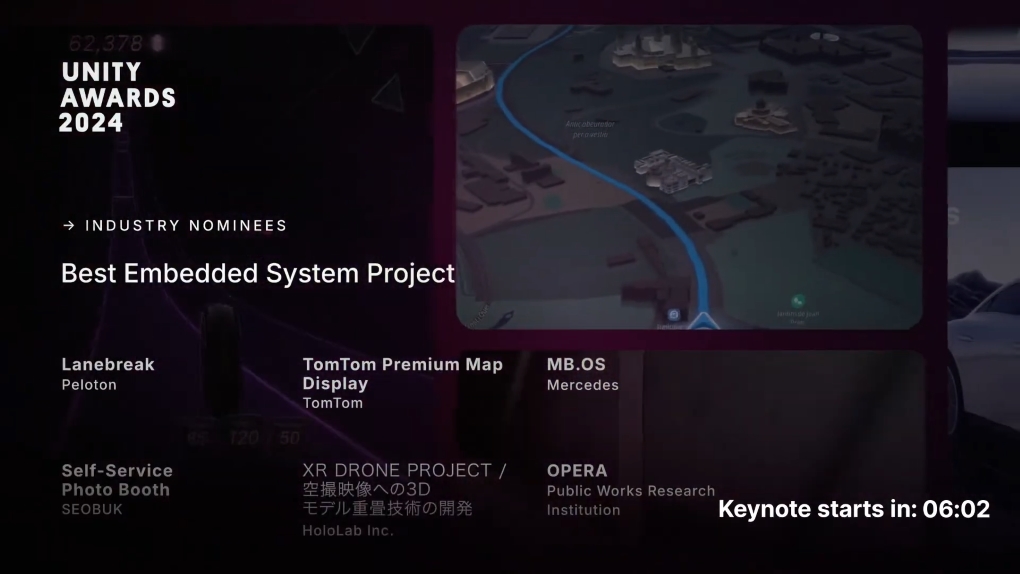

Unity Awards は、クリエイターのコミュニティが一堂に会し、創造性、影響力、卓越性をグローバルに称えるアワードです。世界中の Unity コミュニティと一緒にノミネートして、Unity クリエイターの優れた功績を称えましょう。(公式サイトより引用)

西松建設株式会社様と共同研究を行った、 GNSS連携したドローンで現場でのマーカー位置合わせを不要にし、空撮映像と3Dモデルをリアルタイムに重畳、ヘッドマウントディスプレイと連携して施工の可視化、ドローンの操縦支援を行なうプロジェクトがノミネートされました。 プロジェクトの詳細については下記プレスリリースを参考ください。 prtimes.jp

2024 年 9 月 19 日~ 10 月 4 日の一般投票期間を経て、2024 年 10 月 23 日午後 7 時(中央ヨーロッパ時間):Unity の Twitch チャンネルで各賞受賞者発表される予定です。

※Industry部門は今年度より新設された部門で、本部門には一般投票はありません。

]]>

イベントでは執筆者と編集者によるトークセッション、特別ゲストのSpatial Artistせきぐち あいみさんのパフォーマンス、サイン会など大きなトラブルもなく盛況に終えることができました。

イベント参加者にはApple Vision Proのバッテリーを入れるのにぴったりなバッテリーホルダーを参加特典として配布しました。

書籍「Apple Vision Proアプリ開発入門」購入者向けの次回のイベントは9/18(水)と9/21(土)に開発イベント「執筆者と一緒に『Apple Vision Proアプリ開発入門』をもくもくする会」を予定しています。

このイベントでは、『Apple Vision Proアプリ開発入門』を実際に手を動かしながら読み進めていくイベントでわからないことはその場で書籍執筆者に質問できるイベントです。 また、Apple Vision Proを持っていない場合でもホロラボ所有のApple Vision Proを使って開発したアプリケーションを試すこともできますので、Swift初学者の方から熟練者の方まで広くご参加いただけます。

皆様のご参加お待ちしています。

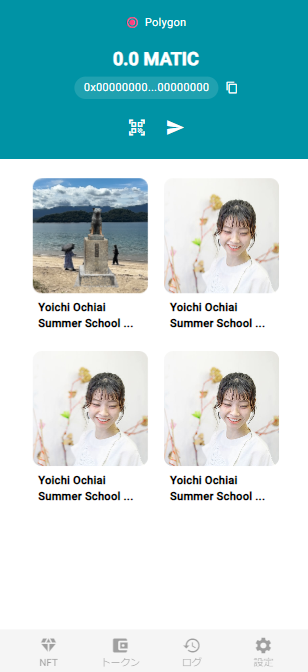

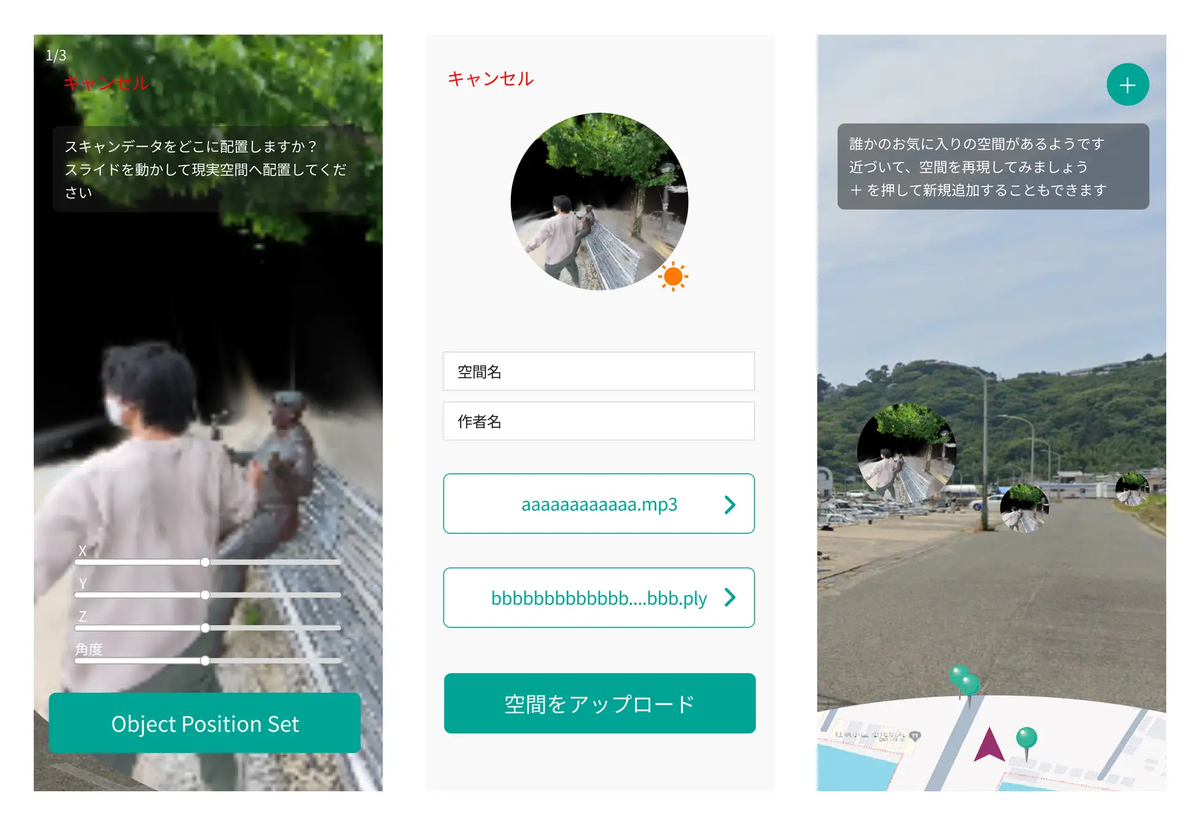

]]>サマースクール期間中に参加者が制作した作品は「Spatial Curator」を通して「体験データ」として実空間に配置することができ、それと同時にNFTとして参加者のウォレットに紐づけられます。 また同じく「Spatial Curator」を通すことで、それらの「体験データ」を他の参加者は追体験として閲覧することができます。 スマートコントラクト技術の導入により、「体験データ」が閲覧される度にその「体験データ」制作者に対して限定動画の視聴などができる権利のついたNFTが報酬として自動的に配布されます。

このアプリで採用された技術的な要素について解説していきます。

イベントの詳細についてはこちらを参照

Table Unstable https://tableunstable.org/

ホロラボ、電通グループと「地理空間連動NFT」による実証実験でARアプリを開発 https://prtimes.jp/main/html/rd/p/000000103.000023638.html

3D Gaussian Splatting(以下3DGS)によってデジタル化された3Dコンテンツを音楽データと合わせた「体験」として、Spatial Curatorを通して特定の場所に配置することができます。 配置された体験データはNFT化され、その体験データを他のユーザーがSpatial Curatorを通じて追体験する度に、制作したクリエイターに対して報酬としてのNFTがスマートコントラクト技術によって配布されます。

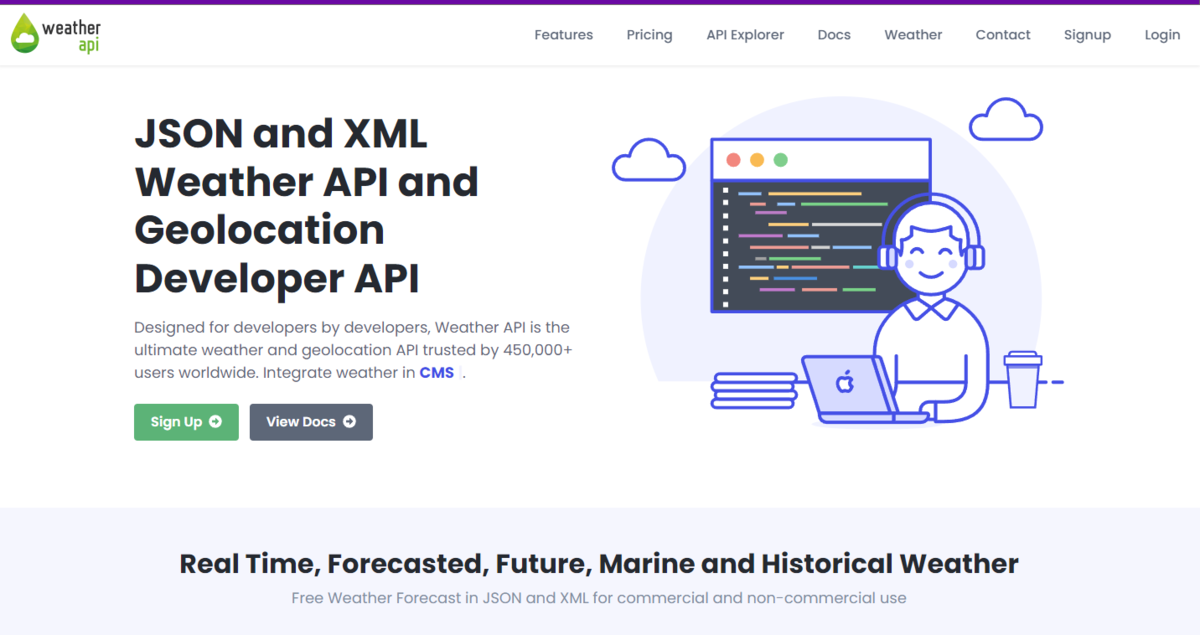

また時間帯や天気などの状況が屋外での空間体験に大きく影響を与えることを考慮し、天気APIから当時の天候を自動取得して表示することで、実際の天候と比較しながら追体験ができるようにしています。

Project Spirare はホロラボが開発を行っている OSS プロジェクトです。 Project Spirare では特定のゲームエンジンやアプリケーションに依存しない 3D コンテンツ用フォーマットである POML の仕様作成と、POML の作成や表示を行うためのライブラリやアプリケーションの作成を行っています。

Project Spirare についての詳しい情報は、2024/4/18 に実施された HoloLab Conference 2024 のセッションアーカイブをご覧ください。 www.youtube.com

今回のアプリケーションでは、Project Spirare において実装された以下の機能をライブラリとして利用しています。

3DGS の表示は高橋啓治郎さんが作成された SplatVFX をベースに実装しています。 SplatVFX では Visual Effect Graph (VFX Graph) を使って Splat の表示が行われています。

Geospatial API は Google が提供する VPS です。 アプリケーションにライブラリを組み込むことで、端末のセンサーデータ・GPS データ・カメラ画像を利用し、端末の緯度経度や向きを取得することができます。 Google ストリートビューのデータが利用されており、ユーザーによる VPS マップ作成は不要です。

詳しい情報は以下の公式ドキュメントをご覧ください。 https://developers.google.com/ar/develop/geospatial?hl=ja

Firebase は Google が提供するモバイルおよびウェブアプリ開発プラットフォームです。 今回のアプリケーションでは、画像・3DGS データ・音楽データといったデータファイルの保存に Cloud Storage for Firebase を利用しています。 また、体験データの情報(タイトル・作成者・配置位置など)の保存に Cloud Firestore を利用しています。

空気感再現のひとつとして記録している天気に関する情報は「Free Weather API」を使用して取得しています。

体験データ作成時の位置情報(緯度/経度)を元にその地点のリアルタイムの天気情報を取得し、「晴れ」や「雨」といった天候を表す天気コードを元にアイコンを表示。体験データの一部としてその天気コードを保存しておきます。

リアルタイムの天気情報を取得した例はこちら。

{

"location": { "name": "Tokyo", "region": "Tokyo", "country": "Japan", "lat": 35.69, "lon": 139.69, "tz_id": "Asia/Tokyo", "localtime_epoch": 1723704025, "localtime": "2024-08-15 15:40" }, "current": { "last_updated_epoch": 1723703400, "last_updated": "2024-08-15 15:30", "temp_c": 34.1, "temp_f": 93.4, "is_day": 1, "condition": { "text": "Partly cloudy", "icon": "//cdn.weatherapi.com/weather/64x64/day/116.png", "code": 1003 }, "wind_mph": 11.9, "wind_kph": 19.1, "wind_degree": 110, "wind_dir": "ESE", "pressure_mb": 1005.0, "pressure_in": 29.68, "precip_mm": 0.0, "precip_in": 0.0, "humidity": 60, "cloud": 75, "feelslike_c": 37.9, "feelslike_f": 100.1, "windchill_c": 34.3, "windchill_f": 93.7, "heatindex_c": 38.2, "heatindex_f": 100.8, "dewpoint_c": 20.9, "dewpoint_f": 69.5, "vis_km": 10.0, "vis_miles": 6.0, "uv": 8.0, "gust_mph": 13.6, "gust_kph": 22.0 }}

体験としてアップロードする音楽ファイルはiPhoneの「ファイル」アプリ内に格納されたmp3ファイルが対象となります。 「ファイル」アプリからのmp3ファイルの選択する機能はNative File Picker for Android & iOSを使わせてもらいました。

Native File Picker for Android & iOS | Integration | Unity Asset Store

また音楽ファイルのみで3DGSファイルをアップロードしない場合、サムネイルとして任意の画像ファイルを選択するという仕様となっています。ここで使用するサムネイル画像はNative Gallery for Android & iOSによって「写真」アプリ内から選択できるようにしています。

Native Gallery for Android & iOS | Integration | Unity Asset Store

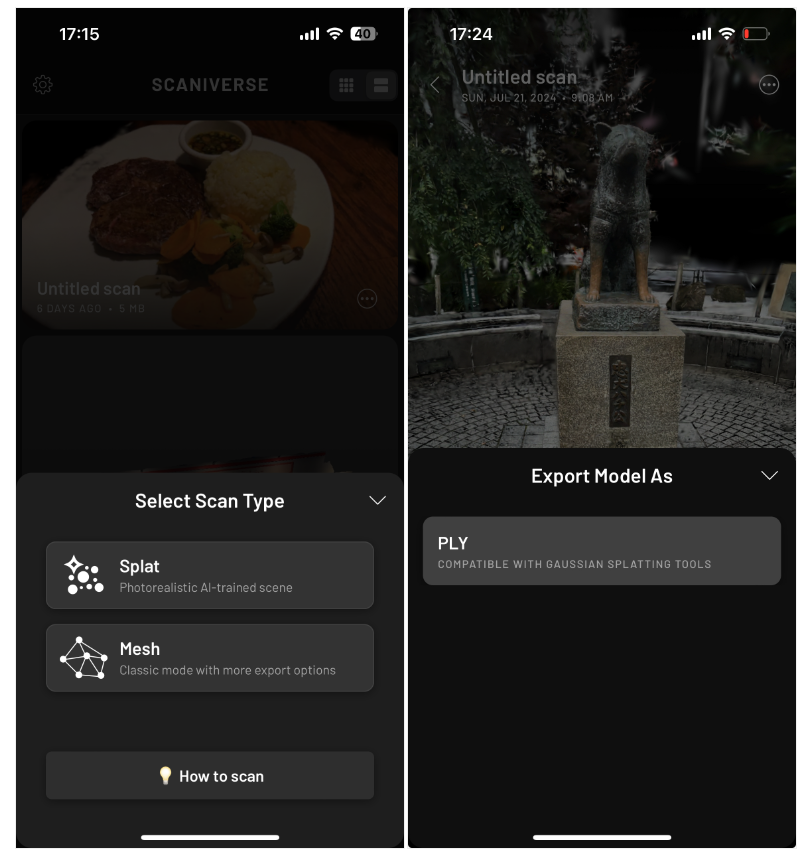

体験データに使用する3DGSのデータの作成はiPhone用スキャンアプリ「Scaniverse」を推奨として参加者に使用していただきました。

apps.apple.comほとんどの参加者が「Scaniverse」を初めて使うようでしたが、サマースクール期間中にレクチャーする機会もあり、みなさん自分ならではのスキャンをして3DGS作品を作成していました。

今回開発した「Spatial Curator」はVPS、3DGS、NFT、スマートコントラクトなど様々な技術を組み合わせたアプリとなりました。 ひとつひとつの技術の中身は複雑な仕組みではありますが、OSSや各種ライブラリを活用することで比較的容易に組み込むことができました。 サマースクール参加者にもこのアプリを通じて新しい技術に触れていただけたと思います。(文章:田野、古田)

]]>

2024年8月1日(木)~2日(金)にパシフィコ横浜で開催した Google Cloud Next Tokyo '24 のアーカイブが公開されました。 cloudonair.withgoogle.com

ホロラボからは「torinome」の開発事例について、清水、上田、丸山がブレイクアウトセッションに登壇しました。

※「torinome」は、地球上の位置に紐づいた情報を蓄積し、視覚化・共有できる Web アプリケーションとして Google Cloud を活用して開発しています。

このセッションでは、開発中に直面した課題を Google Cloud サービスを用いてどのように解決したのかを紹介しました。まちづくりや都市デジタルツインに興味のある方も、ぜひご覧ください。

また、「Google Cloud Next Tokyo」は、Google Cloudの最新情報やベストプラクティスが知れるため、とても楽しいイベントでした。次回の「Google Cloud Next Tokyo」は 2025年8月5日(火)~6日(火) に 東京ビッグサイト 南展示棟 で開催予定ですので、みなさんも是非機会があれば足を運んでみてください。(文章:上田)

]]> Unity Asset Storeにホロラボのストアを開設しました。

今後弊社で制作した3Dモデルなどの素材を公開予定です。

Unity Asset Storeにホロラボのストアを開設しました。

今後弊社で制作した3Dモデルなどの素材を公開予定です。

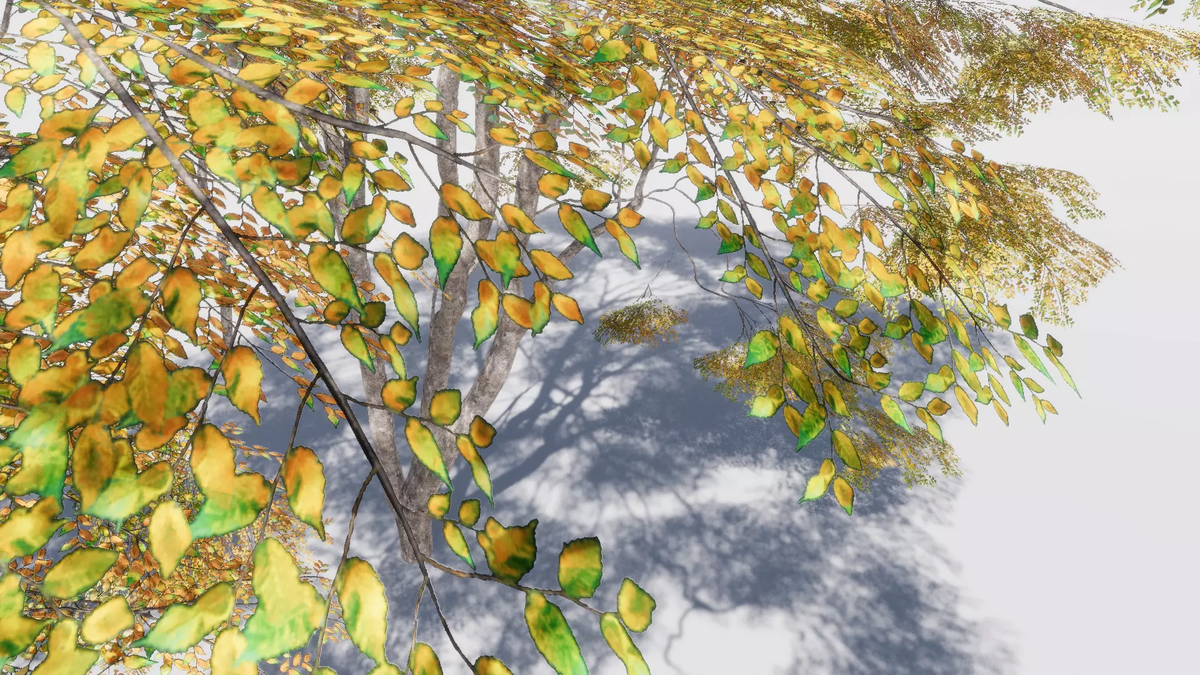

日本の樹木、カエデのモデルです。

高精度の地上型3Dレーザスキャナによって計測されたデータ(点群データ:PointCloud)を基に作成された、登録有形⽂化財「沖本家住宅」(東京都国分寺市)に自生するカエデの3D樹木モデルとなります。緑葉・紅葉の3D樹木モデルを提供いたします。

本手法によって作成される3D樹木モデルは実測に基づいており、かつ、樹木の点群データから3Dモデル化を行うためのアルゴリズムの使用により、実物に近い樹形の再現性を可能としております。

本モデルの収益の一部は沖本家住宅に還元いたします。

日本の樹木、ケヤキの3Dモデルです。

高精度の地上設置型レーザースキャナによる実測に基づいています。

レーザースキャンデータからの3Dモデル化に独自のアルゴリズムを使用する事で、非常に詳細な幹と枝の形状が再現されています。

葉のテクスチャは実物を撮影したものをベースとしており、表面用と裏面用とそれぞれ専用のテクスチャを有しています。

形状とテクスチャ共に写実的な樹形表現を可能としております。

ぜひお試しください!

]]>普段はガチめの広域フォトグラメトリ&3D Gaussian Splattingやってる人ですが、旅先で広い範囲を撮影する場合は時間も限られているので360度カメラで撮影した動画や写真を使っちゃう場合もあります。

(観光がてらの撮影なのに作業着と反射ベストも持っていった人。安全第一)

(観光がてらの撮影なのに作業着と反射ベストも持っていった人。安全第一)

一眼カメラの撮影やレーザースキャンでのスキャンに比べて圧倒的に効率的!

その分品質は劣りますが。

この記事ではそうして撮影した360度素材を元にSfMする(からのフォトグラメトリや3Dガウシアンスプラッティングする)手段と手順についてまとめてみました。

前半でいくつかの手法を紹介、後半で具体的な手順を紹介します。

| 価格 | インターフェース | |||

| 無料利用可能 | 有料のみ | コマンドラインのみ | GUI | |

| Metashape | ◯ | ◯ | ||

| 3DF Zephyr | ◯ | ◯ | ||

| FFmpeg | ◯ | ◯ | ||

| Meshroom | ◯ | ◯ | ||

| 360-to-planer-images | ◯ | ◯ | ||

| Unity Recorder | ◯ | ◯ | ||

| DaVinci Resolve | ◯ | ◯ | ||

| Premiere Pro | ◯ | ◯ | ||

| PTGui | ◯ | ◯ | ||

対応しているソフトを使っちゃうのが最も簡単。

Metashape

Metashape全天周画像(エクイレクタングラー)に対応しているのでそのまま処理できます。

特徴点が少ない上に超狭小空間といったケース(エレベーター内とかトイレ内とか)だと普通のカメラで撮影した画像からフォトグラメトリするのは困難な場合も多いで、360°撮影+Metashape処理という組み合わせは業務でも予備として採用しているワークフローです。

公式の解説ページはこちら。

3DF Zehpyr

3DF Zehpyrこちらも全天周画像(エクイレクタングラー)を読み込むことができますが、Metashapeとは異なりそのまま処理するのではなく展開した画像が切り出されその画像が使われます。

切り出す際は方向(上下左右前後)と画角が指定できます。

参考記事: 3DF Zephyrで360度ビデオを直接取り込んでフォトグラメトリを行う

画像として切り出されるのでその画像を他のソフトで利用することも可能です。

全天周画像の状態から各方向に歪みを補正した状態の画像に切り出す方法です。

切り出した後はお好みのフォトグラメトリ/3D Gaussian Splatting/NeRFのソフト等で利用できます。

数が多いので前半では各種手法と参考記事を紹介。

言わばリンク集。

みなさまの記事に感謝!

「CUI」とつけたものはコマンドラインツールです。

コマンドラインツールの利用が難しい場合は「GUI」の方を利用してみてください。

後半では参考記事の内容を参考にしつつ一部をより具体的に手順編としてまとめました。

FFmpeg (CUI)

FFmpeg (CUI)参考記事: 360°動画からフォトグラメトリで現場を3Dモデル化する話

詳しい手順は後述します。

Meshroom の aliceVision_utils_split360Images (CUI)

Meshroom の aliceVision_utils_split360Images (CUI)参考動画: 360 Photogrammetry [Reality Capture]

詳しい手順は後述します。

360-to-planer-images (CUI)

360-to-planer-images (CUI) Unity Recorder (GUI)

Unity Recorder (GUI)参考記事: パーソナルユース版・Insta360OneXの動画を使ったフォトグラメトリ

DaVinci Resolve (GUI)

DaVinci Resolve (GUI)参考記事: DaVinci Resolveで360度映像を16:9にリフレームする

参考記事: DaVinci Resolveでの360度動画の手ブレ補正とリフレームをする方法

Premiere Pro + GoPro FX (GUI 有料ソフト)

Premiere Pro + GoPro FX (GUI 有料ソフト)参考動画: 360カメラ映像からフォトグラメトリで3Dモデルを生成してVRChatまで持っていく配信

詳しい手順は後述します。

PTGuiを使う (GUI 有料ソフト)

PTGuiを使う (GUI 有料ソフト)参考記事: Insta360OneXの動画を使ったフォトグラメトリ

上記で紹介した手法のうちいくつか具体的な使い方を以下にまとめました。

ちなみ私は使い勝手の良さから普段はFFmpegを利用しています。

FFmpeg を使う場合

FFmpeg を使う場合FFmpegのv360を使うと切り出す方向や画角等を細かく指定できるので、どのように切り出すとフォトグラメトリ(SfM)がうまくいくのかトライアンドエラーするのにも便利です。

v360のドキュメントはこちら。

使い方は以下のとおりです。

参考記事: FFMPEGをWindowsパソコンにインストールしよう

私はAnacondaを使用しているので以下のように環境を作成しました。

v360という名前の仮想環境を作成。名前はわかりやすければ何でも良いです。

conda create -n v360 python=3.10作成した仮想環境をアクティブにする。

conda activate v360参考記事: PythonとFFmpegで長時間の動画を短く分割しよう

condaの場合はインストールコマンドはこちら。

https://anaconda.org/conda-forge/ffmpeg-python

conda install -c conda-forge ffmpeg-pythonこちらのサイトを参考にさせていただきつつ(感謝!)、私の用途にも使いやすいよう少し内容を変更しました。

パスやファイル名に具体的な名前が入っていますが適宜変更してください。

import subprocess

import os

# 動画を保存しているフォルダ 作業フォルダ

path = r'I:\Scans\20240609_OsakaCastle\_Export' + '\\'

# ファイル名 (拡張子は含まず)

filiname ='VID_20240609_173041_00_001'

# 拡張子名

extension ='mp4'

# 出力フォルダ (なければ作る)

output_path = fr'{path}Export' + '\\'

os.makedirs(output_path, exist_ok=True)

input_file_path = f'{path}{filiname}.{extension}'

# 視点リスト(yaw,pitch,roll)

#'''

# 8方向

transforms = (

( 0, 0,0),

( 45, 0,0),

( 90, 0,0),

( 135, 0,0),

( 180, 0,0),

(-135, 0,0),

( -90, 0,0),

( -45, 0,0),

)

#'''

'''

# 8方向+見上げ4方向

transforms = (

( 0, 0,0),

( 0, 20,0),

( 45, 0,0),

( 90, 0,0),

( 90, 20,0),

( 135, 0,0),

( 180, 0,0),

( 180, 20,0),

(-135, 0,0),

( -90, 0,0),

( -90, 20,0),

( -45, 0,0),

)

'''

'''

# 12方向

transforms = (

( 0, 0,0),

( 30, 0,0),

( 60, 0,0),

( 90, 0,0),

( 120, 0,0),

( 150, 0,0),

( 180, 0,0),

(-150, 0,0),

(-120, 0,0),

( -90, 0,0),

( -60, 0,0),

( -30, 0,0),

)

'''

# 画像切り出しのフレームレート 撮影時の移動スピードや対象物からの距離をみて調節

fps = 2

# 明るさ調整 (ただしコントラストが落ち階調も失われるので次のガンマ調整を使った方が良さそう)

brightness = 0

# ガンマ調整

gamma = 1.0

# 各視点で書き出す

for index, transform in enumerate(transforms):

# 出力ファイル名をつくる

# %04dで4桁連番

#output_file_path=fr'{output_path}Output_{index}_%04d.jpg'

output_file_path=fr'{output_path}{filiname}_%04d_{index}.jpg'

# v360ライブラリのオプション

v360_options = ':'.join([

'input=e', # Equirectangular projection.

'output=rectilinear', # Regular video.

'h_fov=90',

'v_fov=90',

'w=1472',

'h=1472',

# 'interp=gauss',

f'yaw={transform[0]}',

f'pitch={transform[1]}',

f'roll={transform[2]}'

])

# コマンドをつくる

# 順再生

command = f'ffmpeg -i "{input_file_path}" -vf "v360={v360_options}, eq=gamma={gamma}" -qmin 1 -q 1 -r {fps} "{output_file_path}"'

# 逆再生

# command = f'ffmpeg -i "{input_file_path}" -vf "v360={v360_options}, eq=gamma={gamma}, reverse" -qmin 1 -q 1 -r {fps} "{output_file_path}"'

# ffmpegを実行

subprocess.call(command, shell=True)

ファイル名は「v360.py」等わかり易い名前で保存します。.pyというのはPythonファイルの事。

切り出す視点の方向は「#視点リスト(yaw,pitch,roll)」のところで指定しています。

切り出し方によってSfMの結果がどう変わるか検証したかったので、コード内に切り出し方を事前にいくつか用意しておいて適宜コメントアウト部分を変更して検証しました。

通常は動画が再生されている順番そのまま切り出すので問題ないかと思いますが、同じ道を往復して撮影していた場合、復路は逆順で切り出したかったのでコードの最後の部分で「#逆再生にして切り出す場合」も作りました。

その他オリジナルのコードから変更した部分で、ガンマ調整を入れたり、書き出す画像の品質を最高品質になるようにしています。

Pythonファイルが出来たら、Anaconda Promptにてそのファイルを保存した場所に移動します。

私の環境の場合はこんな感じ。

cd D:\OneDrive\Garage\FFmpeg\Python_v360

移動したら以下のコマンドでPythonスクリプトを実行します。

python v360.py

以上!

(書き出した画像をお好みのフォトグラメトリ/3DGS/NeRF等のソフトに放り込んで処理しよう)

Meshroom の aliceVision_utils_split360Images を使う場合

Meshroom の aliceVision_utils_split360Images を使う場合Meshroomはフォトグラメトリのソフトですが、全天周画像を展開できるユーティリティツールも配布されています。

まず Meshroomのサイト からMeshroomのソフト本体をダウンロードします。

ダウンロードしたzipを展開すると Meshroom > aliceVision > bin 内に aliceVision_utils_split360Images.exe があるのでこれを利用します。

使えるオプションは以下の通りです。

This program is used to extract multiple images from equirectangular or dualfisheye images or image folder AliceVision split360Images: Required parameters: -i [ --input ] arg Input image file or image folder. -o [ --output ] arg Output keyframes folder for .jpg Optional parameters: -m [ --splitMode ] arg (=equirectangular) Split mode (exif, equirectangular, dualfisheye) --dualFisheyeSplitPreset arg (=center) Dual-Fisheye split type preset (center, top, bottom) --equirectangularNbSplits arg (=2) Equirectangular number of splits --equirectangularSplitResolution arg (=1200) Equirectangular split resolution --equirectangularDemoMode arg (=0) Export a SVG file that simulate the split Log parameters: -v [ --verboseLevel ] arg (=info) verbosity level (fatal, error, warning, info, debug, trace).

具体的には以下のようなコマンドで実行できます。

aliceVision_utils_split360Images.exe -i <全天周画像を入れたフォルダのパス> --equirectangularNbSplits <切り出し枚数> -o <処理後の画像を保存するフォルダのパス>

equirectangularNbSplitsに8を指定すると水平方向で8分割で画像が書き出されます。

以上!

(書き出した画像をお好みのフォトグラメトリ/3DGS/NeRF等のソフトに放り込んで処理する)

前述のFFmpegほど細かい設定はできないようですが、使うまでの工程はこちらの方が簡単。

Premiere ProとGoPro FXを使う場合

Premiere ProとGoPro FXを使う場合上記まではコマンドラインですが、GUIで作業したい方はこちらをどうぞ。

Premiere ProをインストールしたらPremiere用のプラグインもそれぞれインストールします。

・GoPro FX Reframe

https://community.gopro.com/s/article/GoPro-FX-Reframe

・Insta360 STUDIO

https://www.insta360.com/jp/download/hot-download

Insta360 Studioのインストール時にPremiere Pro用のプラグインもインストールできます。

360度静止画撮影していた場合は読み込ませるファイル名を連番にしておきます。

連番にしておくことで一つの動画としてPremierに読み込むことができるようになります。

画像シーケンスにチェックを入れて読み込むと連番静止画を動画として読み込める。

GoPro ReFrameのProjectionを「4K (4096×2160)」に設定する。

GoPro ReFrameのProjectionで選んだものと同じ解像度に設定する。

GoPro Reframeの「Lens Curve」を調整し歪みを補正する。

この例では65にした。

画面を見ながら歪みのなくなる数値に調整する。

「Zoom」の値はデフォルトの100で問題ないと思われるが、SfM処理時にオーバーラップ不足が心配な場合は少し広角にする。

オーバーラップが足りるかどうかは画像を何方向に書き出すかにもよる。

8方向であれば画角90度相当でも問題ないが、4方向のみに書き出す場合はもう少し広角にしてオーバーラップを確保すると安心。

ただし広角にしすぎると画面脇の解像が下がるので注意。↓広角にしすぎた例

・形式: JPEG

・画質: 100

・フレームレート: 静止画連番を読み込ませていた場合はプロジェクトのフレームレートのままにする(静止画のフレームが全て書き出されるようにする)。動画を読み込ませていた場合は撮影時の移動速度や対象までの距離よって調整する。通常は1または2程度。

OKを押して書き出す。

これで1方向分の書き出しが完了。

続いて残りの方向についても書き出すためGoPro Reframeの設定を変更する。

4方向に書き出したい場合は 0° の他、90° / 180° / 270° に設定したものでそれぞれ書き出す。

上方向の画角が足りない場合はTiltの値を調整したものも加える。

以上!

(書き出した画像をお好みのフォトグラメトリ/3DGS/NeRF等のソフトに放り込んで処理する)

8方向に書き出す場合はPan等の設定を変えて8回書き出さないとならないのが難点。

(そこも一括処理するうまくやり方あるかもしれない?)

最後に作例も紹介。

Insta360 ONE R 1-inchで撮影した360°動画から京都 清水寺の参道をフォトグラメトリ!

メタバースプラットフォーム、VRChatやclusterでワールドを公開しました。

「京都VR」の起動リンクやメイキングについてはこちら。

どのように360°カメラで撮影したのか もメイキングで触れています。

京都をVR化してみた!

スマホでも体験いただけます。清水寺への参道を丸ごと再現。

実際の現地の町並みや和菓子をフォトグラメトリによりデジタルアーカイブ。バーチャル食べ歩き観光できちゃいます〜

VRの起動は続きから。 pic.twitter.com/TmvwTMn6bZ— 龍 lilea (@lileaLab) September 28, 2023

同じデータから大規模、広域なガウシアンスプラッティングも作ってみました。

]]>やりたかったやつ、ついに出来た。

広域3D Gaussian Splatting!

京都清水寺の参道600mを約2万枚の画像から3D復元。

せっかくだから体験可能な形でも用意したいな。#GaussianSplatting pic.twitter.com/WTlMgX9bm1— 龍 lilea (@lileaLab) May 7, 2024

広域な3D Gaussian Splatting × フォトグラメトリ。

それぞれの得意分野を活かしミックスした3D空間を構築。

以下簡単なメイキングです。

出張で浜松へ行ったついでの撮影だったので、機材は最低限。

炎天下しんどかったので10分ごとに休憩を挟みつつ、そして人が来た時も待機しつつで、1時間半ほどで撮影。

撮影枚数は1367枚。

フォトグラメトリ足運びはこんな感じ。

いつも通りループクローズを意識。

カメラの高さは普通に手で構える位置。

アライメント精度を高めたい場合はロッドを使って頭上から微俯瞰で撮影したりもするが、今回は機材も持っていってなかったのと猛暑でそんな気力もなかったので普通に手持ちの高さで撮影。

メッシュ化やテクスチャ生成はいつもどおりの流れ。

フォトグラメトリのメッシュと3DGSのSplatを統合したかったのと、規模が大きくなると3DGSのCOLMAP等では写真位置推定がうまくいかない場合が多いので、RealityCaptureでアライメントした結果を書き出し3DGS処理を行った。

これによってフォトグラメトリと3DGSのそれぞれのデータも同じ座標になるので綺麗に統合出来る。

ワークフローは以下の通り。

現状ではPostshotでは広域、規模の大きなシーンの処理を行うと細部の再現精度が大きく落ちてしまうため。

細部の再現精度を上げるにはSplatの密度も上げる必要があるか現時点ではここのコントロールがうまく行えず、公式3DGSの方で各種パラメーターを最適化して生成した方が良好な結果をなったため。

以下その比較。

・Postshot (ADC)

・Postshot (MCMC)

・公式3DGS

まずそれぞれのデータの状態を確認。

フォトグラメトリは動く物体や形状の細かな物体の生成は得意ではなく、かつ地上からのみ撮影を行っていた場合はこのように樹木周りに品質の低いバリ状のメッシュが生成されてしまう。

こちらは植栽の表現がとても綺麗。

しかし一方で地面の砂利は十分な解像度が得られておらず、3DGS特有の複数の楕円体の重なりで構成されている様子がわかる状態になってしまっている。

※Splatの密度を上げることで再現可能ではあるがデータ容量や処理コスト的にあまり現実的ではない

そのまま合体させるとフォトグラメトリのメッシュに3DGSの暗めのモヤが乗った状態となり、あまり見栄えの良いものにならない。

なので「フォトグラメトリで使いたい部分のみのデータ」と「3DGSで使いたい部分のみのデータ」をそれぞれ用意する。

地面と銅像のみのメッシュにした。

地面と銅像部分のSplatを削除した。

今回はレンダリングにはUnityGaussianSplattingを使用したのでこの機能で不要な部分のSplatを非表示に編集した。

フォトグラメトリと3DGSのそれぞれの利点を活かした、いいとこ取りのデータに出来た。

看板の文字はフォトグラメトリや3DGSで表現するのはデータが重くなってします、現地で別撮りしておいた写真を板ポリにはりつけて表現した。

3DGSだと細部の再現精度が低い状態。

ここにフォトグラメトリのモデルを配置すると、

メッシュとSplatが重なって汚い状態になってしまう。

なのでこの部分のSplatを削除する。

(前項目で解説したのと同様の手順)

そしてこの部分にフォトグラメトリのメッシュモデルを配置。

しかしこれでもまだぼやけていて文字を読むには解像度が足りないので、別撮りしておいた写真を板ポリに貼り付けたものを配置。

これで寄りでも見れるものにできた。

今回はThirdPersonのアセットを入れて歩けるようにしたり、

UnityRecorderで4k動画60fpsレンダリングを行った。

キャラクターが歩き回るためにはコライダーが必要だが、これはフォトグラメトリのメッシュを大幅にリダクションしたものを使用。

以上!

フォトグラメトリも3D Gaussian SplattingもまずはRealityCaptureで写真位置推定するワークフローは共通なので、今後はこのいいとこ取りハイブリッド版を活用したコンテンツも色々作ってみたいな。

]]>浜松城を3Dデジタルアーカイブ!

広域3D Gaussian Splatting × フォトグラメトリ

植栽や空は #GaussianSplatting

地面や銅像、看板等は #Photogrammetryそれぞれの得意分野をミックスした3D空間構築。

作り方はつづきに。 pic.twitter.com/ygSXlQYvLP— 龍 lilea (@lileaLab) August 7, 2024

デジタルツインプラットフォームサービスである「torinome」の開発事例について、清水、上田、丸山がご紹介します。 ぜひ現地でご聴講ください。

【セッション概要】

※事前登録が必要ですので、 登録ページ からお申し込みください。

【Google Cloud Next Tokyo ’24 開催概要】

【イベント概要】

次世代のテクノロジーが集結する、年に一度のビッグイベント Google Cloud Next Tokyo '24 が、日本時間 8 月 1 日(木)〜 2 日(金)の 2 日間にわたり、パシフィコ横浜 ノースにて開催されます。

生成 AI が切り拓く未来、データ分析が導く新たな価値、モダンなアプリケーション開発が生み出す革新的なユーザー体験。さらには、強固なインフラとセキュリティ、多様な働き方を支える生産性向上とコラボレーション。あらゆる業界の発展を加速させる最新のイノベーションが、ここに集結します。 著名なスピーカーによる基調講演、専門分野に特化したブレイクアウトセッション、実際のソリューションを体感できるライブデモ。多岐にわたる充実のプログラムが、あなたのビジネスに新たな視点と発想をもたらします。

Next Tokyo '24 は、刻々と変化するテクノロジーの潮流を掴み、ビジネスの可能性を広げる。そのための最高の機会です。 ぜひ、この特別な 2 日を体験しに来てください。 新たなる未来への扉が、ここから開かれます。

詳細についてはお問い合わせください。 https://hololab.co.jp/#contact

]]>

下記のイベント・展示会への出展を予定しています。 皆様のご参加・来場をお待ちしております!

【展示内容】

京都VR 清水寺参道- 広域3D Gaussian Splattingバージョン

各イベント・展示会の詳細についてはお問い合わせください。

]]>デバイスは Apple Vision Pro に Meta Quest 、 データ関連では PLATEAU 、 デジタルアーカイブ 、OpenAI 。 個別技術として 空間ビデオ や Babylon.js 、 Immersal まで、 事例や技術を豊富にとりそろえています。

ぜひご覧ください!

Hololab Conference 2024 - YouTube

セッション動画やスライドの内容については下記よりお問い合わせください。 https://hololab.co.jp/#contact

ホロラボのこれまでの1年をふりかえり、現在、そしてこの先の方向についてお伝えします。

これまでの手掛けてきた設計内容と Apple Vision Pro の登場による建築設計の可能性について探る

山梨様の講演中にありましたWhitemodel(仮)は、下記メディアより記事が出ていますので、合わせてご覧ください。

施工段階において,CIMの3Dモデルを活用した取組みが活発化している.しかし,現行のAR技術では,3Dモデルの表示が視点位置,移動範囲に制限がある,移動に時間を要してしまうなどの問題がある.これらを解決するため,ドローンによる空撮映像への3Dモデル重畳技術の開発を行った.モデルのAR重畳方式には,ARマーカー,QRコード等を必要としないマーカーレス方式を採用し,ドローンの内部情報(GNSSの位置情報,加速度,角度等)とモデルの位置座標とを適応させることで,自由視点による3Dモデル表示を可能とした。これにより、3Dモデルを現場全景と比較することや移動時間の削減を実現した.

国土交通省が推進する都市デジタルツイン実現プロジェクト PLATEAU のユースケース開発事業として、ホロラボ、日建設計、日建設計総研のJVで実施した「XR技術を活用した市民参加型まちづくり」のプロジェクトをご紹介いたします。

C3-BIMは、建築プロジェクトの設計情報(BIMデータ)をベースに、どこに置いてあるかわからない文書や資料の情報を集約しAIによる解析を行い、知りたい情報を横断的に検索することができるプロダクトです。

ホロラボカンファレンス2023では「BIMから3次元モデルを消してみたら、意外に便利でした」というタイトルで、R2-BIMというプロダクトをご紹介させていただきました。C3-BIMはこのR2-BIMを進化させたプロダクトです。

本セッションでは、C3-BIMの取り組みやその背景についてご紹介します。 セッションをきっかけに、BIMを活用したデジタルトランスフォーメーションに挑まれている方と意見交換させてください。

Apple Vision Pro の全体観と可能性について、Apple Vision Proのハードウェアの概要、Apple のハードウェアエコシステム内での立ち位置をお話しします。

これらを踏まえて、Apple Vision Pro の新しい可能性についてお伝えします。

Meta Quest 3やApple Vision Proの登場でより実用的な技術となったビデオパススルーのデジタルミュージアムとしての活用方法を実現に向けた工夫ポイントや具体的な事例を交えながらご紹介いたします。

本セッションは、建設業の課題である技術継承をサポートするために、文書業務に着目し、経験者のスキルをプロンプトとして実行するChatGPTによって実現できるという仮説をもとに、アプリケーションのデモを通じてその紹介と可能性についてお話します。

昨年OpenAIがChatGPTやGPT-4を発表してから、大規模言語モデルを始めとする生成AIに対して日々の業務における活用の期待が高まっています。日常の業務の多くの場面で自然言語が使われています。建設業においても同様で、たとえば要求水準書を読むことで求められる建物の要求を抽出したり、建築基準法を読み込み満たさなければならない法的基準を把握するなどといった、言語を用いた業務が存在します。

一方で、2024年問題が到来し、いかにしてこれまで熟練の技術者たちがやってきたことを継承していくかが喫緊の課題となっています。継承すべき技術の中には、手作業など身体に基づく技術もありますが、業務上の文書を処理する技術といったものも存在します。ですので、建築業界においても実用化の期待が高まっており、いくつか事例が出始めています。その多くはOpenAIが提供するChatGPTと同様のチャット型のインタフェースを提供しています。ですが、チャットの投稿画面に何を質問すれば良いのかわからず、質問する機会を目の前にしながらも質問を考えるスキルの有無で技術の差が発生しています。

そこで我々は、経験者のスキルをあらかじめ言語化し、それを共有して利用可能にすることで、文書を用いる業務をChatGPTによって誰でも経験者のような成果を得られるのではないかと考えています。

このセッションでは、ホロラボが開発したデジタルツイン基盤システムである「torinome」に焦点を当てます。「torinome」は、Project PLATEAUによって整備され提供される3D都市モデルを含む、様々なGISデータ、画像、動画、3Dモデルを位置情報と関連付けて、地理空間情報を視覚化することを可能にします。このセッションでは、「torinome」が可能にすること、その仕組み、どのように活用されているか、そして将来の展望について詳しく紹介します。

国登録有形文化財「沖本家住宅」のフォトグラメトリによる3Dデータ化から見るデジタル文化財アーカイブの舞台裏に待っています。

近年、建設業界では3DCAD(BIM/CIM)とゲームエンジン等によるレンダリング技術の浸透により、3Dによる設計や完成予想の提供が当たり前になると同時に、計画案に樹木の配植(はいしょく)までを取り入れる、3D樹木モデルの利用と必要性が高まっていくと考えられる。しかしながら、現行の3D樹木モデル(樹木アセット)には、日本固有の樹種が少ないことや、樹形(樹種に応じた樹木の形)の信憑性等、多くの問題が存在する。これら問題に対し、ホロラボでは、地上型3Dレーザスキャナによる、実測に則った日本固有および風土に適したの3D樹木モデルの構築プロセスを提案する共に、建設業界から3DCGデザイン(特にゲーム業界)に向けた需要と展望について考える。

富山県滑川市にある、ほたるいかミュージアムでは、長年の課題であった実物のホタルイカが展示できない期間を、VR技術を用いて解決しました。VR導入により、訪問者はホタルイカに"変身"して生態を体験できるようになり、この新しい展示方法は、県外からの訪問者を引き寄せ、賞を受賞するなど、ミュージアムに新たな魅力をもたらしました。 この展示で、UnrealEngineのどの技術を利用したか。歩行デバイスによるVR酔い軽減、ハンドトラッキングによる直感的操作、展示のコツなどを紹介します。 また、自身の開発に対する思い、それがUnmageというHololabのUnreal Engine チームでどう活かせているか。チームの取り組みもお伝えします。

Apple Vision Proで3次元で動画再生ができる空間ビデオ(Apple HEVC Stereo Video)の特徴や作成方法について、ホロラボで調査・開発した内容を紹介します

Web 3DエンジンであるBabylon.jsの新バージョンであるBabylon.js 7が3月末にリリースされたので、このタイミングでBabylon.jsの概要と魅力、そして最新バージョンの注目機能についてご紹介します。

昨年のLTでも行ったようなVPSサービスの更新情報紹介や、最近じわじわと広がりつつあるARフィルターのご紹介、そして時間が許せば、ホロカンお菓子大作戦の紹介と技術解説ができればと思っています。

ホロラボがオープンソースとして開発を進めている「Project Spirare」を使ったノーコード AR コンテンツ開発の手法を紹介します。 「Project Spirare」では「Spirare Editor」という AR コンテンツ編集アプリと「Spirare Browser」という AR コンテンツ表示アプリを組み合わせることにより、誰でも簡単に AR コンテンツを作成し各種デバイスで表示することができます。 本セッションではコンテンツ作成から表示までの一連の流れと技術的な詳細について、デモを交えてご紹介します。

3/4(月)に新しいオフィスへ移転したホロラボですが、移転するまでにあったホロラボならではのストーリーを解説。 物件を決めた理由からレイアウト作成、BIM、AR、3D都市モデルなどデータをどう使うかたかなど含めて時系列で紹介します!

こちらのURLで無料で頒布していますので、

よろしければご一読ください。

目次

プレゼン中に余分なウィンドウを開かないように監視するアプリを作ってみた

WindowsのAPIを使ってデスクトップ上のウィンドウを監視してインシデント防止!?

はじめての VR ゲーム開発

Meta QuestでのVRゲーム開発のわかりやすいチュートリアル 最新のQuest SDKの使い方も解説します

Unity でも使える! C#の Switch 式

最近のUnityでも使えるC#の新し目な機能を説明します

Unity でのネットワーク通信を手軽に実現する:Mirror の活用

UnityでMirrorを使ってマルチプレイを実現する方法を解説します

点群の Draco 圧縮

Googleの圧縮アルゴリズム「Draco」が点群を超圧縮する仕組みを解説

よろしくお願いします。

]]>【展示内容】

各イベント・展示会の詳細についてはお問い合わせください。

]]>公式サイトはこちら。

コマンドラインで実行する公式の3D Gaussian Splattingの環境構築方法もこちらで解説していますが、CUIは慣れていないとなかなか使いこなすのも大変。この点postshotはマウス操作で直感的に利用できます。

直感的に使えるので使用方法は詳しい説明がいらないレベルではありますが、応用的な使い方を含めて以下にまとめてみました。

後半ではRealityCaptureの併用方法(アライメント結果を読み込む)についても紹介しています。

公式サイトからDLしてインストールする。

起動すると以下のような画面になるので、表示されている通り画像をドロップ&ドロップする。

読み込むとダイアログが表示されます。

デフォルトだと「Image Selection」が「Best Images」になっていますが、使用する写真が限定されるので、すべての写真を利用したい場合は「Use All Images」を選んでおきます。

「Start Trainning」は「Import」ボタンを押すとすぐ処理が開始される設定です。写真を読み込んでから設定をつめて、それからトレーニングを実行したい場合はこのチェックは外しておきます。

右下の「Import」を押すと写真が読み込まれます。

読み込まれたら、左上の「Start Trainning」を押すと処理が開始されます。

しばらく待つとリアルタイムに処理中の様子がビューポート上に表示されます。

以上、最低限の使い方でした。

(その他便利な使い方等は今後追記予定)

各種パラメーターの詳細ついては公式マニュアルに記載があります。

2024/10/12のアップデートでUnreal Engineに対応したようです!

3D Gaussian SplattingをUnreal Engineで利用する手段がまた1つ増えた。

使い方は簡単だった。

以上。

大規模なシーンや複雑なシーンを処理する場合、postshotではうまくアライメント(写真位置推定)ができない場合があります。

(現在postshotにはコントロールポイントを使用したり、レーザースキャンデータを併用する機能はありません)

しかしこうした複雑なシーンを事前にRealityCaptureでアライメントを行っておくことでこのデータをpostshotに読み込ませて利用することができます。

この方法がまだ公式マニュアルには記載がないので手順をまとめました。

※追記 本日(2024/8/22)公式マニュアルにも記載されました。該当ページはこちら

RealityCaptureの使い方については「フォトグラメトリ手順書」にまとめているので参考にしてみてください。

Alignment > Export > Registration > Internal/Extenal camera paramerters から書き出す。

Alignment > Export > Point Cloud > Sparse point cloud as Polygon File Format から書き出す。

この設定によりカメラポーズ(写真位置)については読み込んだcsvのデータを用いる事になるので、postshot上での写真位置推定はスキップされます。

読み込むと既にカメラと点群がビューポート上にある状態になる。

RealityCapture上と同じ状態で読み込めた。

あとは通常通り、お好みで設定を調整してトレーニングを開始する。

以下がこのワークフローでRealityCaptureを併用した大規模、広域の3D Gaussian Splattingの作例です。

(postshotのみでなく公式3DGSも併用してる例ではありますが)

600mの道程約2万枚の画像から生成しました。

]]>やりたかったやつ、ついに出来た。

広域3D Gaussian Splatting!

京都清水寺の参道600mを約2万枚の画像から3D復元。

せっかくだから体験可能な形でも用意したいな。#GaussianSplatting pic.twitter.com/WTlMgX9bm1— 龍 lilea (@lileaLab) May 7, 2024

COLMAPでは難しい複雑であったり規模の大きなシーンのアライメントをRealityCaptureやMetashapeで行い、そのデータを活用するといったものです。

この記事は手段の紹介なので手順の紹介ではないです。

(私の知識不足でやり方がわからんのもある

(手順も追々追記するか別記事で書くかも

COLMAPデータへの変換は1年前くらいから探り始めてたのだけど、ここ最近になって使いやすいツールがいくつか出てきて。ありがたや。

以下A~Fまで手法を上げていますが、現状では

「E」のRealityCapture-to-Postshot

が安定で便利な印象。

公式のフォーラムで機能リクエストされている。

・https://forums.unrealengine.com/t/support-colmap-export/1277698

投票せよ!そして気長に待つべし。

COLMAPのこのIssue によるとKaptureというものを使うとBundlerのoutファイル経由で変換できるらしい。

” In the meantime, one can probably use Naver/Kapture with an intermediate bundle.out file to produce colmap alignement files from RC. “

・https://github.com/naver/kapture

・https://europe.naverlabs.com/research/3d-vision/kapture/

後述の「RealityCapture-to-Postshot」はこのKaptureが使われている。

Jonathan Chemla氏にコマンド例教えていただいた。

・https://x.com/jo_chemla/status/1786488108747309472

RealityCaptureから書き出したcsvからColmapのimages.txtとcamera.txtを作成する

・COLMAP – images.txt

・nakano_muramotoさんの解説記事 – RealityCaptureのregistrationデータを流用する検討

・https://github.com/stuarta0/blender-photogrammetry

・NegativeMindさんの解説記事 – BlenderでPhotogrammetryできるアドオン

RealityCaptureから書きだしたBundlerを読み込む事ができ、そしてCOLMAPに書き出すことも出来る。

(Metashapeから書き出したBundlerでもいけるかは未確認だが、使えるはず?)

・https://github.com/Maxiviper117/RealityCapture-to-Postshot

RealityCaptureから書きだしたBundlerをCOLMAPに変換出来る。

(Metashapeから書き出したBundlerでもいけるかは未確認)

・https://github.com/agisoft-llc/metashape-scripts/blob/master/src/export_for_gaussian_splatting.py

Metashapeから直接COLMAP形式に変換出来る。

スクリプトで実行するのでPro版が必要。

※追記 先日(2024/9/9)のアップデートでv2.1.3以降はStandardライセンスでもCOLMAP形式に書き出せるようになりました。

COLMAPを経由せずに直接3D Gaussian SplattingやNeRF用のデータに変換できるものもあります。用途によってはこちらの方が簡単で良さそう。

COLMAPを経由せずにRealityCaptureから直接3D Gaussian Splattingへ持っていきたい場合は「Postshot」が対応しているので便利。

・https://www.jawset.com

具体的な使い方は こちら の記事にまとめました。

Metashapeから直接NeRF(instang-ngp)のtransform.jsonに変換したい場合は「agi2nerf」が有用。

・https://github.com/EnricoAhlers/agi2nerf

RealityCaptureから直接NeRF(instang-ngp)のtransform.jsonに変換したい場合は「rc2nerf」が便利。

・https://github.com/joreeves/rc2nerf

このワークフローを利用して京都の清水寺参道、600mの道程を約2万枚の画像から生成しました。

やりたかったやつ、ついに出来た。

広域3D Gaussian Splatting!

京都清水寺の参道600mを約2万枚の画像から3D復元。

せっかくだから体験可能な形でも用意したいな。#GaussianSplatting pic.twitter.com/WTlMgX9bm1— 龍 lilea (@lileaLab) May 7, 2024

「HoloLab Conference」はホロラボとともに新しい技術をいち早く使いこなす企業様と、それを支えるエンジニアの経験を広く共有し繋がり、より多くの人たちがこれらの技術を体験できるようにすることを目的とした「場」です。

各企業様とホロラボが取り組みを進めてきたMixed Realityの実⽤に向けた取り組みや、BIM/3D CAD/3D CG/点群のような3Dデータ活用に向けた取り組み、GPS/VPS(Visual Positioning System)/PLATEAUのような空間情報技術活⽤に向けた取り組みの事例共有の場として「HoloLab Conference 2024」を開催します。

オンライン一般参加をご希望される方は、下記ページよりお申込みください。 https://connpass.com/event/311388

オンライン一般参加では、Zoomでのリアルタイムセッション視聴/質疑応答が可能です。

※当日のセッション視聴方法についてはお申し込みいただいた方に別途ご案内させていただきます。

実用に向けた取り組みをされている各社様とホロラボ合同の事例セッションと、基盤技術や技術調査などについての技術セッションの2種類のセッションを実施します。セッションは2タイムテーブルの進行で合計で最大15セッション程度を予定しています。

また、後日セッションをアーカイブ動画として公開する予定ですが、映像や音声へ編集が入る場合や一部セッションについては公開無しになる場合があります。ぜひリアルタイムでご参加ください。

株式会社ホロラボ イベント窓口:event@hololab.co.jp

]]>

弊社依頼時のクオリティサンプルとしてお手元でぜひご確認ください!

本手法によって作成される3D樹木モデルは実測に基づいており、かつ、樹木の点群データから3Dモデル化を行うためのアルゴリズムの使用により、実物に近い樹形の再現性を可能としております。

また、季節ごとの差分モデルによって、同じ樹木でも季節による違いを視覚的に確認することができます。

今回の樹木モデルをはじめ、空間スキャンやフォトグラメトリ・デジタルアーカイブ、デジタル空間&体験デザインなどの空間情報技術に特化したメンバーが在籍しています。

撮影からデータ整備、コンテンツ制作までを一貫して担当することができますので、ご興味ある方は下記よりお問い合わせください。

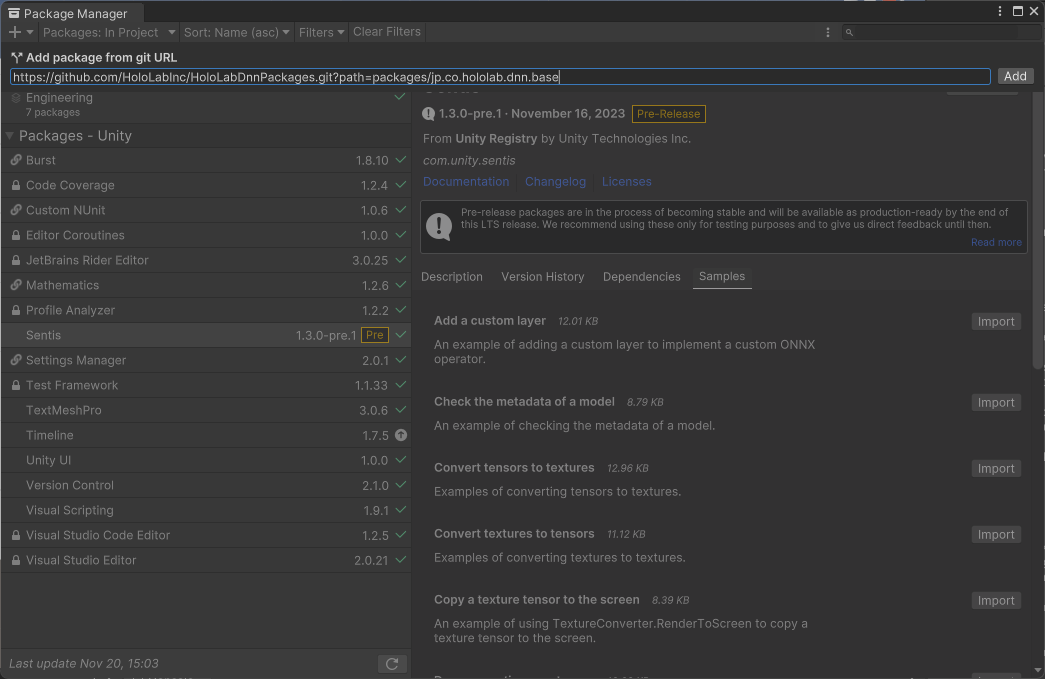

]]>このたび、Unityで手軽に使える画像認識パッケージのHoloLab DNN Packagesを公開しましたのでご紹介いたします。

HoloLab DNN Packagesは以下のリポジトリで公開されています。

HoloLab DNN PackagesはUnity Sentisをベースにディープラーニングによる画像認識を実装したパッケージ集です。

本パッケージには以下の特徴があります。

HoloLab DNN Packagesをセットアップする方法を紹介します。

HoloLab DNN Packagesはベースとなる1つのパッケージと画像認識のタスクが実装されたいくつかのパッケージで構成されています。

それぞれのタスクのパッケージはベースのパッケージに依存するので、ベースのパッケージとセットでインポートしてください。

パッケージのURLはそれぞれのパッケージのREADMEを参照してください。

HoloLab DNN Packagesのそれぞれのタスクのパッケージには直ぐに実行できる簡単なサンプルが含まれています。

ここでは、サンプルの実行方法を簡単に紹介します。

UnityのProjectウィンドウのSamplesフォルダにサンプルがインポートされます。

Scenesフォルダに含まれているシーンに切り替え、Unityの[Play]ボタンを押して実行してください。

サンプルは画像とボタンが1つずつ配置されたシンプルな画面になっています。

画像の下にある[Inference]ボタンを押すと推論が実行されて結果が表示されます。

(初期化があるので初回の実行のみ少し時間が掛かる可能性があります。)

基本的に以下の流れで画像認識を実装できるようになっています。

名前空間を参照する

using Unity.Sentis;

using HoloLab.DNN.Classification;

クラスのインスタンスを作成する

[SerializeField] private ModelAsset weights;

var model = new ClassificationModel(weights);

利用する学習済みモデルに合わせてパラメータを設定する

model.SetApplySoftmax(true);

メソッドに画像や閾値を渡して実行する

(var class_id, var score) = model.Classify(texture);

このように、HoloLab DNN Packagesを利用することで、ユーザーはわずか数行の記述で目的の画像認識を実装することができます。

スクリプトからの詳しい利用方法は、それぞれのサンプルのソースコードを参照してください。

Unityで手軽に使える画像認識パッケージのHoloLab DNN Packagesを紹介しました。

HoloLab DNN Packagesを利用してアプリに画像認識を組み込んでみてください。

CEOの中村です。

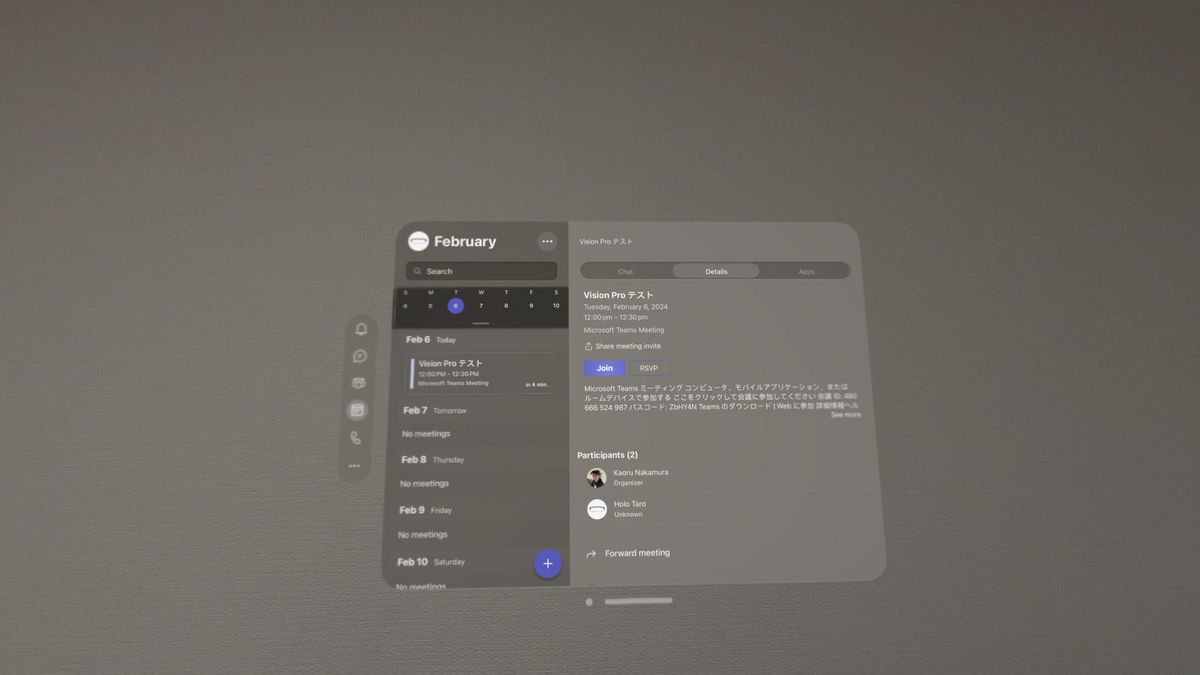

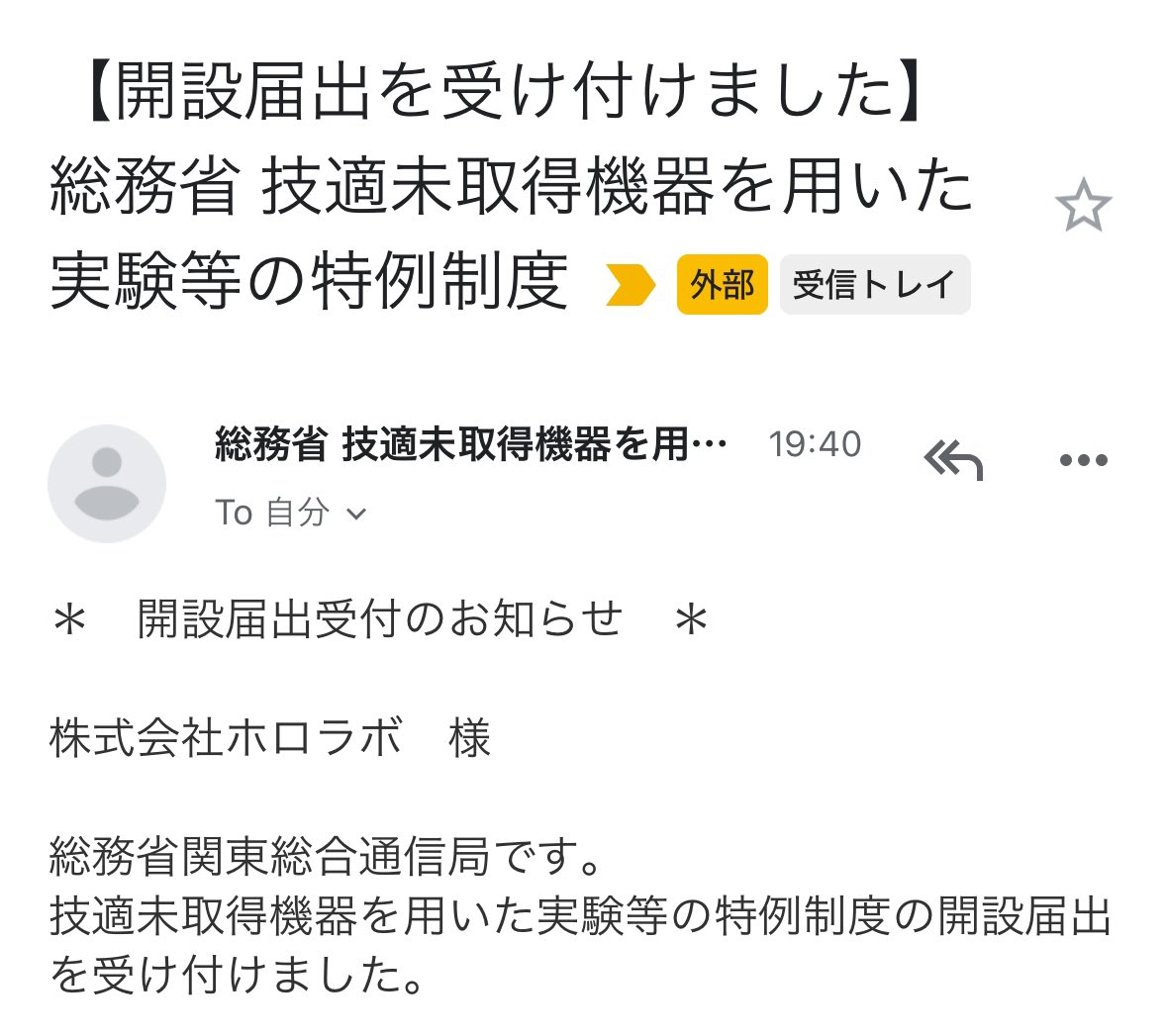

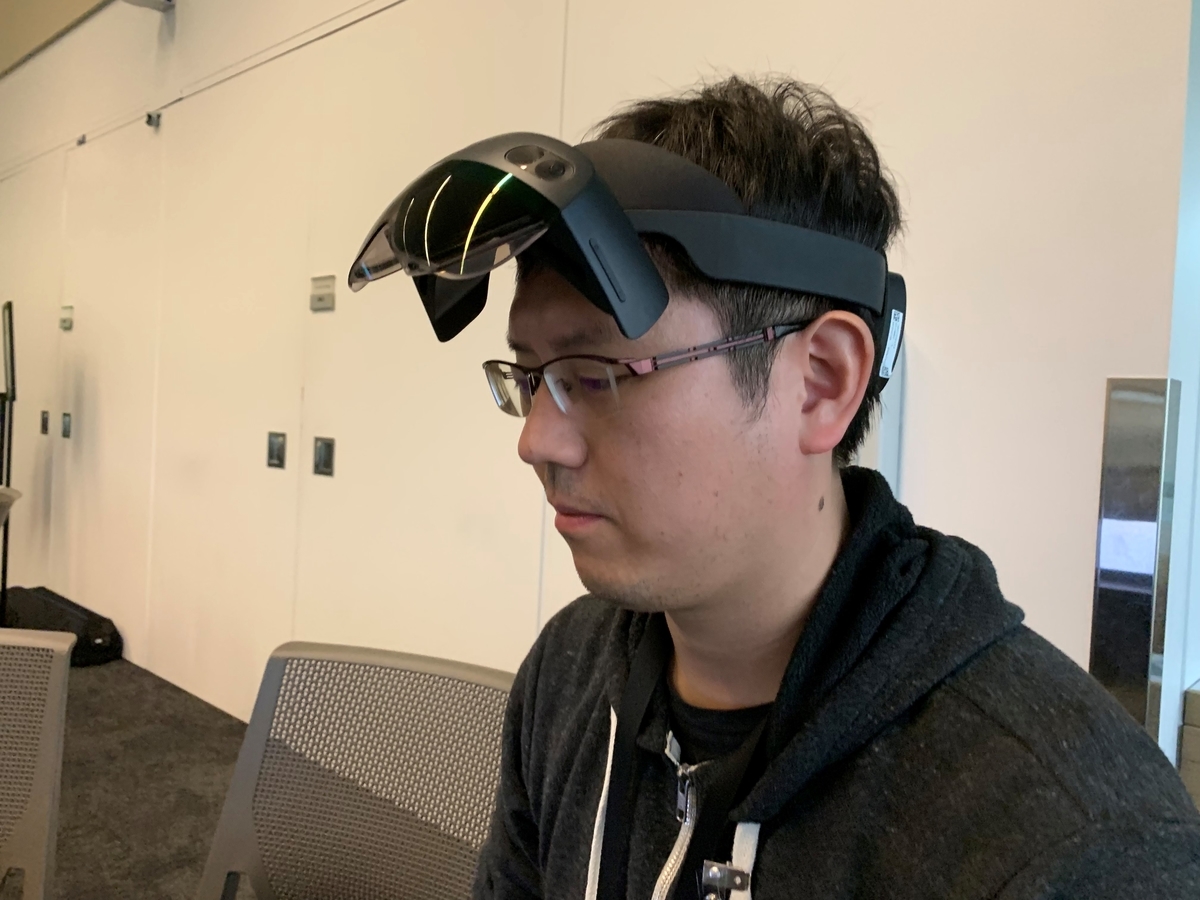

そろそろ Apple Vision Pro の米国発売から一週間経ちます。ホロラボもハワイにて Apple Vision Pro を無事に購入できました。

バックアップ及び空間共有機能のテストを含めてとりあえず2台。

ハワイ Ala MoanaのApple Storeにて受け取り。予定が16:30だったのですが、店員さんと会話して10:00に前倒し。

受け取りして同じくハワイに購入に来ていたジャーナリストの西田さんのところにお邪魔して場所を借りつつ開封の儀。

粛々とセットアップを行なっていました。

色々アンボックスしてる人々 pic.twitter.com/tC700dCgXT

— Munechika Nishida (@mnishi41) 2024年2月3日

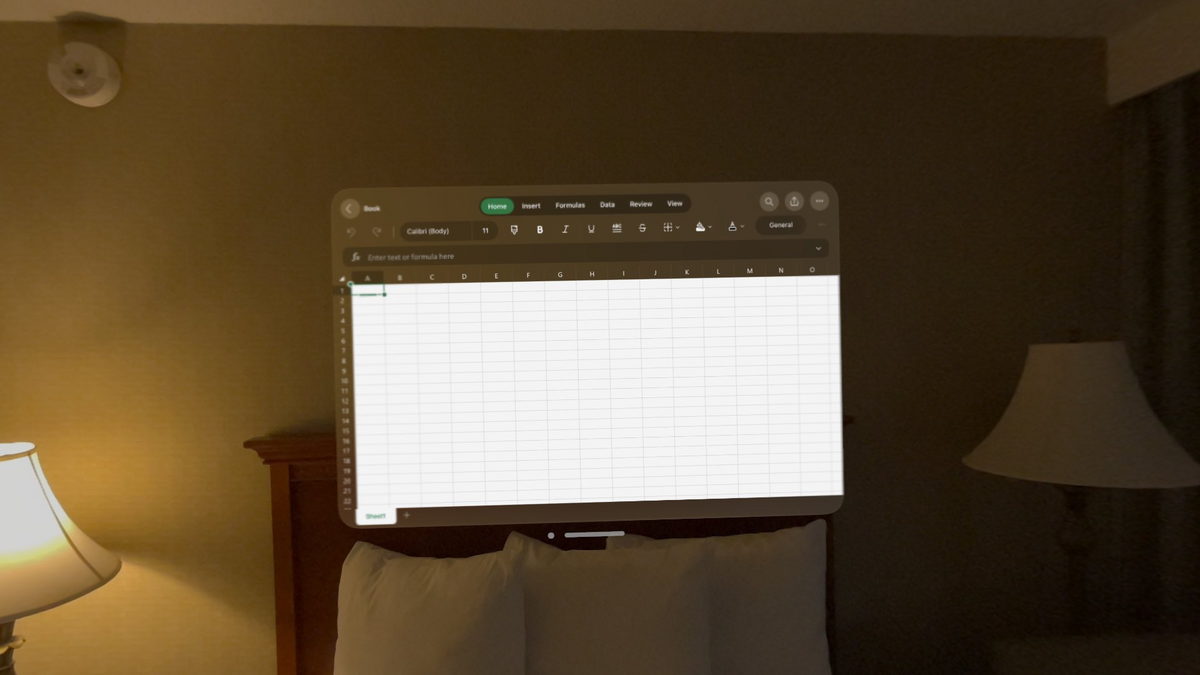

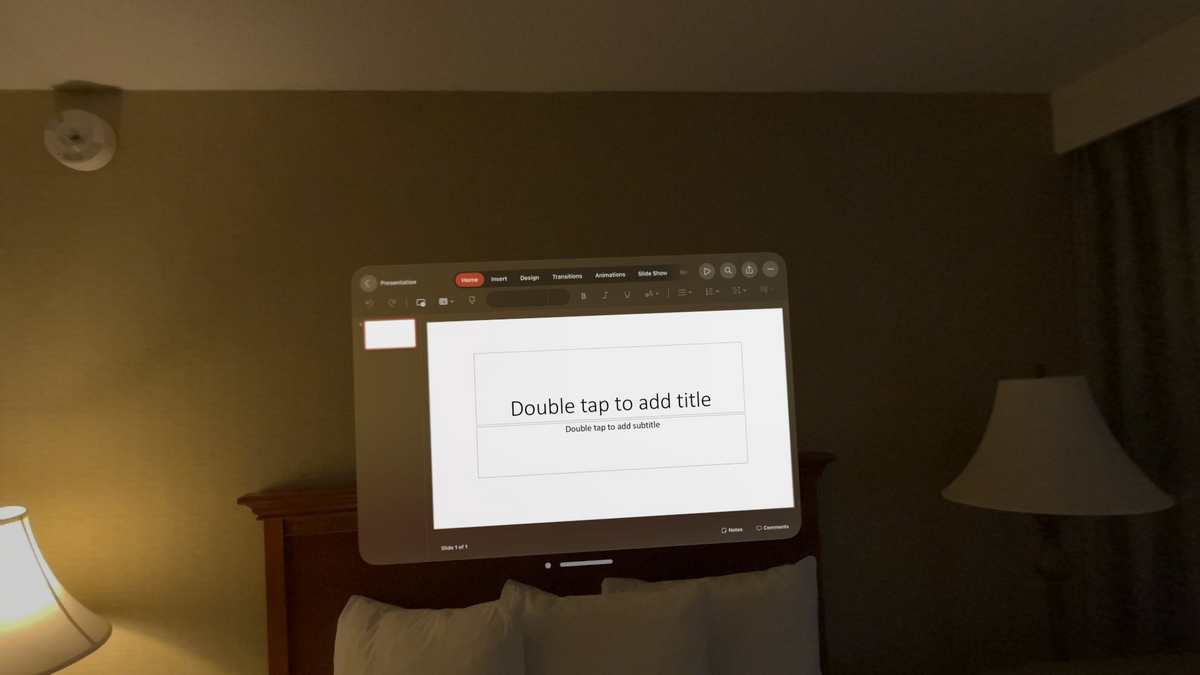

単体のハードウェアとしての出来上がりは流石のApple品質。というところで、体験や操作をしてて「あれ?」というような引っかかりもなく、とても良いものと感じています。

ディスプレイ性能もよくコンテンツはドットも見ない高品質に表示され、ビデオシースルーも歪みやズレも少なくApple Vision Proを装着したまま室内の移動やスマートフォンの操作などができるほどです。

操作についても目で選択して、指のタップで選択。という他のデバイスに近い操作体系で特に迷うこともなく。

初見の方の場合は「目の操作」、「指でタップ」は慣れるまで難しいので、少し練習が必要です。ここはHoloLens 2などと同じですね。

アプリは現状では米国で公開されているアプリのみになりますが、 Apple Vision Pro 専用アプリのみならず、iOS/iPad OSのアプリとして公開されているものも(パブリッシャーの指定があれば)インストールしての利用が可能です。

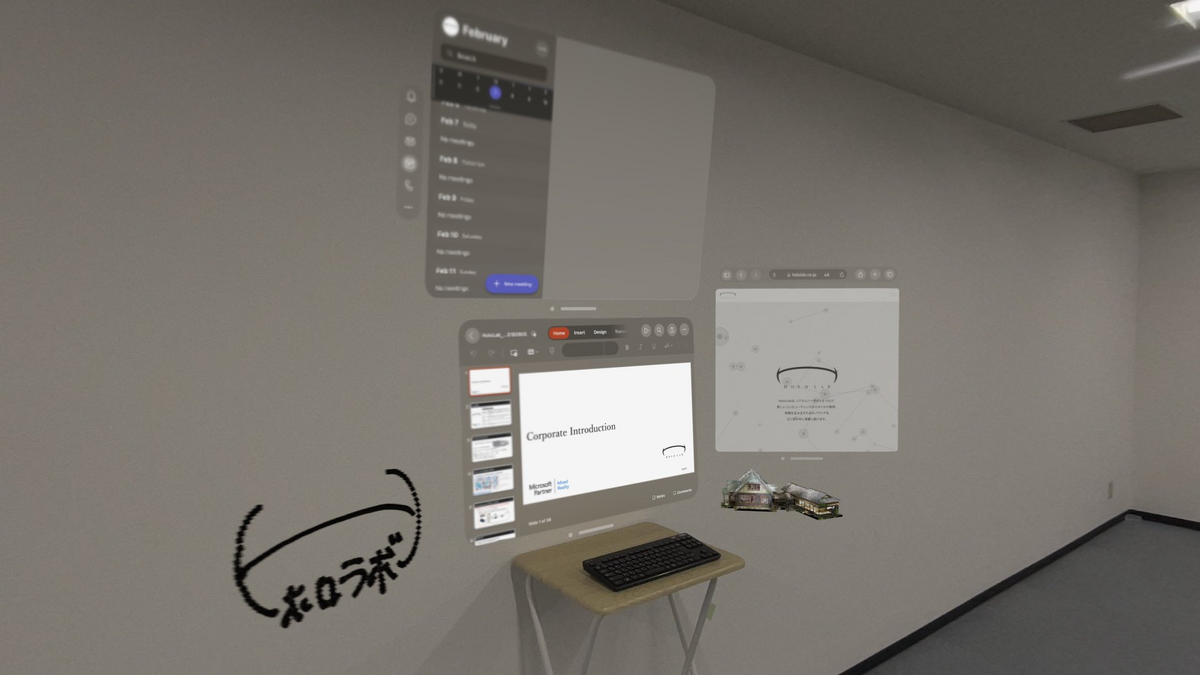

左(最初)の画像が Apple Vision Pro専用アプリ、右(次)が iOS/iPad OS 互換アプリになります。

XやCatGPTなどの2Dで十分なアプリは、今までのアプリをそのまま利用可能になり、最初のアプリ数の壁を超えています。

仕事の環境として。という意味では、Microsoft TeamsやPower Point、 Excel、WordといったOfficeアプリはApple Vision Proのネイティブアプリとして公開されています。Outlook、OneNoteはiOS/iPad OS互換アプリとしてストアからインストールできます。

Bluetoothキーボードの接続もできるので、Apple Vision Proを装着しながら外部キーボードと合わせて業務が可能ですね。

Apple Vision Pro には外側にもディスプレイが付いており、自分の目の周辺を表示できます。

「ペルソナ」という機能でこのようにApple Vision Pro を持って自分で自分の顔をスキャンします。

賛否それぞれの感想を見ますが、個人的にはEyeSight は好きです。

Meta Quest 3など、今までのビデオシースルーでの経験で、HMD(Head Mounted Display)を装着している方は相手の表情が見えるけど、装着してない方は相手(装着している方)の表情が見えない関係だったので、力技にせよ同じような見え方になるのはより現実のコミュニケーションに近づくと考えています。

Apple Vision Proはハードウェア単体でも高品質なデバイスですが、Appleの製品ということでAppleのハードウェア、ソフトウェアの中に入ってこそ本領発揮だと考えています。

最初にApple Vision Proで体験している光景を共有したり、他の方が体験している様子を見たい時には、Apple Vision Proがら見えている様子をどこかに表示させたくなります。

いきなりここでAppleのいままでの流れと同じことができ、AirPlayにてApple TVでの表示が可能です。iOS/iPad OS 17以降ではiPhone/iPadをAirPlayレシーバーとして設定する機能もありますので、Apple TVがない場合でも、iPhone/iPadで表示が可能です。

Apple Vision Proの画面をiPadに転送している様子(Apple Vision Proで見ている光景(iPadやアプリ)がiPad上にも表示されている)

また、いままでのデバイスで意外と手間がかかっていたファイルの共有についてはAirDropでの転送が可能です。

AirDropはApple Vision Pro, iPhone, iPad, Mac間でそれぞれファイルの転送が可能で、これを利用すると下記のようにiPhoneでスキャンしたデータをすぐさまApple Vision Proに転送して利用する。ということが可能になります。

iPhoneLiDARでスキャンした モデルをそのままVision Proに。

— 中村 薫 (@kaorun55) 2024年2月4日

AirDropですぐに転送できるのがでがるで良い。

この動画はVision Proで撮ったものをAirDropでiPhoneに送ってアップしてる。#AppleVisionPro pic.twitter.com/M7FGMQjGAp

ここからの派生として、Appleデバイス間で共通の「USDZ」という3Dを表現するファイル形式があります。

元々映画制作のPixerが定義したUSDというフォーマットで、Apple製品ではこの派生フォーマットであるUSDZをOSで扱うことができます。

iOS/iPad OSではAR Quick LookとしてモデルビューアーやARにて表示できます。

Apple VIsion ProでももちろんUSDZがサポートされており、先ほどのようにiPhoneのLiDARで3Dスキャンした3DモデルをUSDZでAirDropでApple Vision Proに転送することにより、すぐさま実寸でモデルの確認ができます。

最初にも書いた通り、ディスプレイはとてもキレイですので、高品質な3Dモデルが高品質なまま閲覧体験が可能です。

先日公開した沖本家住宅も綺麗に出せる。

— 中村 薫 (@kaorun55) 2024年2月4日

#AppleVisionPro pic.twitter.com/uA1HxXxT79

AirPods Proとの連携も強力で、AirPods Proでは外音を遮断できます。飛行機の中でも飛行音が聞こえなくなるほどです。

Apple Vision Proは視覚を遮断できるデバイスです。カメラから映像を中のディスプレイに表示するビデオシースルーという方式のため、ディスプレイの映像をカメラではなくコンピューターで作成した空間にすることで、視覚の外界との接点を切ることができます。

この2つを組み合わせることで、視覚と聴覚を外界から切り離し、体験に没入することが可能になります。

この体験には「Mindfulness」というアプリがおすすめです。

Apple Vision Proで視覚と聴覚のノイズキャンセリングだとMindfulnessアプリがオススメ。

— 中村 薫 (@kaorun55) 2024年2月10日

最初は外が見えていて途中から真っ暗になって視界が遮断される。

AirPods Proで聴覚も遮断すると、ほぼ外界から断絶した環境にできる。 pic.twitter.com/8iXLWqs7cQ

このほかにもMacをApple Vision Proに接続してディスプレイにできる「Mac Virtual Display」により、MacをApple Vision Pro内で使うことができます。

Apple Vision Pro単体では対応していないアプリや作業などはMacを併用することでApple Vision Pro内で完結することができます。

このようにApple Vision Proはハードウェア単体でも、Appleエコシステムの中でもいままでとは違った使い方、体験ができるデバイスと考えています。

今後日本で発売された後はそれぞれの環境に合わせた使い方が可能です。

Apple製品を多数お持ちの方はAppleハードウェアエコシステムの恩恵を受けながら。

Apple製品をあまりお持ちでない方はApple Vision Proから。

Apple Vision Proからの場合は、キーボード、Magic TrackPad、AirPods Proを合わせて持っておくと、Apple VIsion Proで完結する環境ができて良いでしょう。

ホロラボでももちろんApple Vision Proのアプリ開発に取り組みます。

最初のアプリとして「Spatial Paint」という空間ペイントのアプリケーションを米国App Storeにて公開しました。

apps.apple.comこのアプリは文字通り空間にお絵かきができるアプリで、VRアーティストのせきぐちあいみさんとコラボレーションを進めていきます。

もちろんApple VIsion Proをお持ちの全ての方に使っていただけますので、ぜひインストールしてください。

Spatial painting with #AppleVisionPro https://t.co/QZ3t944ntM pic.twitter.com/L0gLuKyzAM

— Aimi Sekiguchi🌐ايمي (@sekiguchiaimi) 2024年2月8日

「Spatial Paint」はいままでのホロラボの取り組みと異なるとようにも見えますが、HoloLensでペイントアプリ作ってせきぐちさんとコラボレーションしてるメンバーがいて、これをApple Vision Proに合わせてアプリリリースをする。という経緯です。

Apple Vision Pro自体もコンシューマーに向いており、これを機に空間の中でコンピューター扱うというユーザーが増えると考えています。

その中で空間で「絵を描く」というシンプルですが、わかりやすいテーマでのアプリ。としています。

また、Apple Vision Proはデバイス単体ではなく、コミュニケーションを重視していると考えていますので、描いたモデルはUSDZで出力し、共有することが可能です。

これによって、ユーザーは自分が描いたモデルを共有し、お互いに楽しむことができます。もちろんiOS/iPad OSの方もそこに加われます。

描いたものを空間に置いていく pic.twitter.com/xCDmM5WWQA

— 中村 薫 (@kaorun55) 2024年2月4日

いままでのサービスの延長もあります。

ホロラボにて提供しているBIM/CAD向けサービスであるmixpaceのApple Vision Pro版を日本発売に向けて準備を進めています。

Apple Vision Proでの高品質なディスプレイにより、いままでとは違った体験になりますので、登場をお待ちください。

空間コンピューティングの自分なりの解釈として、空間とコンピューターが日常世界で共存する世界、Apple Vision Proを日常から使い続ける世界に変わっていくと、いままでの生活スタイルも少しずつ変わっていくのかなと考えています。

技適特例申請も提出したので、この範囲内で試していきます。

基本は公式マニュアルの通りではありますが、ところどころ躓くところもあったので備忘録としてスクショ多めで。

Unityで制作できるアプリのタイプの名称について一旦整理。

要件はこちら。

まずはXcode 15.2を入れる。

visionOSにチェック入れる。

Unityのバージョンは2022.3.18f1以降。

2023は現時点ではLTSではないので2022を使う。

テンプレートは2022.3.18f1なので同じバージョンをインストールする。

Appleシリコン版の方をインストールする。

モジュールはvisonOSとiOSの両方を入れる。

パススルーを用いたMixed Reality(PolySpatial MR)のコンテンツを作成する場合の手順です。

VR(Fully Immersive)のコンテンツの場合については次項。

このマニュアルに従って作成する。

まずUnity2022.3.18f1で新規プロジェクト作成。

ビルトインシェーダーでも動作はするがMRのサンプルコンテンツはURPで作られているので特別な理由がなければURPで作るのが良さそう

Project SettingsでXR Plugin Managementをインストーする。

Apple visionOSを有効にする。

XR Plug-in ManagementのApple visionOSを開きMixed Realityを選択する。

このMixed Realityを選択したことで以下の3つのパッケージがインストールされた。

com.unity.polyspatial

com.unity.polyspatial.visionos

com.unity.polyspatial.xr

Usage Descriptionに適当な文章を記入する。

例)

Use hands tracking

Use world sensing

環境構築は以上だが、サンプルシーンを使う場合は Packages > PolyStatial > Sample からインポートする。

インポートしたシーンはこちらにある。

各サンプルシーンの概要はこちら。

プロジェクトの作成は以上。

続いて、実機ビルドせずに実行結果をUnityエディタ上で確認できるvisionOSシミュレーター「Play to Device」を設定しておくと便利です。こちらについては記事の後半に記しました。

Fully Immersiveのプロジェクト。

つまりMRは使用しない、完全没入のVRのプロジェクトを作成する場合。

こちらのマニュアルに従って進める。

XR Plug-in ManagementのApple visionOSを開くところまでは前項目のMRのときと同様の手順。

Fully Immersiveの場合はここでVirtual Realityの方を選択する。

前項目はUnityプロジェクトを1から構築する場合だったが、ここではテンプレートを使用する場合について。

テンプレートのzipを解答しUnityで開く。

(テンプレートを使った場合はXR Plug-in ManagementのApple visionOSのチェックは既に入っている

(必要なパッケージも既に入っている

メニュー > Tutorial > Show Tutorials を選択。

表示されたウィンドウ内にある各ボタンをクリックすると、VRコンテンツを制作するためのチュートリアルが開始される。

visionOSのシミュレーターの設定。

こちらのマニュアルを参考に進める。

ディスカッションページはこちら。

PlayToDeviceHost-1.0.3.zipをダウンロードする。

zipを解凍する。

Xcodeを起動しSimulatorを起動する。(またはComannd+SpaceからSimulatorを実行)

ここでiPhoneのシミュレーターが立ち上がってしまった場合は、アプリ上のメニューからApple Vision Proを選択する。

ダウンロードしたPlayToDeviceHost.appをシミュレーター画面内にドラッグ&ドロップする。

visionOSのシミュレーターでPlay To Device Hostアプリを起動する。

この状態でUnityでPlayするとシミュレーター側に表示される。

以上。

通常通りのビルドでOKだが、私の環境では以下のエラーが出てしまった。

Building Library/Bee/artifacts/iOS/AsyncPluginsFromLinker failed with output:

UnityEditor.Build.BuildFailedException: Burst compiler (1.8.12) failed running

stdout:

Internal burstc error:

Burst.Compiler.IL.Aot.AotLinkerException: Failed to determine xcode installation path - "xcode-select -p" is XCode installed? xcrun: error: invalid active developer path (/Library/Developer/CommandLineTools), missing xcrun at: /Library/Developer/CommandLineTools/usr/bin/xcrun

こちらの記事を参考に対応しました。

ターミナルに以下のコマンドを実行です。

sudo xcode-select --switch /Applications/Xcode.app

これでエラーなくビルドできるようになりました。

以上!

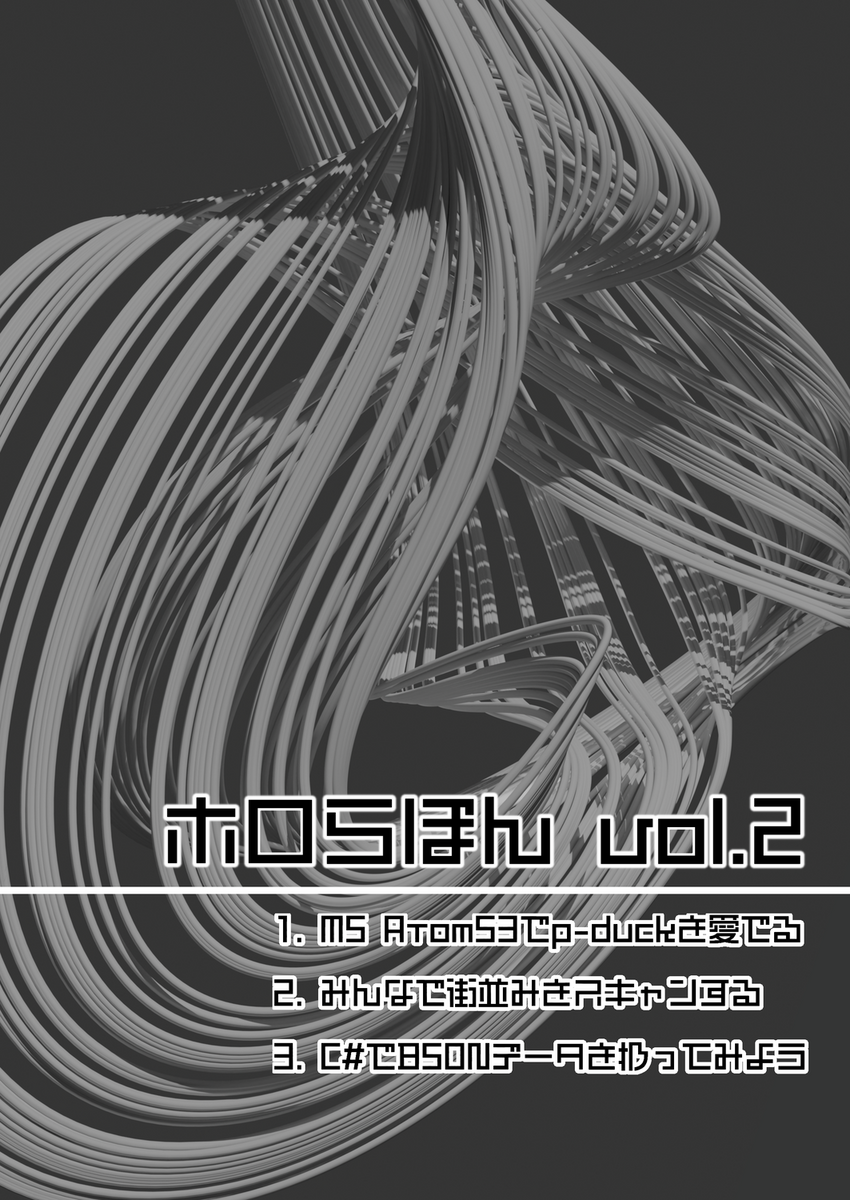

]]>このたび、ホロラボの有志で技術同人誌「ホロらぼん Vol.2」を制作し、技術書典15で頒布しました。

イベントは終わりましたが、引き続きこちらのURLで無料で頒布していますので、 よろしければご一読ください。 メンバーそれぞれが今興味がある技術について書いたごった煮な技術同人誌となっています。

目次

M5 AtomS3でp-duckを愛でる M5 AtomS3という小さなデバイスでp-duckをSlackにスタンプするデバイスを作りました。

みんなで街並みをスキャンする 街並みスキャンのスキャンソンについて。 イベント紹介やスキャンのコツなどを解説。

C#でBSONデータを扱ってみよう C#でBSONシリアライズ形式を使うときのTipsなど。

よろしくお願いします。

]]>UE記事一発目、UEでのMVVMについて触れていこうかと思います。 過去、お仕事でUnityにおいてC#でMVPパターンにて設計を行ったことがあるのですが、特に継続性のあるプロジェクトや複数デバイス/プラットフォームでの実装などを見越している場合では、かなりの効果を発揮すると実感しています。 今回、MVPではなくMVVMパターンに焦点を当てていきますが、UEでの設計の勉強の一つとして書いていきます。

今回、alweiさんのMVVMの記事を前提とします。 - UE5 UMG ViewModelを利用してBPオンリーのMVVMをしてみる https://unrealengine.hatenablog.com/entry/2023/09/28/233801

まず記事を書こうと思った動機としては、View-ViewModel側やModel側にバリエーションを持たせたとき、実際にどう作っていくのがよいかと疑問に思ったためです。

alweiさんの参考記事の場合、最終的には図のようにゲージが減少していくLevelが作成できます。

この場合、View, ViewModelおよびModelの関係性の概念図としては下図のようになります。

この応用として、まずModel層側のもう一つのパターンとして、ゲージを減少させるのではなく増加させるパターンを作ります。さらに、View層のもう一つのパターンとして、円形のゲージを扱うパターンを作成します。

すなわち、今回行いたいことを先ほどの概念図に追記すると、下図のようになります。

今回、Model側でのパターン作成はシンプルなものになります。まず、参考記事におけるThirdPersonCharactorをRenameし、「BP_ReduceLifeThirdPersonCharacter」とします。次に、「BP_ReduceLifeThirdPersonCharacter」をCopyし、「BP_IncreaseLifeThirdPersonCharacter」と名前を付けます。

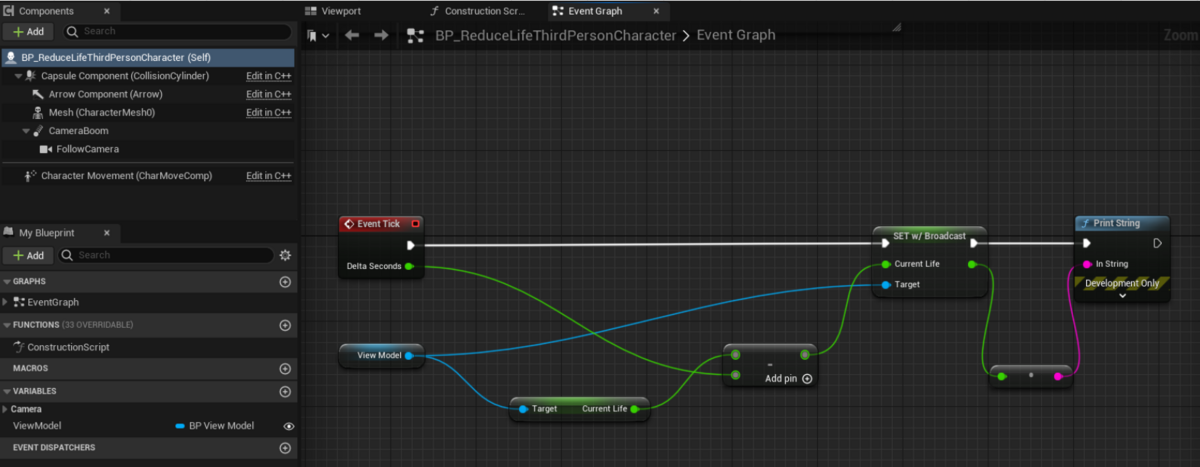

BP_ReduceLifeThirdPersonCharacterにおけるEventTick内での処理は、図のようになっているはずです。

なので、増加させるパターンの場合、図のようにノードを組み替えれば「BP_IncreaseLifeThirdPersonCharacter」が作成できたことになります。

最後に、ContentsBrowserのModel層のファイルは図の二つになっています。これで、Model層での準備は完了です。

次に、View側で円形ゲージのパターンを作ります。円形ゲージ用の「M_CircleGauge」を作成します。(下記記事を参考にしています。)

また、「M_CircleGauge」のMaterialGraphはこのようになります。

そして、「M_CircleGauge」を親としたMaterialInstanceである「M_CircleGauge_Inst」を作成しておきます。

参考記事におけるWBP_LifeGaugeをRenameし、「WBP_LifeGauge_Straight」とします。次に、新しくWidgetBlueprintを作成し、「WBP_LifeGauge_Circle」と名前を付けます。そして、下図の状態になるように「WBP_LifeGauge_Circle」の状態を設定していきます。

最後に、ViewBindeingsビューにて、図のようにBP_ViewModelのSetLifePercent関数を、Image_LifeのSetOpacityにBindします。最終的に、ContentsBrowserのView層のファイルは図のようにになっています。これで、View層での準備は完了です。

では、動かしてみましょう。まず、NewLevelからBasicを選択し、新しいLevel「SampleMap」を作成します。そして、原点位置にPlayerStartを配置します。

次に、このLevelのLevelBlueprintを編集していきます。編集結果として、図のようなLevelBluePrintを組んでください。

また、WorldSettingsビューにて、DesualtPawnClassに対し、LevelBlueprintでの実装と同じCharactorクラスを割り当ててください(この場合、「BP_ReduceLifeThirdPersonCharacter」を割り当ててください)

今回はLife量は減少、ゲージは円形、といった形になります。実行すると、図のような動きになるはずです。

ここで少しLevelBlueprintについて解説してきます。まず、Construct BPViewModelノードにて、BP_ViewModelのインスタンスを作成します。

次に、Model層のCharactorクラスの取得と、ViewModelへのアタッチを行います。この際、下記図のように減少させる場合と増加させる場合の両パターンについてノードを組んでおき、切り替えられるようにしておきます。

そして、WidgetBlueprintのインスタンスを作成することで、これをBP_ViewModelに紐づくViewとします。

ここで、下図のように、WidgetBlueprintを「WBP_LifeGauge_Straight」か「WBP_LifeGauge_Circle」かを切り替えることで、円形ゲージか直線ゲージかを切り替えられる形になります。

一つ別の組み合わせとして、Life量が増加していき、直線ゲージの場合、動かすと下図のようになります。

また、そのときのLelevBluePrintは下記のようになります。

以上で、MVVMについて、UMG ViewModelによるViewとModelのパターンの拡張と切り替えを行ってみました。 この先としては、Charactor以外のModel層の例や、ViewやModelにInterfaceを使う形でDI (Dependency Injection)をする形について模索するところかなと思いますが、まぁ気が向いたらってことになりそうです。

また、サンプルのプロジェクトをgithubに公開しています。 github.com

]]>今年は開発面だけでなく、より営業/PM面に踏み込むということをしてきました。 その中で、社外とのやり取りだけでなく、社内的にもどうしていくか、といった面に対して、自分の能力の課題が見つかりました。

また、今後はどう効率的に物事をこなしていくか(もちろん質は下げずに)、そこがテーマになってくるような気がしています。

幸せなことに、わりと研究よりのお仕事に携わることが多く、以前より自分の興味領域でお仕事をさせてもらっています。 ただアカデミック的な活動はどうかというと、あまりできていない面があります。こちらの時間も作っていかないとというのが正直な気持ちです。

家族内に大きなことが発覚し、色々と大変ではありますが、なんとかやっていかなければという所存です。

まぁ今年もなんとか生きていきますw

]]>詳細はさくらサイエンスプログラムの活動報告レポートをご覧ください。

第34号:芝浦工業大学|2023年活動レポート:過去の実績を紹介|さくらサイエンスプログラム(JST)

2023年7月26日から8月4日にかけて、エチオピアのアディス・アベバ大学EiABC(Ethiopian Institute of Architecture, Building Construction and City Development)の教員2名と学生9名、計11名が芝浦工業大学建築学部建築学科を訪問し、東京デジタル・ヘリテージ・ワークショップが開催されました。芝浦工業大学からは教員2名と学生21名が参加し、企業や研究者の方々にも訪問していただきました。レクチャー、演習、体験、ディスカッション等を通じて、建築遺産における3Dデジタルアーカイブについての知識を深め、将来の活用方法について議論が行われました。(さくらサイエンスプログラムの報告記事から引用)

ホロラボからは中村薫、山田沙知氏の両名からAR技術を使用したまちづくりプロジェクトの事例紹介を行いました。

テーブルの上に敷かれた地図上にあるQRコードをHoloLensやiPadを通して見るとARの建物が浮かび上がるなど、市民参加型まちづくりの新たな手法を展示しました。 プロジェクトについては関連記事などをご覧ください。

展示依頼や登壇、講師依頼は随時受け付けていますので、HPより気軽にお問い合わせください。

]]>各イベント・展示会の詳細についてはお問い合わせください。

]]>清水寺の参道「産寧坂」「二年坂」「八坂通」の町並みや食べ物をフォトグラメトリによりデジタルアーカイブ。

生成したデジタルツイン空間をVR化&メタバースプラットフォームへ移植しました。

下記リンクより体験いただけます。

今回は一眼カメラは基本使用していないのです。

八坂の塔だけは一眼使ったのですが、町並みは全て360度カメラの動画。

なぜ一眼ではないのかというと、世界各国から観光客がやってくるような場所なので撮影できる時間が限られ、一眼では時間がかかりすぎて間に合わないからでした。

夏至の時期を狙い朝4:30から撮影開始したけれど、それでもちらほら人がいる。さすが京都随一の名所スポット。

なのでガチフォトグラメトリ品質ではないのは少々心残り。

下記の通りレーザースキャンも行ったが今回は活かしきれなかったか。

より詳しい撮影方法については東京大学にて登壇した際のスライドがありますのでこちらをご参照ください。

レーザースキャナRTC360でレーザースキャンしたのが2022年11月。

Insta360 One RS 1-inchで動画撮影したのが2023年7月。

というわけで現地の状況が結構変わってしまい。

本来はレーザースキャンデータとInsta360のデータを併用してメッシュ生成する予定でしたがだいぶおかしなメッシュになってしまったので、アライメントまではRTC360を利用していますがメッシュ生成以降は使用していません。

アライメントではレーザースキャンデータを使用しているので地理的な意味では結構な精度で一致。今回は約600mのエリアを生成しましたが地図ともしっかり合致。

今回も生成にはRealityCaptureを使用。

読み込ませた画像の総数は、

たべものスキャンは鮮度が命!?

現地で購入した饅頭やきんつば等、京都から関東の自宅まで持って帰ってくると形も崩れてしまうので、食物はすべて宿泊先の部屋でフォトグラメトリ撮影しました。

持っていける機材も限られていたので、百均で買ったビニール袋ラックとテグスを組み合わせて。

せっかく京都なんだしガチなフォトグラメトリもしたいところだったわ。

レーザースキャンと一眼をフルに使った本気バージョンやりたい。

また京都行こ。

京都をVR化してみた!

スマホでも体験いただけます。清水寺への参道を丸ごと再現。

実際の現地の町並みや和菓子をフォトグラメトリによりデジタルアーカイブ。バーチャル食べ歩き観光できちゃいます〜

VRの起動は続きから。 pic.twitter.com/TmvwTMn6bZ— 龍 lilea (@lileaLab) September 28, 2023

Togetterにまとめました。

https://togetter.com/li/2232605

京都VRを取り上げていただきました。

「MoguLive」様

https://www.moguravr.com/kyoto-vr/

「メタカル最前線」様

https://metacul-frontier.com/?p=7884

手順は公式GitHubのREADMEにもありますが、こうした環境構築に慣れてない自分は結構てこづったので、必要な手順を細かくまとめました。

・こちらはWindows用の手順です。

・環境構築やコマンドラインでの使い方にハードルを感じる場合は、GUIでの操作が可能なJawsetのPostshotが便利です。

記事の最後にその手順をまとめました。

データをDLして専用ビューワーで開くのみです。

環境構築や自前のデータを用意せず3D Gaussian Splattingがどんなものか触ってみたい人向け。

環境構築手順はこちらの方もまとめられているので、うまくいかない場合はこちらも合わせて参考にしてみてください。

・The NeRF Guru氏 – YouTube

・Alex Carlier氏 – ブログ

・ft-lab氏 – ブログ

上記サイトでは3D Gaussian Splattingを使ううえでその他の便利な機能の導入も紹介されていますが、以下にまとめた手順は純粋にGaussian Splattingのみを使うためのものです。

前提としてHardware Requirementsをクリアしてる必要があります。

(VRAMは24GB推奨ですが足りなくとも処理自体は可能 詳しくはFAQ参照)

ハードがOKであれば、Software Requirements に書かれている必要なソフトを用意します。

Software Requirements

・Conda (recommended for easy setup)

・C++ Compiler for PyTorch extensions (we used Visual Studio 2019 for Windows)

・CUDA SDK 11 for PyTorch extensions, install after Visual Studio (we used 11.8, known issues with 11.6)

・C++ Compiler and CUDA SDK must be compatible

具体的には以下に順に説明します。

・C++ Compiler for PyTorch extensions (we used Visual Studio 2019 for Windows)

Visual Studio 2019 をインストールする。

インストール出来たらVisual Studio Installerを立ち上げる。

「C++ によるデスクトップ開発」が必要なのでこれを有効にする。

・CUDA SDK 11 for PyTorch extensions, install after Visual Studio (we used 11.8, known issues with 11.6)

CUDA Toolkit 11.8が必要なのでインストールする。

(私の環境には元々CUDA 11.7が入ってたのでそのまま進めたが、だめだった。ちゃんと11.8を入れる)

インストーラーは ここ からDL。

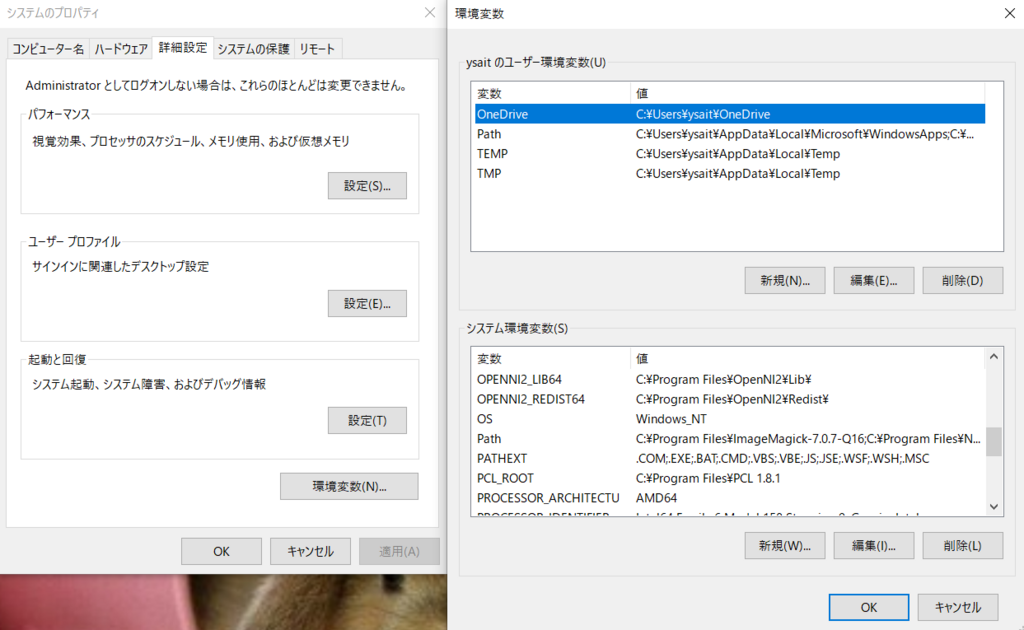

インストールしたら、システム環境変数を確認する。

CUDA_PATHの値がインストールしたCUDA11.8のバージョンになっていることを確認する。

別のバージョンになっていた場合は11.8のパスを指定する。

環境変数のPathも以下の通り追加する。

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.8\bin

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.8\libnvvp

後の手順でcl.exeへの参照があるので、事前に

C:\Program Files (x86)\Microsoft Visual Studio\2019\Community\VC\Auxiliary\Build\vcvars64.bat

のバッチファイルをダブルクリックで実行し環境変数を設定する。

実行すると一瞬黒いコマンドプロンプトの画面が立ち上がりすぐ消える。

GitHubからクローンするのでGitをインストールする。

https://git-scm.com/

Gitのインストールが必要なのは、GitHubからはzipファイルのダウンロードではなくクローンするため。

zipダウンロードだとサブモジュールが読み込まれないので注意。

Gitをインストールしたら、コマンドプロンプトを起動する。

GitHubからクローンするのでクローン先のディレクトリを作成し、そこへ移動する。

例) cd E:\Git\lileaLab\GaussianSplatting

クローンする。

git clone https://github.com/graphdeco-inria/gaussian-splatting --recursive

末尾にある --recusiveはサブモジュールもインストールするためのオプション。

・Conda (recommended for easy setup)

Pythonの仮想環境を使うため、Anacondaをインストールする。https://www.anaconda.com/

インストールできたら、Anaconda Promptを起動する。

SET DISTUTILS_USE_SDK=1を実行する。

※DISTUTILS_USE_SDKとは こちら を参考

クローンしたディレクトリに移動する。

例) cd E:\Git\lileaLab\GaussianSplatting/gaussian-splatting

conda env create --file environment.ymlコマンドで仮想環境を作成する。

ここでエラーになる場合は、前手順で用意したソフトのバージョンや環境変数の設定に誤りがないか見直しましょう。

環境構築は以上。

独自データの作成ではCOLMAPが使われるのでGitHubからDLしインストールしておく。

https://github.com/colmap/colmap/releases

独自の画像データを用意したら、一つのフォルダにまとめる。

ここでは仮にDataとする。Dataフォルダ内にinputフォルダを作成し、その中に画像を一式入れる。

Data

└input

. ├image0001.jpg

. ├image0002.jpg

. ├image0003.jpg

. ︙

独自データの作成にはクローンしたデータ内にあるconvert.pyを使う。

オプションでCOLMAP.batの場所と、独自データを保存したフォルダを指定する。

例) python convert.py --colmap_executable "D:\GoogleDrive\ProgramFiles\Colmap\COLMAP.bat" -s E:\Git\lileaLab\GaussianSplatting\Data

しばらくするとCOLMAPデータが出来上がる。

(写真の枚数や解像度によってそこそこ時間かかる)

トレーニングの実行にはtrain.pyを使用する。

前手順で作成したCOLMAPデータのフォルダを指定する。

例) python train.py -s E:\Git\lileaLab\GaussianSplatting\Data

写真の枚数によってそれなりに時間かかる。

トレーニングが完了すると gaussian-splatting > output フォルダ内に「123456ab-1」の様なランダムな文字列のフォルダが作成されている。

このフォルダを次の手順で用意するビューワーで読み込む。

RuntimeError: CUDA out of memory

対策A) 写真をリサイズして小さくする

対策B) –densify_grad_threshold を増やす

デフォルト0.0002 2D位置勾配に基づいてポイントを高密度化するかどうかを決定する制限

対策C) –densification_interval を増やす

デフォルト100 高密度化する頻度(100回の反復ごと)

対策D) –densify_until_iter を減らす

デフォルト15_000 高密度化が停止する反復

ビューワーを使用してトレーニング済みデータを読み込む。

ビューワーは こちら にビルド済みの実行ファイルがあるのでこれをDLし解凍する。

コマンドプロンプトでviewersフォルダへ移動し、オプションに上記手順で作成したトレーニング済みデータのフォルダを指定して実行する。

例) E:\Git\lileaLab\GaussianSplatting\viewer\bin\SIBR_gaussianViewer_app -m output\123456ab-1

操作方法は少し特殊。

移動はWASDQEだけど、視点の回転はマウスではなくUIOJKLキーになっている。

両手で操作する感じ。詳しくはこちら。

マウス操作で見たい場合は、Yキーを押すとトラックボールモードになりマウスで画面操作できるようになる。

以上!

こりゃ次世代の自由視点映像だ。#GaussianSplatting

60fps出るからドローン映像かのような滑らかさ。

NeRFと比べかなり鮮明で軽快。独自写真データでの生成手順、使い方もブログにまとめました!https://t.co/cscf2CyHkN pic.twitter.com/btV1Oj1XIl

— 龍 lilea (@lileaLab) September 4, 2023

環境構築や独自データの用意はせず、Gaussian Splattingがどんなものなのかとサンプルだけ実行してみたい場合の手順です。

(トレーニング済みデータをビューワーで閲覧する)

README の初めにあるリンク「Pre-trained Models」からトレーニング済みサンプルデータをDLする。

同じくその隣にある「Viewers for Windows」からビューワーをDLする。

DLしたらコマンドプロンプトでビューワーの実行ファイルを指定し、オプションで開きたいサンプルデータセットのフォルダをオプションを指定する。

それぞれDドライブ直下に解凍した場合の例) D:\viewers\bin\SIBR_gaussianViewer_app.exe -m D:\models\bicycle

ビューワーの操作は前項目で書いたものと同様。

以上。

]]>fatal: Cannot determine the organization name for this ‘dev.azure.com’ remote URL. Ensure the ‘credential.useHttpPath’ configuration value is set, or set the organization name ase the user in the remote URL ‘{org}@dev.azure.com’.

error: (以下省略)

Visual Studioを開きメニューのGitから設定を開く。

Gitグローバル設定の資格情報ヘルパーをGCM Coreに変更する。

以上。

これで再びプッシュできるようになった。

調べるたびにメモしていたものですが、ソースをメモしそびれいたので随時ソースのリンクも足していこうかなと。

そのソフトウェアやサービスの公式の情報が簡単に見つからなかったものは、スクショを検索してそこに写る座標から判断しています。

もし間違っているところあったらご指摘ください。

| 左手 | 右手 | |

|---|---|---|

| Y-up | Unity | Maya |

| LightWave | modo | |

| Zbrush | Substance Designer / Painter | |

| Cinema4D | Houdini | |

| Quixel Mixer | Godot | |

| DirectX | Mine craft | |

| Metal | Softimage | |

| Motionbuilder | ||

| KATANA | ||

| Nuke | ||

| Fusion 360 | ||

| After Effects | ||

| Dimension | ||

| 3D-Coat | ||

| TouchDesigner | ||

| Shade3D | ||

| Metasequoia | ||

| Xismo | ||

| Xenko | ||

| Roblox Studio | ||

| Buildbox | ||

| OpenGL | ||

| Vulkan | ||

| Marvelous Designer | ||

| Solidworks | ||

| Inventor | ||

| iCAD | ||

| CloudCompare | ||

| AzureRemoteRendering | ||

| ARKit | ||

| Vision Pro | ||

| Z-up | UnrealEngine | 3dsMax |

| blender | ||

| SketchUp | ||

| Souce | ||

| AutoCAD | ||

| Photoshop | ||

| Stingray | ||

| Lumberyard | ||

| CryENGINE | ||

| Rhinoceros | ||

| Civile 3D | ||

| Vectorworks | ||

| NX | ||

| Revit | ||

| ARCHICAD | ||

| formZ | ||

| Catia | ||

| Rebro | ||

| Parasolid | ||

| InfiPoints | ||

| RealityCapture | ||

| Twinmotion |

こちらのURLで無料で頒布していますので、 よろしければご一読ください。

メンバーそれぞれが今興味がある技術について書いたごった煮な技術同人誌となっています。

国土交通省が主導する3D都市モデルオープンデータPLATEAUをランタイムロードする仕組みを構築しました。

路地、その魅惑の空間へのいざない。路地入門から3Dスキャンの方法を紹介します。

LumaAIという写真や動画からの3D再構築サービスのAPIを使ってみました。

Ready Player Meという3DアバターサービスをUnityに組み込んでみました。

Unity Cloud Buildをなんとか使いやすく。実案件で培ったノウハウとツールを紹介します。

よろしくお願いします。

]]>

「HoloLab Conference」はホロラボとともに新しい技術をいち早く使いこなす企業様と、それを支えるエンジニアの経験を広く共有し繋がり、より多くの人たちがこれらの技術を体験できるようにすることを目的とした「場」です。

各企業様とホロラボが取り組みを進めてきたMixed Realityの実⽤に向けた取り組みや、BIM/3D CAD/3D CG/点群のような3Dデータ活用に向けた取り組み、GPS/VPS(Visual Positioning System)/PLATEAUのような空間情報技術活⽤に向けた取り組みの事例共有の場として「HoloLab Conference 2023」を開催します。

昨年も「HoloLab Conference 2022」を実施し、参加された企業様からのフィードバックや開催後のアーカイブ動画など、⾮常に盛況に終えることができました。

オンライン一般参加をご希望される方は、下記ページよりお申込みください。 https://hololab.connpass.com/event/276961

オンライン一般参加では、Zoomでのリアルタイムセッション視聴/質疑応答が可能です。

※当日のセッション視聴方法についてはお申し込みいただいた方に別途ご案内させていただきます。

実用に向けた取り組みをされている各社様とホロラボ合同の事例セッションと、基盤技術や技術調査などについての技術セッションの2種類のセッションを実施します。セッションは2タイムテーブルの進行で合計で最大15セッション程度を予定しています。

また、後日セッションはアーカイブとして公開する予定ですが、映像や音声の編集や一部セッションが非公開になる場合があります。ぜひリアルタイムでご参加ください。

会場施設と連携し各種ガイドラインを遵守とした感染対策の実施を予定しています。

・東京都様式「イベント開催時のチェックリスト」の公表

Holoconf23_東京都様式_イベント開催時のチェックリスト.pdf - Google ドライブ

株式会社ホロラボ イベント窓口:event@hololab.co.jp

※本記事に記載されている会社名および製品・サービス名は、各社の登録商標または商標です。

]]>6年目の年末が終わりました。 ホロラボも6期目が終わり、7期目に入りました。

引き続きアウトプットを出しつつも、少しずつ変化が出始めた年になったと思います。 スライドはこちら。

過去のふりかえりはこちら

全体の状況としては、コロナ禍は継続しつつも現場が戻ってきており、2022年の後半は出張も増えてきました。一方で、物理空間とデジタル空間をつなげる取り組みも引き続き続いています。

アプリ開発については、デバイスを使いつつも、それを広げるためのWebシステムやデータ準備の重要度が上がってきました。 後でも紹介しますが、Webアプリを主業務とするエンジニアに新たに加入、社内でロールチェンジしてもらい、いままでのメンバーと合わせてが10人になりました。 データについても新設したSIAR(サイアー : 空間情報技術)チームが1年を通して忙しくするほどにお引き合いをいただきました。 これによって、クライアント・デバイスアプリで使うための下地(Webシステム)とそこを通すデータがそろう形になります。

引き続きの注力分野であるクライアント・デバイスアプリについては、実運用を見据えて具体的な取り組みが増えています。

これらが、メンバーのロールやアウトプットの変化につながっています。

売上については堅調に推移しています。 ここには出していませんが、この2年くらいで業務体制の改定をしており、利益については大幅に改善をしています。

2022年も15人の方に新しく入社いただきました。

2021年も15人の方が入社、現在60人のため、この2年で倍の人数になりました。

概要でも書きましたが、特筆すべきはロールとしてWebのエンジニアが大幅に増えています。

2022年は5人の方にWebエンジニアとして入社いただき、3人の方がデバイス系のアプリエンジニアからWebエンジニアにロールが変わっています。

いままでWebエンジニアとして活躍していた2人と合わせて、計10人の体制となっています。

居住地については変わらず全国各地にメンバーがいる状況です。継続してフルリモートでの業務になり、それをメリットとして転職される方も多くいます。

2022年も多くのアウトプットを出すことができました。 関わっているメンバーや快く事例公開をしてくれるお客様に感謝です。

大きな仕事の一つとしては、NTTドコモ社/NTTコノキュー社のXR Cityの開発パートナーとしてサービスのリリースに関われたことです。

世界的にも類を見ない大きなサービスに関われリリースにたどり着けたことは非常に大きな経験だと感じています。

自社サービスの中心であるmixpaceは、粛々と開発を進めつつ、リコー社のバーチャルワークプレイスとの連携のリリースを行うことができました。 mixpaceはBIMやCADなどの3Dデータを即座にARなどで閲覧できる形式に変換します。これをVRに持っていくことでVRでの遠隔コミュニケーションに利用することが可能になりました。

変換については、さまざまなデータ形式への対応、同じデータ形式でも作り方によって変換結果が変わるため、リリースより積み重ねてきた知識と経験のなせる技だと自負しています。

2022年の新しい取り組みとして建設に特化したAECチームと、3Dスキャンやフォトグラメトリに特化したSIAR(サイアー : 空間情報技術)チームを新設しました。

こちらもおかげ様で好評で、多くの依頼をいただいています。

アウトプットできた取り組みとしては、日建設計社とCyber-Physical Workplaceの取り組み。

東京メトロ社と総合研修訓練センターの3Dスキャン・フォトグラメトリが挙げられます。

このほかにもさまざまな取り組みを行いました。

昨年から広がっている広域の取り組みでは、国土交通省のProject PLATEAUで2つのプロジェクトに参画しています。 一つは東京都八王子市での街づくりへの適用、もう一つは静岡県沼津市でのモビリティへの適用です。

HoloLensで部屋から始まった取り組みが、都市まで広がってきた一年でした。

これらの取り組みのいくつかは「HoloLab Conference 2022」としてお客様と一緒に事例の公開をしています。

HoloLab Conference 2022 - Program Schedule | ConfEngine - Conference Platform

これらの取り組みは個別の案件である一方で、会社全体としてみると繋がっている中での活動になっています。 HoloLensのアプリ開発から始まったホロラボですが、いまでは「3Dを扱う」ということが共通項になっています。

デバイスはもちろんのこと、それを扱うインフラ、データと広げています。

2023年も引き続きご愛顧・ご注目のほどよろしくお願いいたします。

]]>というわけで、もう少し具体的に振り返ろうかなと思います。

今年は開発面において、コーディングもやりますが、開発管理であったりお客様と話すことが多くなりました。 ある意味で裁量も増えている認識です。 あとは技術の範囲も多岐にわたっています。GNSS系だったりNeRFなどの機械学習だったり。 広く浅く、みたいになってますが、深く突っ込んでいかないととも思いつつ。

あとUnrealEngine始めました。んー、ちゃんと開発面でのセオリーだったりを学ぶ必要があるなぁと感じています。 例えばどういったときにBPで書いて、とどういったときにC++で書いて、という分け方。 BPよくわからんのでC++で書いていましたが、この辺結構明確に決めて開発しないとーとは思います。

IDW'22というWorkshopで発表してきました。現地開催(福岡)ということで、コロナ禍で英語力も上げないとなー、という悩みも出てきました。 どんどん学会発表も多くしていきたいし、そのための研究としてアウトプットを出していきたい所存です。

150kg -> 120kg程までダイエットできました!ダイエットというか、筋トレ+食事の見直し、そして徹底。 筋トレが楽しくなってきたので、来年も続けて一旦90kgくらいまでを目標として続けたいと思います。

来年も頑張っていきますw

]]>UnrealEngine(以下UE)のpreviewバージョンの最新版、preview5.1が公開されましたね。

このバージョンではなんと、VRでLumenやNaniteが動作します。

パブリックロードマップはこちら。

Preview版ということでまだ不安定(※1)なところはありますが、.exeパッケージを作成できましたので触って頂けましたら幸いです。

まえArchiVizDiveでつかったコンテンツをLumenVRでパッケージ化できた。

— moz (@momomo_moz) 2022年10月20日

さすがにハードウェアレイトレは無理やった。

でもマシンスペックさえ用意できればPCVR爆速構築できるようになったのは凄すぎる。#UE5#LumenVR pic.twitter.com/E77cPcKjAh

動作検証環境は下記のとおりです、ぜひ他環境でのフィードバックもいただけるとありがたいです。 ・Meta Quest 2 + Oculus Link ・RTX3080Ti

今回のサンプルははUEの標準VRテンプレートをLumen対応にして、モデルデータのみをインポートしただけです。

標準のVRテンプレートのMoveArea設定はNaviMeshで行われています。 MoveAreaとしたいStaticMeshのCollision設定をし、NaviMeshVolumeと詳細設定を行うだけでLumenVRが体験できます。

以前はNaviMeshで複数階や吹き抜けのある空間のムーブメントを行う場合はVRpawn内のテレポートレーザーのBPの編集を行う必要がありましたが(法線がマイナスになる部分をテレポートレーザーが認識しないようにする)、 最新のVRテンプレートならNaviMeshのサイズや位置、Detailの編集のみで立体的な空間のMoveAreaの設定が行えます。

※1.今回遭遇したのはQuiexl Bridgeのプラグインが使用できない状況